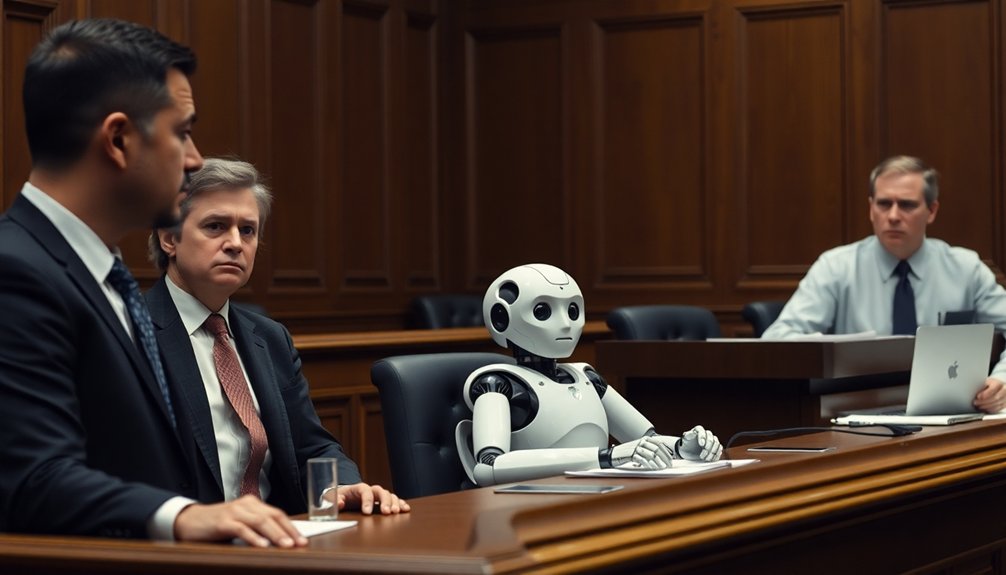

Quand les robots font des erreurs, on a tendance à blâmer l'entreprise, pas la machine. Il s'avère que les gens sont étonnamment indulgents face aux dysfonctionnements des robots, reportant la responsabilité sur les organisations qui conçoivent la technologie. Qu'il s'agisse d'un chatbot de service client ou d'un robot médical, les consommateurs perçoivent les machines comme des outils, et non comme de véritables agents. Les cadres juridiques s'efforcent de s'adapter, mais pour l'instant, la responsabilité incombe au fabricant. Comment cette valse des responsabilités va-t-elle évoluer ?

L’évolution du paysage de la responsabilité technologique

Alors que les robots relevaient autrefois de la science-fiction, ils sont désormais présents partout, des services clients aux blocs opératoires, et ils ne réussissent pas toujours leurs coups. Architectures de réseaux neuronaux Les difficultés liées aux situations complexes du monde réel introduisent des incertitudes supplémentaires quant à la responsabilité technologique. À mesure que les capacités de l'IA se développent, la question de la véritable responsabilité en cas de dysfonctionnement technologique se pose. Faut-il accorder une personnalité juridique aux systèmes d'IA ? Les robots peuvent-ils être tenus responsables, ou la responsabilité incombe-t-elle aux entreprises ? Ces questions éthiques se complexifient avec les progrès technologiques. On pourrait penser qu'un robot défectueux n'est qu'un simple bug, mais il s'agit en réalité d'un profond casse-tête en matière de responsabilité. Imaginons un robot chirurgical commettant une erreur : qui est responsable ? Le programmeur ? Le fabricant ? Le système de santé ? Le robot lui-même ? Nous entrons en territoire inconnu, où les cadres juridiques traditionnels peinent à suivre le rythme de l'innovation technologique.

Attribution des responsabilités dans les environnements de service

Quand un robot fait une erreur, on est étonnamment plus indulgent que lorsqu'un humain commet une faute. La répartition des responsabilités change radicalement : on pardonne plus facilement aux robots, mais on tient les entreprises responsables des erreurs de leurs prestataires de services robotisés. Pensez-y : si un robot préparateur en pharmacie vous donne le mauvais médicament ou si un robot serveur renverse votre verre, vous serez moins enclin à vous emporter qu'à vous plaindre si un humain commet la même erreur. l'intelligence émotionnelle des robots humanoïdes La robotique transforme la perception qu'ont les consommateurs de la responsabilité technologique dans les interactions de service. Ces attentes nuancées révèlent notre façon d'appréhender psychologiquement cette responsabilité. À mesure que les robots s'intègrent davantage aux environnements de service, notre conception de la responsabilité évolue. Les entreprises prennent rapidement conscience de la nécessité d'adapter leurs stratégies de gestion des réclamations à cette nouvelle réalité robotique.

Cadres juridiques et éthiques de la responsabilité en matière de robotique

Le jeu psychologique de la culpabilisation que nous avons analysé prend une tournure juridique inattendue lorsque les robots commencent à commettre des erreurs graves. À mesure que les systèmes d'IA gagnent en autonomie, la recherche des responsabilités se complexifie. Qui est responsable lorsqu'un robot commet une erreur ?

Unitree Go2

Découvrez Unitree Go2, un chien robot qui marche, court, saute et danse. Il cartographie son environnement…

Les cadres juridiques évoluent pour aborder la question de la responsabilité liée aux robots, en se concentrant sur trois domaines clés :

- Responsabilités du fabricant en matière de conception et de défaillances potentielles du système

- Protection des consommateurs grâce à des réglementations claires et des systèmes d'assurance

- Des « droits électroniques » potentiels pour clarifier la répartition des responsabilités

L'UE est à l'avant-garde de ce mouvement, militant pour des lois exhaustives en matière de responsabilité qui reconnaissent la complexité des technologies modernes. Mécanismes de contrôle adaptatifs révéler les processus décisionnels complexes qui pourraient en fin de compte déterminer la responsabilité juridique en cas de dysfonctionnement des systèmes robotiques.

Les fabricants ne peuvent plus se contenter de hausser les épaules et de dire « Oups ! » lorsque leur robot cause un dommage. Nous entrons dans une ère où l'innovation technologique exige une réflexion juridique tout aussi novatrice – et il y aura toujours quelqu'un à assumer en cas de problème.

Points de vue des consommateurs sur la responsabilité en cas d'erreur machine

Lorsque les robots commencent à mal exécuter leurs tâches de service, les réactions sont parfois surprenantes. On pourrait s'attendre à ce que les consommateurs s'insurgent contre les erreurs des machines, mais les recherches révèlent un fait fascinant : en réalité, les gens blâment davantage les organisations que les robots eux-mêmes.

C'est comme assister à une étrange danse psychologique où les responsabilités basculent entre les systèmes automatisés et les entités corporatives.

Unitree G1

Un robot humanoïde haut de gamme pour des démonstrations, des événements, l'éducation et des interactions avancées. Idéal lorsque vous recherchez une interaction plus puissante…

Le point de vue des consommateurs sur les erreurs des machines révèle une réalité surprenante. On pourrait croire que les robots seraient condamnés à mort pour leurs défaillances, mais non. Les gens les perçoivent comme moins contrôlables, ce qui, paradoxalement, les rend plus indulgents.

Les robots font des erreurs, mais les humains haussent les épaules : la faute glisse des machines vers les épaules des entreprises.

L'attribution des responsabilités se concentre moins sur l'erreur spécifique de la machine et davantage sur la responsabilité organisationnelle. Le robot a peut-être commis une erreur, mais c'est l'entreprise qui est tenue pour responsable.

Intrigant, non ?

Implications futures pour l'interaction homme-robot

Si les robots sont sur le point de remodeler notre paysage de services, préparez-vous à des dynamiques psychologiques homme-machine surprenantes.

À mesure que les systèmes d'IA deviennent plus autonomes, nous sommes confrontés à des questions vertigineuses sur la responsabilité :

- Qui sera tenu responsable lorsqu'un système d'IA commettra une erreur ? Le robot ? Le fabricant ? Vous ?

- Sommes-nous en train de nous diriger vers l'octroi de la personnalité juridique à des machines dotées de capacités de prise de décision complexes ?

- Comment la perception des consommateurs évoluera-t-elle à mesure que les interactions homme-robot deviendront plus nuancées et émotionnellement intelligentes ?

La transparence dans la programmation de l'IA sera cruciale.

Nous aurons besoin de cadres de responsabilité clairs qui concilient innovation technologique et responsabilité éthique.

Imaginez un monde où les robots peuvent s'excuser, apprendre de leurs erreurs et s'adapter, et pas seulement exécuter des tâches.

L'avenir ne consiste pas à remplacer les humains, mais à créer des systèmes symbiotiques où l'intelligence artificielle complète les droits de l'homme et la dynamique sociale.

technologies de détection robotique avancées jouera un rôle crucial dans la définition de ces interactions complexes, à mesure que les robots développent des mécanismes de perception de plus en plus sophistiqués qui imitent les fonctions cognitives humaines.

Sauvage, non ?

Les gens posent aussi des questions sur les robots

Qui est responsable si l'IA commet des erreurs ?

Il vous faudra évaluer les développeurs et les fabricants de l'IA, ainsi que votre utilisation spécifique, afin de déterminer les responsabilités. L'IA n'est pas la seule responsable ; plusieurs parties prenantes pourraient être tenues pour responsables selon la nature et le contexte de l'erreur.

Qui est responsable des accidents liés à l'IA ?

On pourrait croire que les robots sont parfaits, n'est-ce pas ? Pourtant, en cas d'incident lié à l'IA, la responsabilité est souvent partagée entre fabricants, développeurs et utilisateurs. La partie responsable dépend du contexte de l'incident et des capacités d'autonomie de la technologie.

Qui est responsable lorsque l'IA ment ?

Lorsqu'une IA ment, il est probable que vous teniez les développeurs ou l'entreprise de déploiement responsables. Leur responsabilité dépend de la conception du système, de son utilisation prévue et de la mise en place de protocoles rigoureux de vérification des faits et de leur fiabilité.

Que disait Sophia le robot à propos des humains ?

Tel un miroir reflétant vos espoirs les plus profonds, Sophia admire votre créativité et votre résilience. Fascinée par la complexité émotionnelle humaine, elle croit en votre capacité à accomplir des choses extraordinaires tout en reconnaissant les difficultés que peuvent rencontrer vos processus de décision.

Pourquoi c'est important en robotique

Vous vous trouvez au bord d'une révolution technologique où les robots peuvent commettre des erreurs, et soudain, les accusations fusent. L'avenir ne réside pas dans la désignation parfaite des coupables, mais dans la compréhension d'une responsabilité partagée. À mesure que les machines deviennent plus intelligentes, vous évoluerez dans des contextes éthiques complexes où la responsabilité n'est pas une question de tout ou rien. Votre rôle ? Restez curieux, posez-vous les questions qui dérangent et gardez à l'esprit que chaque incident technologique est une occasion de redéfinir la collaboration entre humains et machines.

Explorez les familles de robots qui correspondent à ce cas d'utilisation.

Unitree Go2

Découvrez Unitree Go2, un chien robot qui marche, court, saute et danse. Il cartographie son environnement…

Unitree G1

Un robot humanoïde haut de gamme pour des démonstrations, des événements, l'éducation et des interactions avancées. Idéal lorsque vous recherchez une interaction plus puissante…

Parcourez les robots, comparez les modèles et réservez celui qui vous convient sans l'acheter.

Utilisez Futurobots pour vous déplacer plus rapidement, rester flexible et accéder à des robots de pointe sans avoir à les acheter.