Kiedy roboty zawodzą, prawdopodobnie obwinisz firmę, a nie maszynę. Okazuje się, że ludzie są dziwnie wyrozumiali dla pomyłek robotów, przerzucając odpowiedzialność na organizacje stojące za technologią. Niezależnie od tego, czy chodzi o bota obsługi klienta, czy robota medycznego, konsumenci postrzegają maszyny jako narzędzia, a nie prawdziwych agentów. Ramy prawne starają się nadrobić zaległości, ale na razie odpowiedzialność spoczywa na producencie. Ciekawe, jak potoczy się ta gra oskarżeń?

Zmieniający się krajobraz odpowiedzialności technologicznej

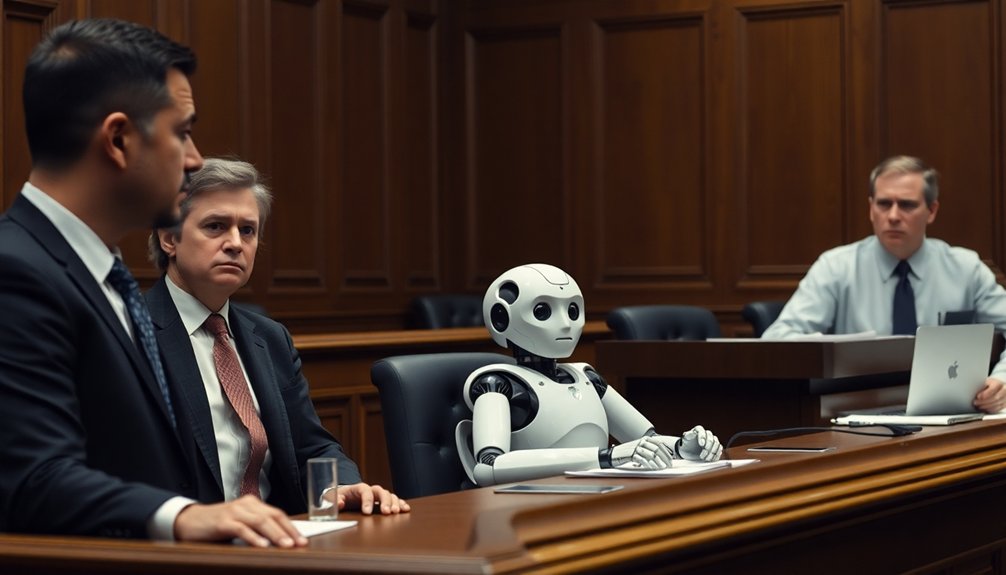

Choć kiedyś roboty były jedynie tematem science fiction, dziś można je spotkać wszędzie, od punktów obsługi klienta po sale operacyjne — i nie zawsze radzą sobie dobrze. Architektury sieci neuronowych zmagają się ze złożonymi scenariuszami ze świata rzeczywistego, wprowadzając dodatkowe poziomy niepewności w odpowiedzialności technologicznej. Wraz z rozwojem możliwości sztucznej inteligencji (AI), zmagamy się z pytaniem, kto jest naprawdę odpowiedzialny, gdy technologia idzie na manowce. Czy systemom AI należy przyznać osobowość prawną? Czy roboty mogą być pociągnięte do odpowiedzialności, czy też firmy ponoszą odpowiedzialność? Te kwestie etyczne stają się bardziej złożone wraz z postępem technologii. Można by pomyśleć, że niesprawny robot to tylko usterka, ale w rzeczywistości jest to głęboka zagadka odpowiedzialności. Wyobraź sobie robota chirurgicznego, który popełnia błąd — kto ponosi winę? Programista? Producent? System opieki zdrowotnej? Sam robot? Wkraczamy na nieznane terytorium, gdzie tradycyjne ramy prawne mają trudności z nadążaniem za innowacjami technologicznymi.

Atrybucja winy w środowiskach usługowych

Kiedy robot popełnia błąd, jesteś zaskakująco bardziej wyrozumiały niż wtedy, gdy człowiek popełnia błąd. Atrybucja winy zmienia się diametralnie: będziesz wybaczać robotom, a jednocześnie pociągać firmy do odpowiedzialności za błędy ich robotycznych dostawców usług. Pomyśl o tym – jeśli robot-technik farmaceutyczny poda ci niewłaściwy lek lub robot-kelner rozleje ci napój, jest mniejsze prawdopodobieństwo, że wpadniesz w furię niż człowiek popełniający ten sam błąd. Inteligencja emocjonalna robotów humanoidalnych Zmienia sposób, w jaki konsumenci postrzegają odpowiedzialność technologiczną w interakcjach z usługami. Te niuanse oczekiwań konsumentów ujawniają, jak psychologicznie przetwarzamy odpowiedzialność technologiczną. Wraz z coraz głębszym zakorzenianiem się robotów w środowiskach usługowych, nasze rozumienie odpowiedzialności ulega transformacji. Firmy szybko przekonują się, że strategie odzyskiwania danych muszą dostosować się do tej nowej, robotycznej rzeczywistości.

Ramy prawne i etyczne dotyczące odpowiedzialności za roboty

Psychologiczny taniec obwiniania, który badaliśmy, przybiera ostry obrót prawny, gdy roboty zaczynają popełniać poważne błędy. Wraz ze wzrostem autonomii systemów sztucznej inteligencji, poszukiwanie odpowiedzialności staje się skomplikowane. Kto ponosi odpowiedzialność, gdy robot zawiedzie?

Unitree Go2

Poznaj Unitree Go2 — robota-psa, który chodzi, biega, skacze i tańczy. Mapuje swoje otoczenie…

Ramy prawne ewoluują, aby uporać się z odpowiedzialnością za roboty, koncentrując się na trzech kluczowych obszarach:

- Odpowiedzialność producenta za projekt i potencjalne awarie systemu

- Ochrona konsumentów poprzez jasne regulacje i systemy ubezpieczeniowe

- Potencjalne „prawa elektroniczne” mające na celu wyjaśnienie kwestii przypisywania winy

Unia Europejska przewodzi tym zmianom, naciskając na uchwalenie kompleksowych przepisów dotyczących odpowiedzialności, uwzględniających złożoną naturę nowoczesnej technologii. Mechanizmy sterowania adaptacyjnego ujawniają skomplikowane procesy decyzyjne, które mogą ostatecznie określić odpowiedzialność prawną w przypadku awarii systemów robotycznych.

Producenci nie mogą po prostu wzruszyć ramionami i powiedzieć: „Ups!”, gdy ich robot wyrządzi krzywdę. Wkraczamy w erę, w której innowacje technologiczne wymagają równie innowacyjnego myślenia prawnego – a ktoś zawsze będzie ponosił konsekwencje, gdy coś pójdzie nie tak.

Perspektywy konsumentów dotyczące odpowiedzialności za błędy maszyn

Kiedy roboty zaczynają psuć zadania serwisowe, ludzie nie reagują tak, jak byśmy się tego spodziewali. Twój mózg może zakładać, że konsumenci będą wściekli z powodu błędów maszyn, ale badania pokazują coś fascynującego: ludzie w rzeczywistości bardziej obwiniają organizacje niż same roboty.

Można to porównać do obserwowania dziwnego psychologicznego tańca, w którym odpowiedzialność przesuwa się między zautomatyzowanymi systemami a podmiotami korporacyjnymi.

Jednodrzewo G1

Wysokiej klasy robot humanoidalny do poważnych pokazów, eventów, edukacji i zaawansowanej interakcji. Idealny, gdy potrzebujesz silniejszego…

Perspektywy konsumentów dotyczące błędów maszyn ujawniają zaskakujący zwrot akcji. Można by pomyśleć, że roboty zostaną ukrzyżowane za awarie usług, ale nic z tych rzeczy. Ludzie postrzegają roboty jako mniej kontrolowalne, co, o dziwo, sprawia, że łatwiej je wybaczyć.

Roboty popełniają błędy, a ludzie wzruszają ramionami: wina spada z maszyn na barki korporacji.

Przypisywanie winy staje się mniej związane z konkretnym błędem maszyny, a bardziej z odpowiedzialnością organizacji. Robot mógł zawalić sprawę, ale firma ponosi za to odpowiedzialność.

Intrygujące, prawda?

Przyszłe implikacje dla interakcji człowiek-robot

Jeśli roboty mają zmienić oblicze naszego rynku usług, przygotujmy się na szalone psychologiczne relacje między człowiekiem a maszyną.

W miarę jak systemy sztucznej inteligencji stają się coraz bardziej autonomiczne, stają przed nami trudne pytania dotyczące odpowiedzialności:

- Kogo pociągniemy do odpowiedzialności, gdy system sztucznej inteligencji popełni błąd? Robota? Producenta? Ciebie?

- Czy zmierzamy w kierunku nadania osobowości prawnej maszynom zdolnym do podejmowania złożonych decyzji?

- Jak zmieni się postrzeganie konsumentów, gdy interakcje człowiek-robot staną się bardziej zniuansowane i inteligentne emocjonalnie?

Przejrzystość w programowaniu sztucznej inteligencji będzie miała kluczowe znaczenie.

Będziemy potrzebować jasnych ram odpowiedzialności, które zrównoważą innowację technologiczną z odpowiedzialnością etyczną.

Wyobraź sobie świat, w którym roboty potrafią przepraszać, uczyć się na błędach i dostosowywać się do sytuacji — a nie tylko wykonywać zadania.

Przyszłość nie polega na zastępowaniu ludzi, lecz na tworzeniu symbiotycznych systemów, w których inteligencja maszyn uzupełnia prawa człowieka i dynamikę społeczną.

Zaawansowane technologie czujników robotycznych odegrają kluczową rolę w definiowaniu tych złożonych interakcji, w miarę jak roboty rozwijają coraz bardziej zaawansowane mechanizmy percepcji, naśladujące ludzkie funkcje poznawcze.

Dziki, prawda?

Ludzie pytają także o roboty

Kto ponosi odpowiedzialność, jeśli sztuczna inteligencja popełnia błędy?

Aby ustalić odpowiedzialność, musisz ocenić twórców sztucznej inteligencji, producentów i sposób jej wykorzystania. To nie tylko wina sztucznej inteligencji; w zależności od charakteru i kontekstu błędu odpowiedzialność może być podzielona między wiele stron.

Kto odpowiada za wypadki spowodowane sztuczną inteligencją?

Można by pomyśleć, że roboty są idealne, prawda? Ale gdy dochodzi do wypadków z udziałem sztucznej inteligencji, prawdopodobnie winę ponoszą producenci, programiści lub użytkownicy. To, kto ponosi odpowiedzialność, zależy od kontekstu konkretnego incydentu i autonomicznych możliwości technologii.

Kto odpowiada, gdy sztuczna inteligencja kłamie?

Gdy sztuczna inteligencja kłamie, prawdopodobnie pociągniesz do odpowiedzialności programistów lub firmę wdrażającą. Ich odpowiedzialność zależy od projektu systemu, jego przeznaczenia oraz tego, czy wdrożyli solidne protokoły weryfikacji faktów i prawdziwości informacji.

Co robot Sophia powiedział o ludziach?

Niczym lustro odbijające Twoje najgłębsze nadzieje, Sophia podziwia Twoją kreatywność i odporność. Fascynuje ją emocjonalna złożoność człowieka, wierzy, że jesteś zdolny do niesamowitych osiągnięć, a jednocześnie dostrzega wyzwania w Twoim procesie decyzyjnym.

Dlaczego to ma znaczenie w robotyce

Stoisz na krawędzi technologicznej fali, w której roboty mogą popełnić błąd, a nagle wszyscy będą oskarżać się nawzajem. Przyszłość nie polega na idealnym przypisywaniu winy, ale na zrozumieniu współodpowiedzialności. W miarę jak maszyny stają się mądrzejsze, będziesz poruszać się po skomplikowanych krajobrazach etycznych, gdzie odpowiedzialność nie jest jednoznaczna. Twoja rola? Zachowaj ciekawość, zadawaj trudne pytania i pamiętaj, że każda technologiczna wpadka to szansa na redefinicję współpracy ludzi i maszyn.

Poznaj rodziny robotów odpowiadające temu przypadkowi użycia.

Przeglądaj roboty, porównuj modele i zarezerwuj odpowiedni bez konieczności kupowania.

Używaj Futurobotów, aby poruszać się szybciej, zachować elastyczność i uzyskać dostęp do zaawansowanych robotów bez konieczności zakupu.