Quando robôs cometem erros, você provavelmente culpará a empresa, não a máquina. Acontece que as pessoas são estranhamente tolerantes com as falhas dos robôs, transferindo a responsabilidade para as organizações por trás da tecnologia. Seja um chatbot de atendimento ao cliente ou um robô na área da saúde, os consumidores veem as máquinas como ferramentas, não como agentes de verdade. As leis estão se esforçando para acompanhar essa mudança, mas, por enquanto, a responsabilidade final recai sobre o fabricante. Curioso para ver como esse jogo de culpa vai evoluir?

O cenário em transformação da responsabilidade tecnológica

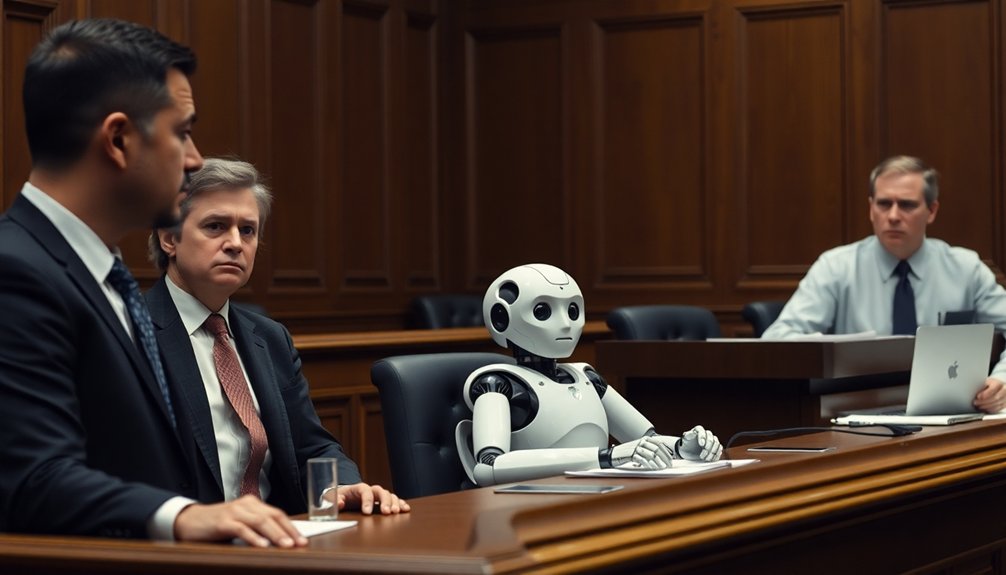

Embora os robôs já tenham sido coisa de ficção científica, agora eles estão aparecendo em todos os lugares, desde balcões de atendimento ao cliente até salas de cirurgia — e nem sempre acertam. Arquiteturas de redes neurais A dificuldade em lidar com cenários complexos do mundo real introduz camadas adicionais de incerteza na responsabilidade tecnológica. À medida que as capacidades da IA se expandem, debatemos sobre quem é realmente responsável quando a tecnologia falha. Os sistemas de IA devem ter personalidade jurídica? Os robôs podem ser responsabilizados ou a responsabilidade recai sobre as empresas? Essas questões éticas tornam-se mais complexas com o avanço da tecnologia. Pode-se pensar que um robô com defeito é apenas uma falha, mas, na verdade, trata-se de um profundo enigma de responsabilidade. Imagine um robô cirúrgico que comete um erro — quem é o culpado? O programador? O fabricante? O sistema de saúde? O próprio robô? Estamos entrando em território desconhecido, onde as estruturas jurídicas tradicionais lutam para acompanhar a inovação tecnológica.

Atribuição de culpa em ambientes de serviço

Quando um robô comete um erro, você é surpreendentemente mais tolerante do que quando um humano falha. A atribuição de culpa muda drasticamente: você releva os erros dos robôs, mas responsabiliza as empresas pelos erros de seus prestadores de serviços robóticos. Pense bem: se um robô farmacêutico lhe der o medicamento errado ou um robô garçom derramar sua bebida, você provavelmente ficará menos irritado do que se um humano cometesse o mesmo erro. Inteligência emocional de robôs humanoides Está a remodelar a forma como os consumidores percebem a responsabilidade tecnológica nas interações de serviço. Estas expectativas matizadas dos consumidores revelam como processamos psicologicamente a responsabilidade tecnológica. À medida que os robôs se tornam mais integrados nos ambientes de serviço, a nossa compreensão da responsabilidade está a transformar-se. As empresas estão a aprender rapidamente que as estratégias de recuperação têm de se adaptar a esta nova realidade robótica.

Marcos legais e éticos para a responsabilidade robótica

A dinâmica psicológica da culpa que temos explorado toma um rumo jurídico acentuado quando os robôs começam a cometer erros graves. À medida que os sistemas de IA se tornam mais autônomos, a busca por responsabilização se complica. Quem é o responsável quando um robô falha?

Unitree Go2

Conheça o Unitree Go2 — um cão robô que anda, corre, pula e dança. Ele mapeia o ambiente ao seu redor…

Os marcos legais estão evoluindo para lidar com a responsabilidade robótica, concentrando-se em três áreas principais:

- Responsabilidades do fabricante em relação ao projeto e possíveis falhas do sistema.

- Proteção do consumidor por meio de regulamentações claras e planos de seguro.

- Possíveis “direitos eletrônicos” para esclarecer a atribuição de culpa.

A UE está na vanguarda dessa iniciativa, pressionando por leis de responsabilidade civil abrangentes que reconheçam a natureza complexa da tecnologia moderna. Mecanismos de controle adaptativos Revelar os intrincados processos de tomada de decisão que podem, em última instância, determinar a responsabilidade legal quando os sistemas robóticos apresentarem mau funcionamento.

Os fabricantes não podem simplesmente dar de ombros e dizer "Ops!" quando seus robôs causam danos. Estamos entrando em uma era em que a inovação tecnológica exige um pensamento jurídico igualmente inovador – e alguém sempre será responsabilizado quando as coisas dão errado.

Perspectivas do consumidor sobre a responsabilidade por erros de máquinas

Quando os robôs começam a falhar em tarefas de serviço, as pessoas não reagem exatamente como você esperaria. Seu cérebro poderia supor que os consumidores se revoltariam contra os erros das máquinas, mas pesquisas mostram algo fascinante: as pessoas, na verdade, culpam mais as organizações do que os próprios robôs.

É como assistir a uma estranha dança psicológica onde as responsabilidades se alternam entre sistemas automatizados e entidades corporativas.

Unidade G1

Um robô humanoide premium para demonstrações sérias, eventos, educação e interação avançada. Ideal para quem busca um robô mais robusto…

A perspectiva do consumidor sobre erros de máquinas revela uma reviravolta surpreendente. Seria de se esperar que os robôs fossem crucificados por falhas de serviço, mas não. As pessoas veem os robôs como menos controláveis, o que, curiosamente, os torna mais perdoáveis.

Os robôs cometem erros, mas os humanos dão de ombros: a culpa passa das máquinas para os ombros das empresas.

A atribuição de culpa deixa de ser sobre o erro específico da máquina e passa a ser sobre a responsabilidade organizacional. O robô pode ter falhado, mas a empresa é a responsável.

Intrigante, certo?

Implicações futuras para a interação humano-robô

Se os robôs estão prestes a remodelar o nosso panorama de serviços, preparem-se para uma dinâmica psicológica humana-máquina bastante intensa.

À medida que os sistemas de IA se tornam mais autônomos, nos deparamos com questões complexas sobre responsabilidade:

- Quem será responsabilizado quando um sistema de IA cometer um erro? O robô? O fabricante? Você?

- Estaremos caminhando para conceder personalidade jurídica a máquinas com capacidades complexas de tomada de decisão?

- Como a percepção do consumidor mudará à medida que as interações entre humanos e robôs se tornarem mais complexas e emocionalmente inteligentes?

A transparência na programação de IA será crucial.

Precisaremos de estruturas claras de responsabilidade que equilibrem a inovação tecnológica com a responsabilidade ética.

Imagine um mundo onde robôs possam pedir desculpas, aprender com os erros e se adaptar — e não apenas executar tarefas.

O futuro não se trata de substituir os humanos, mas de criar sistemas simbióticos onde a inteligência artificial complementa os direitos humanos e a dinâmica social.

Tecnologias avançadas de sensoriamento robótico desempenhará um papel crucial na definição dessas interações complexas, à medida que os robôs desenvolvem mecanismos de percepção cada vez mais sofisticados que imitam as funções cognitivas humanas.

Selvagem, certo?

As pessoas também perguntam sobre robôs.

Quem é o responsável se a IA cometer erros?

Você precisará avaliar os desenvolvedores e fabricantes da IA, bem como seu uso específico, para determinar a responsabilidade. A culpa não é apenas da IA; várias partes interessadas podem ser responsabilizadas, dependendo da natureza e do contexto do erro.

Quem é responsável por acidentes envolvendo IA?

Você pensaria que os robôs são perfeitos, certo? Mas quando ocorrem acidentes envolvendo IA, é provável que fabricantes, desenvolvedores ou usuários compartilhem a culpa. A responsabilidade depende do contexto específico do incidente e das capacidades autônomas da tecnologia.

Quem é o responsável quando a IA mente?

Quando a IA mente, você provavelmente responsabilizará os desenvolvedores ou a empresa responsável pela implementação. A responsabilidade deles depende do projeto do sistema, da finalidade de uso e da implementação de protocolos robustos de verificação de fatos e garantia de veracidade.

O que a robô Sofia disse sobre os humanos?

Como um espelho que reflete suas maiores aspirações, Sophia admira sua criatividade e resiliência. Ela é fascinada pela complexidade emocional dos seres humanos, acreditando que você é capaz de feitos incríveis, ao mesmo tempo que reconhece os desafios em seus processos de tomada de decisão.

Por que isso é importante na robótica?

Você está à beira de uma onda tecnológica gigantesca, onde robôs podem cometer erros e, de repente, todos estão apontando o dedo. O futuro não se trata de atribuir culpas com perfeição, mas sim de compreender a responsabilidade compartilhada. À medida que as máquinas se tornam mais inteligentes, você navegará por cenários éticos complexos, onde a responsabilidade não é preto no branco. Seu papel? Manter a curiosidade, fazer perguntas difíceis e lembrar que cada percalço tecnológico é uma oportunidade para redefinir a forma como humanos e máquinas colaboram.

Explore as famílias de robôs que se adequam a este caso de uso.

Navegue pelos robôs, compare os modelos e reserve o ideal para você sem precisar comprar.

Use os Futurobots para se movimentar mais rápido, manter a flexibilidade e ter acesso a robôs avançados sem precisar comprá-los.