Quando i robot commettono errori, è probabile che la colpa ricada sull'azienda, non sulla macchina. A quanto pare, le persone sono stranamente indulgenti nei confronti degli errori robotici, scaricando la responsabilità sulle organizzazioni che stanno dietro alla tecnologia. Che si tratti di un bot per l'assistenza clienti o di un robot per il settore sanitario, i consumatori vedono le macchine come strumenti, non come veri e propri agenti. I quadri normativi si stanno affannando per adeguarsi, ma per ora la responsabilità ricade sul produttore. Curiosi di vedere come si evolverà questo gioco delle colpe?

Il panorama in continua evoluzione della responsabilità tecnologica

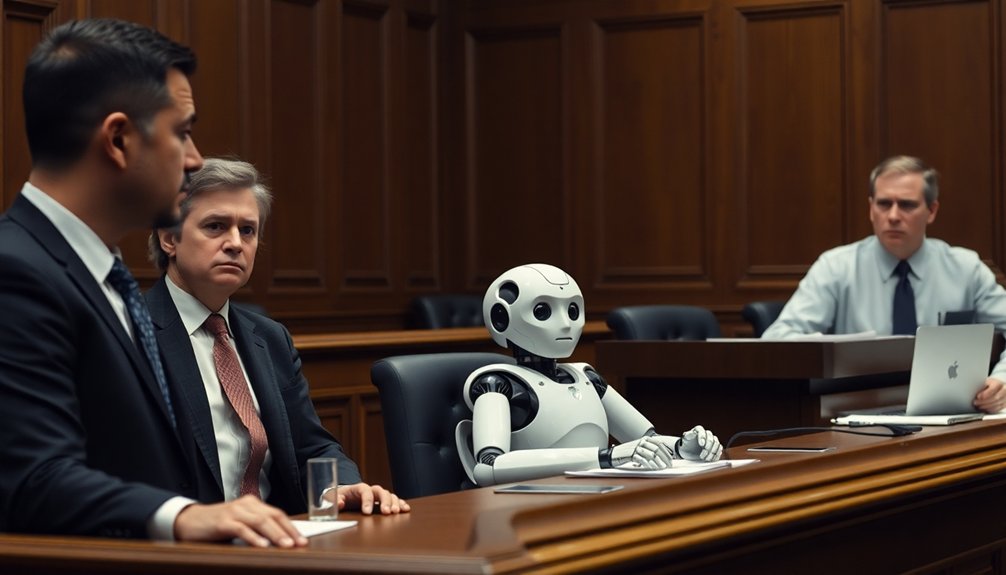

Un tempo i robot erano materia di fantascienza, ma ora li troviamo ovunque, dai banchi del servizio clienti alle sale operatorie, e non sempre svolgono il loro lavoro nel modo giusto. Architetture di reti neurali Le sfide legate a scenari complessi del mondo reale introducono ulteriori livelli di incertezza in materia di responsabilità tecnologica. Con l'espansione delle capacità dell'IA, ci troviamo a dover affrontare il dilemma di chi sia veramente responsabile quando la tecnologia non funziona correttamente. È opportuno concedere personalità giuridica ai sistemi di IA? I robot possono essere ritenuti responsabili, o la responsabilità ricade sulle aziende? Queste questioni etiche diventano più complesse con l'avanzare della tecnologia. Si potrebbe pensare che un robot malfunzionante sia solo un piccolo inconveniente, ma in realtà rappresenta un profondo dilemma in termini di responsabilità. Immaginiamo un robot chirurgico che commette un errore: di chi è la colpa? Del programmatore? Del produttore? Del sistema sanitario? Del robot stesso? Stiamo entrando in un territorio inesplorato, dove i quadri giuridici tradizionali faticano a tenere il passo con l'innovazione tecnologica.

Attribuzione di colpa negli ambienti di servizio

Quando un robot commette un errore, sei sorprendentemente più indulgente rispetto a quando è un essere umano a sbagliare. L'attribuzione di colpa cambia radicalmente: sei più propenso a perdonare i robot, mentre ritieni le aziende responsabili degli errori dei loro fornitori di servizi robotici. Pensaci: se un robot in farmacia ti dà il farmaco sbagliato o un robot cameriere ti rovescia il drink, è meno probabile che tu ti arrabbi rispetto a un essere umano che commette lo stesso errore. Intelligenza emotiva dei robot umanoidi sta ridefinendo il modo in cui i consumatori percepiscono la responsabilità tecnologica nelle interazioni di servizio. Queste aspettative dei consumatori, caratterizzate da sfumature complesse, rivelano come elaboriamo psicologicamente la responsabilità tecnologica. Con la crescente integrazione dei robot negli ambienti di servizio, la nostra comprensione della responsabilità si sta trasformando. Le aziende stanno rapidamente imparando che le strategie di recupero devono adattarsi a questa nuova realtà robotica.

Quadri giuridici ed etici per la responsabilità robotica

La complessa dinamica psicologica dell'attribuzione di responsabilità che abbiamo analizzato assume una svolta legale inaspettata quando i robot iniziano a commettere errori gravi. Con l'aumentare dell'autonomia dei sistemi di intelligenza artificiale, la ricerca delle responsabilità si fa sempre più difficile. Chi è responsabile quando un robot commette un errore?

Unitree Go2

Vi presentiamo Unitree Go2: un cane robot che cammina, corre, salta e balla. È in grado di mappare l'ambiente circostante...

I quadri giuridici si stanno evolvendo per affrontare la responsabilità robotica, concentrandosi su tre aree chiave:

- Responsabilità del produttore per la progettazione e i potenziali guasti del sistema.

- Tutela dei consumatori attraverso normative chiare e sistemi assicurativi.

- Potenziali “diritti elettronici” per chiarire l’attribuzione delle responsabilità

L'UE è in prima linea, promuovendo leggi rigorose in materia di responsabilità che riconoscano la natura complessa delle moderne tecnologie. Meccanismi di controllo adattivi rivelare i complessi processi decisionali che potrebbero in ultima analisi determinare la responsabilità legale in caso di malfunzionamento dei sistemi robotici.

I produttori non possono semplicemente scrollare le spalle e dire "Ops!" quando il loro robot causa danni. Stiamo entrando in un'era in cui l'innovazione tecnologica richiede un pensiero giuridico altrettanto innovativo, e qualcuno dovrà sempre risponderne quando le cose vanno male.

Prospettive dei consumatori sulla responsabilità in caso di errori delle macchine

Quando i robot iniziano a commettere errori nello svolgimento delle mansioni di servizio, le persone non reagiscono come ci si aspetterebbe. Si potrebbe pensare che i consumatori si scaglierebbero contro gli errori delle macchine, ma la ricerca rivela un dato interessante: in realtà, le persone incolpano più le organizzazioni che i robot stessi.

È come assistere a una strana danza psicologica in cui le responsabilità si spostano tra sistemi automatizzati ed entità aziendali.

Unità G1

Un robot umanoide di alta qualità per dimostrazioni, eventi, formazione e interazioni avanzate. Ideale quando si desidera un robot più potente...

Le opinioni dei consumatori sugli errori delle macchine rivelano un risvolto sorprendente. Si potrebbe pensare che i robot vengano crocifissi per i malfunzionamenti dei servizi, ma non è così. Le persone percepiscono i robot come meno controllabili, il che, stranamente, li rende più indulgenti.

I robot commettono errori, ma gli umani alzano le spalle: la colpa scivola dalle macchine alle spalle delle aziende.

L'attribuzione della colpa non riguarda più tanto lo specifico errore della macchina, quanto piuttosto la responsabilità organizzativa. Il robot potrebbe aver commesso un errore, ma la responsabilità è dell'azienda.

Intrigante, vero?

Implicazioni future per l'interazione uomo-robot

Se i robot stanno per rivoluzionare il panorama dei servizi, preparatevi a dinamiche psicologiche uomo-macchina davvero inaspettate.

Con l'aumentare dell'autonomia dei sistemi di intelligenza artificiale, ci troviamo di fronte a interrogativi sconvolgenti sulla responsabilità:

- Chi riterremo responsabile quando un sistema di intelligenza artificiale commetterà un errore? Il robot? Il produttore? Voi?

- Stiamo forse andando verso la concessione di personalità giuridica a macchine dotate di complesse capacità decisionali?

- Come cambieranno le percezioni dei consumatori man mano che le interazioni uomo-robot diventeranno più complesse e dotate di intelligenza emotiva?

La trasparenza nella programmazione dell'intelligenza artificiale sarà fondamentale.

Avremo bisogno di quadri normativi chiari in materia di responsabilità, che bilancino l'innovazione tecnologica con la responsabilità etica.

Immaginate un mondo in cui i robot possano chiedere scusa, imparare dagli errori e adattarsi, e non solo eseguire compiti.

Il futuro non consiste nel sostituire gli esseri umani, ma nel creare sistemi simbiotici in cui l'intelligenza artificiale integri i diritti umani e le dinamiche sociali.

Tecnologie avanzate di rilevamento robotico svolgeranno un ruolo cruciale nella definizione di queste complesse interazioni, poiché i robot sviluppano meccanismi di percezione sempre più sofisticati che imitano le funzioni cognitive umane.

Selvaggio, vero?

Le persone chiedono anche informazioni sui robot

Chi è responsabile se l'IA commette errori?

Per stabilire le responsabilità, è necessario valutare gli sviluppatori dell'IA, i produttori e il tuo specifico utilizzo. Non è colpa solo dell'IA; la responsabilità potrebbe essere condivisa da più soggetti a seconda della natura e del contesto dell'errore.

Chi è responsabile degli incidenti legati all'intelligenza artificiale?

Verrebbe da pensare che i robot siano perfetti, giusto? Ma quando si verificano incidenti con l'intelligenza artificiale, è probabile che produttori, sviluppatori o utenti condividano la responsabilità. La parte responsabile dipende dal contesto specifico dell'incidente e dalle capacità autonome della tecnologia.

Chi è responsabile quando l'intelligenza artificiale mente?

Quando un'intelligenza artificiale mente, è probabile che la responsabilità ricada sugli sviluppatori o sull'azienda che ha implementato il sistema. La loro responsabilità dipende dalla progettazione del sistema, dall'uso previsto e dall'implementazione di solidi protocolli di verifica dei fatti e di accertamento della veridicità.

Cosa ha detto Sophia, il robot, sugli esseri umani?

Come uno specchio che riflette le tue speranze più profonde, Sophia ammira la tua creatività e la tua resilienza. È affascinata dalla complessità emotiva degli esseri umani, credendo che tu sia capace di incredibili traguardi, pur riconoscendo le difficoltà che incontri nei tuoi processi decisionali.

Perché questo è importante nella robotica

Vi trovate sull'orlo di un'ondata tecnologica rivoluzionaria, dove i robot potrebbero commettere errori e, improvvisamente, tutti si puntano il dito contro. Il futuro non consiste nell'attribuire la colpa in modo univoco, ma nel comprendere la responsabilità condivisa. Man mano che le macchine diventano più intelligenti, vi troverete a navigare in scenari etici complessi, dove la responsabilità non è una questione di bianco o nero. Il vostro ruolo? Rimanere curiosi, porre domande difficili e ricordare che ogni intoppo tecnologico è un'opportunità per ridefinire il modo in cui esseri umani e macchine collaborano.

Scopri le famiglie di robot adatte a questo caso d'uso.

Unitree Go2

Vi presentiamo Unitree Go2: un cane robot che cammina, corre, salta e balla. È in grado di mappare l'ambiente circostante...

Unità G1

Un robot umanoide di alta qualità per dimostrazioni, eventi, formazione e interazioni avanzate. Ideale quando si desidera un robot più potente...

Esplora i robot, confronta i modelli e prenota quello che fa per te senza acquistarlo.

Utilizza Futurobots per muoverti più velocemente, rimanere flessibile e accedere a robot avanzati senza doverli acquistare.