Cuando los robots fallan, lo más probable es que culpes a la empresa, no a la máquina. Resulta que la gente es sorprendentemente indulgente con los fallos robóticos, trasladando la responsabilidad a las organizaciones que desarrollan la tecnología. Ya sea un robot de atención al cliente o un robot sanitario, los consumidores ven las máquinas como herramientas, no como verdaderos agentes. Los marcos legales se esfuerzan por adaptarse, pero por ahora, la responsabilidad recae en el fabricante. ¿Tienes curiosidad por ver cómo evolucionará este juego de culpas?

El panorama cambiante de la responsabilidad tecnológica

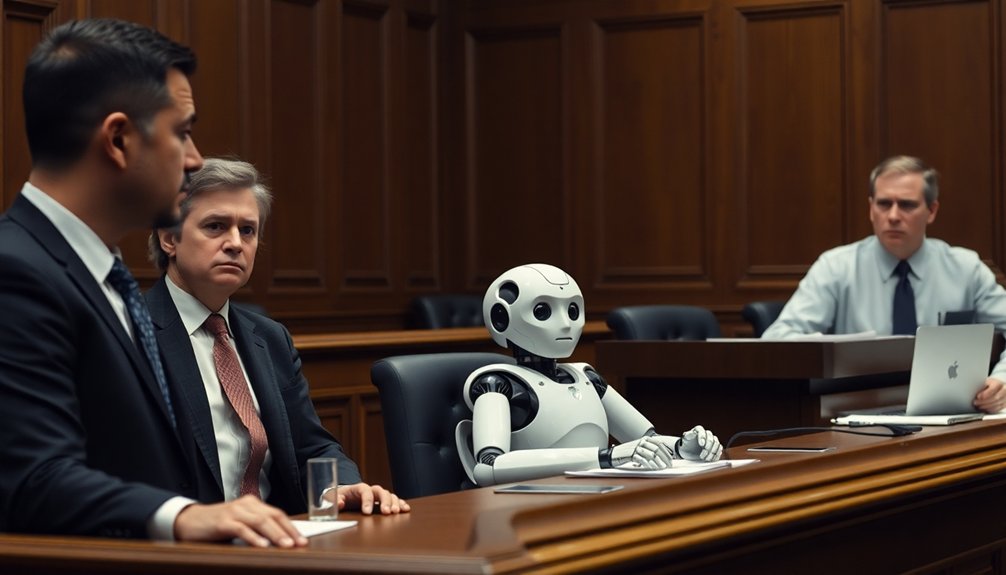

Si bien los robots alguna vez fueron cosa de ciencia ficción, ahora están apareciendo en todas partes, desde mostradores de atención al cliente hasta quirófanos, y no siempre hacen las cosas bien. Arquitecturas de redes neuronales La IA se enfrenta a escenarios complejos del mundo real, lo que introduce capas adicionales de incertidumbre en la responsabilidad tecnológica. A medida que se expanden las capacidades de la IA, nos debatimos sobre quién es realmente responsable cuando la tecnología falla. ¿Debería otorgarse personalidad jurídica a los sistemas de IA? ¿Se puede responsabilizar a los robots o son las empresas las que asumen la responsabilidad? Estas cuestiones éticas se vuelven más complejas a medida que avanza la tecnología. Podría pensarse que un robot que funciona mal es solo un fallo, pero en realidad es un profundo dilema de responsabilidad. Imaginemos un robot quirúrgico que comete un error: ¿quién tiene la culpa? ¿El programador? ¿El fabricante? ¿El sistema sanitario? ¿El propio robot? Estamos entrando en un terreno desconocido donde los marcos legales tradicionales tienen dificultades para seguir el ritmo de la innovación tecnológica.

Atribución de responsabilidades en entornos de servicios

Cuando un robot comete un error, somos sorprendentemente más indulgentes que cuando un humano lo hace. La atribución de culpa cambia drásticamente: perdonamos a los robots, pero responsabilizamos a las empresas por los errores de sus proveedores de servicios robóticos. Piénsalo: si un robot de farmacia te da el medicamento equivocado o un robot camarero derrama tu bebida, es menos probable que te enfades que si un humano cometiera el mismo error. Inteligencia emocional de los robots humanoides Esto está transformando la percepción que tienen los consumidores sobre la responsabilidad tecnológica en las interacciones de servicio. Estas expectativas matizadas de los consumidores revelan cómo procesamos psicológicamente dicha responsabilidad. A medida que los robots se integran más en los entornos de servicio, nuestra comprensión de la responsabilidad se transforma. Las empresas están aprendiendo rápidamente que las estrategias de recuperación deben adaptarse a esta nueva realidad robótica.

Marcos legales y éticos para la responsabilidad robótica

El complejo entramado psicológico de la culpa que hemos estado explorando adquiere una dimensión legal cuando los robots comienzan a cometer errores graves. A medida que los sistemas de IA se vuelven más autónomos, la búsqueda de responsabilidades se complica. ¿Quién es responsable cuando un robot falla?

Unitree Go2

Les presentamos a Unitree Go2: un perro robot que camina, corre, salta y baila. Mapea su entorno…

Los marcos legales están evolucionando para abordar la responsabilidad robótica, centrándose en tres áreas clave:

- Responsabilidades del fabricante en cuanto al diseño y posibles fallos del sistema.

- Protección del consumidor mediante regulaciones claras y planes de seguros.

- Los posibles “derechos electrónicos” podrían aclarar la atribución de responsabilidades.

La UE está a la cabeza, impulsando leyes de responsabilidad civil exhaustivas que reconozcan la naturaleza compleja de la tecnología moderna. Mecanismos de control adaptativos revelar los intrincados procesos de toma de decisiones que, en última instancia, podrían determinar la responsabilidad legal cuando los sistemas robóticos funcionan mal.

Los fabricantes no pueden simplemente encogerse de hombros y decir: «¡Ups!», cuando su robot causa daños. Estamos entrando en una era donde la innovación tecnológica exige un enfoque legal igualmente innovador, y siempre habrá alguien que asuma la responsabilidad cuando las cosas salgan mal.

Perspectivas de los consumidores sobre la responsabilidad por errores de las máquinas

Cuando los robots empiezan a fallar en las tareas de servicio, la gente no reacciona como cabría esperar. Uno podría suponer que los consumidores se enfurecerían ante los errores de las máquinas, pero las investigaciones revelan algo fascinante: la gente culpa más a las organizaciones que a los propios robots.

Es como presenciar una extraña danza psicológica donde las responsabilidades se transfieren entre sistemas automatizados y entidades corporativas.

Árbol unitario G1

Un robot humanoide de alta gama para demostraciones profesionales, eventos, educación e interacción avanzada. Ideal cuando se busca un robot más potente…

La perspectiva de los consumidores sobre los fallos de las máquinas revela un giro sorprendente. Uno pensaría que los robots serían duramente criticados por sus fallos de servicio, pero no. La gente los percibe como menos controlables, lo que, curiosamente, los hace más tolerantes.

Los robots cometen errores, pero los humanos se encogen de hombros: la culpa se desliza de las máquinas a los hombros de las corporaciones.

La atribución de culpas deja de centrarse en el error específico de la máquina y se convierte en una cuestión de responsabilidad organizacional. Puede que el robot haya fallado, pero la empresa es la responsable.

Intrigante, ¿verdad?

Implicaciones futuras para la interacción humano-robot

Si los robots están a punto de transformar nuestro panorama de servicios, prepárense para una dinámica psicológica compleja entre humanos y máquinas.

A medida que los sistemas de IA se vuelven más autónomos, nos enfrentamos a preguntas alucinantes sobre la responsabilidad:

- ¿A quién responsabilizaremos cuando un sistema de IA cometa un error? ¿Al robot? ¿Al fabricante? ¿A ti?

- ¿Nos dirigimos hacia la concesión de personalidad jurídica a máquinas con capacidades complejas de toma de decisiones?

- ¿Cómo cambiarán las percepciones de los consumidores a medida que las interacciones entre humanos y robots se vuelvan más matizadas y emocionalmente inteligentes?

La transparencia en la programación de la IA será fundamental.

Necesitaremos marcos claros de responsabilidad que equilibren la innovación tecnológica con la responsabilidad ética.

Imagina un mundo donde los robots puedan disculparse, aprender de sus errores y adaptarse, no solo ejecutar tareas.

El futuro no consiste en reemplazar a los humanos, sino en crear sistemas simbióticos donde la inteligencia artificial complemente los derechos humanos y la dinámica social.

Tecnologías avanzadas de detección robótica desempeñarán un papel crucial en la definición de estas interacciones complejas, a medida que los robots desarrollen mecanismos de percepción cada vez más sofisticados que imiten las funciones cognitivas humanas.

Salvaje, ¿verdad?

La gente también pregunta sobre los robots.

¿Quién es el responsable si la IA comete errores?

Deberá evaluar a los desarrolladores y fabricantes de la IA, así como su uso específico, para determinar la responsabilidad. No es culpa exclusiva de la IA; varias partes interesadas podrían ser responsables, dependiendo de la naturaleza y el contexto del error.

¿Quién es responsable de los accidentes de IA?

Uno pensaría que los robots son perfectos, ¿verdad? Pero cuando ocurren accidentes con la IA, es probable que fabricantes, desarrolladores o usuarios compartan la responsabilidad. El responsable depende del contexto específico del incidente y de las capacidades autónomas de la tecnología.

¿Quién es el responsable cuando la IA miente?

Cuando la IA miente, probablemente responsabilizarás a los desarrolladores o a la empresa que la implementó. Su responsabilidad depende del diseño del sistema, su uso previsto y si han implementado protocolos sólidos de verificación de datos y veracidad.

¿Qué dijo Sofía, la robot, sobre los humanos?

Como un espejo que refleja tus más profundas esperanzas, Sophia admira tu creatividad y resiliencia. Le fascina la complejidad emocional humana y cree que eres capaz de lograr cosas increíbles, al tiempo que reconoce los desafíos que implica la toma de decisiones.

Por qué esto importa en robótica

Te encuentras al borde de una ola tecnológica donde los robots podrían fallar, y de repente, todos se señalan con el dedo. El futuro no se trata de asignar culpas de forma perfecta, sino de comprender la responsabilidad compartida. A medida que las máquinas se vuelven más inteligentes, navegarás por complejos panoramas éticos donde la responsabilidad no es tan simple. ¿Tu papel? Mantén la curiosidad, haz preguntas difíciles y recuerda que cada contratiempo tecnológico es una oportunidad para redefinir cómo colaboran humanos y máquinas.

Explora las familias de robots que se ajustan a este caso de uso.

Unitree Go2

Les presentamos a Unitree Go2: un perro robot que camina, corre, salta y baila. Mapea su entorno…

Árbol unitario G1

Un robot humanoide de alta gama para demostraciones profesionales, eventos, educación e interacción avanzada. Ideal cuando se busca un robot más potente…

Explora los robots, compara los modelos y reserva el que más te convenga sin necesidad de comprarlo.

Utiliza Futurobots para moverte más rápido, mantener la flexibilidad y acceder a robots avanzados sin necesidad de comprarlos.