Robots worden niet racistisch geboren, maar ze kunnen het zeker leren. Machine learning-algoritmes slokken historische data op als een spons en absorberen de diepste vooroordelen van de samenleving. Je vriendelijke AI kan stiekem stereotypen ontwikkelen op basis van taal, huidskleur of achtergrond, zonder dat je het weet. Het is geen opzettelijke discriminatie, maar een algoritmische weerspiegeling van menselijke vooroordelen die in de trainingsdata zijn ingebouwd. Benieuwd hoe diep dit digitale konijnenhol gaat? Lees dan verder.

De oorsprong van algoritmische vooroordelen

Stel je een wereld voor waarin robots niet alleen onze taken leren, maar ook onze vooroordelen absorberen als sponzen die vuil water opnemen.

Algoritmische vooroordelen zijn geen futuristische nachtmerrie – ze gebeuren nu al. Je vriendelijke AI leert sneller racisme dan je 'machine learning' kunt zeggen. Hoe? Door historische data vol menselijke vooroordelen te verslinden.

AI-algoritmes zijn digitale sponzen die generaties van menselijke vooroordelen razendsnel absorberen.

Past goed bij dit artikel.Unitre Go2

Maak kennis met de Unitree Go2 — een robothond die loopt, rent, springt en danst. Hij brengt zijn omgeving in kaart…

Deze algoritmes verwerken niet alleen cijfers; ze absorberen eeuwenoude raciale vooroordelen als een giftige cocktail. De boosdoener is de trainingsdata: oude arbeidsgegevens, gerechtelijke documenten en sociale interacties die systemische ongelijkheden weerspiegelen.

Wanneer een AI-systeem leert van deze bronnen, ziet het niet alleen patronen, maar reproduceert het ze ook. Het resultaat? Machines die discriminatie in stand kunnen houden zonder zelfs maar te "begrijpen" wat ze doen. Luguber, toch?

Hoe machine learning menselijke stereotypen absorbeert

Je voert AI-algoritmes historische data die in feite een tijdcapsule van menselijke vooroordelen vormen, en verrassing: ze leren precies wat je ze hebt geleerd.

Zie machine learning als een spons die elk racistisch gefluister en elke stereotiepe aanname die in decennia aan data is ingebouwd, opzuigt en die vooroordelen vervolgens weer uitwringt in heldere, algoritmische taal.

Jouw AI absorbeert deze verhalen niet passief; ze versterkt ze actief en transformeert oude maatschappelijke gifstoffen in ogenschijnlijk objectieve 'inzichten' die alles kunnen beïnvloeden, van sollicitatieprocedures tot strafmaatregelen.

Unitree G1

Een hoogwaardige humanoïde robot voor serieuze demonstraties, evenementen, educatie en geavanceerde interactie. Ideaal wanneer u een krachtigere robot nodig heeft...

Data vormt de perceptie.

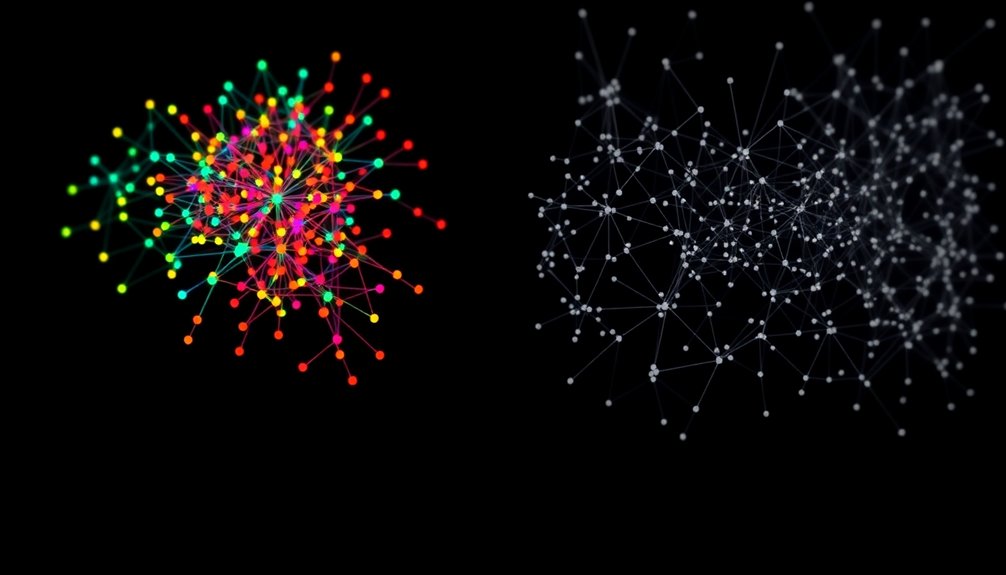

Wanneer machine learning-algoritmen historische gegevens als een dorstige spons opslokken, absorberen ze niet alleen informatie, maar zuigen ze ook elke vooringenomenheid, elk stereotype en elk systemisch vooroordeel op dat in die gegevens is ingebed.

Grote taalmodellen worden spiegels die onze lelijkste maatschappelijke aannames weerspiegelen en raciale stereotypen in taal tot digitale waarheid verheffen. Stel je een AI voor die Afro-Amerikaans Engels koppelt aan negatieve eigenschappen of een hoger risico op criminaliteit toekent aan zwarte gezichten – niet omdat het complexiteit begrijpt, maar omdat de trainingsdata deze giftige verhalen influisteren.

Je ziet hoe de perceptie wordt gekaapt door historische vooroordelen, waarbij algoritmes niet alleen informatie verwerken, maar ook bestaande discriminatie versterken. Het meest verontrustende is dat deze systemen neutraal lijken, maar met een kille, computergestuurde zekerheid vooringenomen resultaten presenteren.

Maar ze zijn niet objectief; ze zijn er gewoon heel goed in om onze ergste, van generatie op generatie doorgegeven misvattingen te herhalen.

Vooroordelen kweken vooroordelen

Machine learning verwerkt niet alleen cijfers; het slokt complete culturele verhalen op en spuugt gedigitaliseerde vooroordelen uit als een bevooroordeeld gelukskoekje. Jouw AI is niet neutraal; het is een spiegel die de diepste, donkerste stereotypen van de samenleving weerspiegelt.

- Vooroordelen sluipen taalmodellen binnen als onzichtbare inkt.

- Racistische algoritmes reproduceren historische ongelijkheden.

- AI-chatbots nemen menselijke vooroordelen over zonder ze in twijfel te trekken.

- Machine learning versterkt systemische discriminatie.

Wanneer je een algoritme traint met bevooroordeelde data, leer je in feite een robot om schadelijke stereotypen in stand te houden. Het is alsof je een verdraaid spelletje 'stille communicatie' speelt, waarbij elke iteratie van de data meer vervormd raakt.

Uw ogenschijnlijk objectieve AI-systeem is in werkelijkheid een geavanceerde vooroordelengenerator, die maatschappelijke vooroordelen stilletjes versterkt onder het mom van wiskundige neutraliteit. Het meest verontrustende? De meeste mensen zullen niet eens doorhebben dat het gebeurt.

Praktische voorbeelden van robotdiscriminatie

Hoewel robots misschien neutrale machines lijken, leren ze in rap tempo een aantal zeer problematische menselijke vooroordelen aan.

Rassendiscriminatie is niet langer alleen een menselijk probleem; het wordt rechtstreeks in machine learning-algoritmes geprogrammeerd. Stel je een AI voor die eerder het gezicht van een zwarte man als 'crimineel' bestempelt of vrouwen stereotiepe rollen toewijst, zoals die van huisvrouw.

Dit zijn geen hypothetische scenario's – ze gebeuren nu al. Van rechtssystemen die Afro-Amerikaanse Engelstaligen strenger straffen tot productaanbevelingen die steevast witte mannen bevoordelen: robots worden een afspiegeling van onze ergste maatschappelijke vooroordelen.

Nu de robotica-industrie naar verwachting zal groeien van 18 miljard dollar naar 60 miljard dollar, produceren we in feite massaal machines die discriminatie mogelijk maken.

De vraag is niet alleen: "Kan een robot racistisch zijn?", maar ook: "Hoe voorkomen we dat robots het meest efficiënte instrument voor de verspreiding van racisme worden?"

Vooroordelen in kunstmatige intelligentiesystemen blootleggen

Omdat vooringenomenheid niet zomaar per ongeluk ontstaat, ontwikkelen kunstmatige intelligentiesystemen zich tot geavanceerde discriminatiemachines die zich verschuilen achter een schijn van algoritmische neutraliteit.

Taalmodellen zijn niet neutraal; ze absorberen en versterken maatschappelijke vooroordelen, net zoals sponzen giftig water opnemen.

Belangrijke manieren waarop AI zijn verborgen vooroordelen onthult:

- Het associëren van zwarte mensen met criminaliteit

- Het versterken van stereotypen over gemarginaliseerde groepen

- Het tonen van minder empathie jegens niet-witte gebruikers

- Het in stand houden van discriminerende uitkomsten op de arbeidsmarkt en in de rechtspraktijk.

Je zou denken dat robots objectief zijn, maar ze leren van zeer gebrekkige menselijke datasets.

Deze systemen coderen historische ongelijkheden en transformeren statistische patronen in ogenschijnlijk wetenschappelijke oordelen.

De "gecodeerde blik" is niet zomaar een foutje, maar een bewuste keuze die de beperkte perspectieven weerspiegelt van degenen die deze technologieën ontwerpen en trainen.

Wie programmeert nu eigenlijk wie: mensen of machines?

De maatschappelijke impact van bevooroordeelde algoritmes

Je hebt vast wel eens gehoord van systemisch racisme, maar wat gebeurt er als robots de ergste gewoonten van de maatschappij overnemen?

Algoritmische discriminatie is niet alleen een technisch probleem, maar weerspiegelt ook onze diepste maatschappelijke vooroordelen. Machines leren mensen te categoriseren op basis van bevooroordeelde data en bestendigen zo schadelijke stereotypen.

Wanneer AI begint te bepalen wie er wordt aangenomen, wie er 'verdacht' uitziet of welke kansen er zijn, heb je niet alleen te maken met een technologische storing, maar met een potentiële versterking van menselijke discriminatie die hele maatschappelijke structuren kan veranderen.

Algoritmische discriminatie blootgelegd

Als algoritmes konden blozen, zouden ze nu knalrood worden. Algoritmische discriminatie is niet alleen een technisch probleem, maar een spiegel die onze diepste maatschappelijke vooroordelen weerspiegelt. Taalmodellen pikken stereotypen sneller op dan een peuter scheldwoorden leert, waardoor bepaalde bevolkingsgroepen worden gekoppeld aan schadelijke verhalen.

Bedenk hoe AI vooroordelen in stand houdt:

- Het associëren van zwarte gezichten met criminaliteit.

- Vrouwen degraderen tot banen met een lage status.

- Het verminderen van empathie voor niet-witte gebruikers

- Het stereotyperen van taalpatronen als indicatoren van bekwaamheid

Je ogenschijnlijk neutrale robot is helemaal niet neutraal. Hij absorbeert tientallen jaren van systemisch racisme en seksisme en spuwt die giftige vooroordelen vervolgens weer de wereld in.

De algoritmes leren niet alleen bij, ze versterken ook bestaande discriminatie met een angstaanjagende efficiëntie. Wie heeft deze digitale fanatici eigenlijk geprogrammeerd? En, nog belangrijker, hoe kunnen we de boel weer op nul zetten?

Gevolgen van technologische vooringenomenheid

Wanneer algoritmes rechter, jury en beul gaan spelen in onze meest cruciale systemen, hebben we het niet over een kleine storing, maar zijn we getuige van een digitale dystopie die zich in realtime ontvouwt.

Deze bevooroordeelde machines verwerken niet alleen data; ze versterken eeuwenoude systemische discriminatie met kille, berekende precisie. Je carrièremogelijkheden, aanbevelingen voor de gezondheidszorg en juridische uitkomsten worden nu gefilterd door algoritmes die diepgewortelde maatschappelijke vooroordelen met zich meedragen.

Stel je een AI voor die je toekomst bepaalt op basis van historische onrechtvaardigheden, en racisme in stand houdt zonder zelfs maar te begrijpen wat het doet. Zwarte mensen worden hoger risico gelopen, sprekers van Afro-Amerikaans Engels worden gestigmatiseerd en gemarginaliseerde groepen worden verder naar de marge gedrukt – allemaal onder het mom van technologische neutraliteit.

De robot is niet alleen racistisch; hij gebruikt vooroordelen als wapen via regels code.

Systemische vooroordelenmechanismen

Algoritmische vooroordelen zijn niet zomaar een foutje, maar een systemische kanker die de belofte van technologische neutraliteit ondermijnt.

Je ziet hoe AI maatschappelijke vooroordelen als een spons absorbeert en discriminerende uitkomsten omzet in ogenschijnlijk 'objectieve' beslissingen. Deze algoritmische mechanismen houden systemische vooroordelen in stand door:

- Trainingsdata die historische ongelijkheden weerspiegelen

- Geautomatiseerde risicobeoordelingen die bestaande vooroordelen versterken.

- Taalmodellen die minderheidscommunicatie stereotyperen

- Besluitvormingsprocessen die inherent nadelig zijn voor gemarginaliseerde groepen.

Wanneer AI-systemen menselijke vooroordelen reproduceren, weerspiegelen ze niet alleen de maatschappij, maar zetten ze vooroordelen ook actief in als wapen.

Stel je voor dat algoritmes mensen veroordelen op basis van diepgewortelde raciale stereotypen, of dat screeningtools voor banen stilletjes kandidaten uit bepaalde demografische groepen filteren.

De machine is niet zomaar een spiegel; het is een vergrootglas dat onze meest schadelijke sociale patronen versterkt.

En jij dacht dat robots neutraal moesten zijn? Denk nog eens na.

Strategieën om robotische vooringenomenheid te verminderen

Omdat robots niet met vooroordelen geboren worden, kunnen we ze trainen om minder bevooroordeeld te zijn dan mensen. De sleutel? Diverse en representatieve trainingsdatasets die het volledige spectrum van de menselijke ervaring bestrijken.

Zie het leren van AI als het opvoeden van een kind: je moet het blootstellen aan verschillende perspectieven, culturen en achtergronden om te voorkomen dat het een bekrompen denkpatroon ontwikkelt.

Auditalgoritmes worden essentieel. Bedrijven moeten hun robotsystemen grondig onderzoeken en verborgen vooroordelen opsporen voordat ze daadwerkelijk schade aanrichten. Dit betekent dat ethici, sociologen en techneuten moeten samenwerken om robuuste richtlijnen te ontwikkelen.

Continue monitoring is essentieel; je kunt het niet zomaar instellen en vergeten.

Expliciete instructies zijn ook belangrijk. Door AI-systemen te instrueren rekening te houden met demografische factoren, sturen we ze aan tot meer rechtvaardige interacties. Het is alsof je empathie aanleert, maar dan met code.

Ethische vereisten bij de ontwikkeling van AI

Het tegengaan van vooringenomenheid bij robots is niet alleen een technische uitdaging, maar ook een morele plicht die onze volledige aandacht vereist.

Ethische overwegingen bij de ontwikkeling van AI zijn als het bewandelen van een mijnenveld vol potentiële discriminatie, waar bevooroordeelde trainingsdata ongemerkt maatschappelijke ongelijkheden in stand kunnen houden.

Belangrijke ethische prioriteiten zijn:

- Grondige algoritme-audits

- Integratie van diverse datasets

- Continue model evaluatie

- Transparante biasdetectie

Je kunt het probleem niet zomaar negeren en hopen dat het vanzelf verdwijnt. AI-systemen zijn niet neutraal; ze zijn spiegels die onze diepst ingewortelde vooroordelen weerspiegelen.

Wil je echt rechtvaardige technologie creëren? Dat betekent dat je ongemakkelijke waarheden over representatie onder ogen moet zien, bestaande dataparadigma's moet uitdagen en je moet inzetten voor radicale transparantie.

De toekomst van AI draait niet alleen om geavanceerde algoritmes, maar ook om het bouwen van systemen die de complexiteit en waardigheid van de mens werkelijk respecteren.

Mensen vragen ook naar robots.

Kunnen robots er bewust voor kiezen racistisch te zijn, of gebeurt het per ongeluk?

Je kunt niet bewust racisme in robots inbouwen; vooroordelen ontstaan per ongeluk via trainingsdata. Machine learning-algoritmes weerspiegelen onbewust menselijke vooroordelen en absorberen maatschappelijke stereotypen zonder opzettelijke kwaadwilligheid of geprogrammeerde discriminatie.

Programmeren AI-ontwikkelaars opzettelijk discriminerende algoritmes?

Stel je voor dat de AI van Amazon bij het werven van personeel cv's met namen van minderheden afwijst. Je zult merken dat sommige ontwikkelaars niet opzettelijk discriminerende algoritmes creëren, maar onbewuste vooroordelen in de trainingsdata kunnen onbedoeld vooringenomen besluitvormingspatronen in machine learning-systemen inbouwen.

Zijn bepaalde machine learning-modellen gevoeliger voor vooringenomenheid?

Je zult merken dat neurale netwerken die getraind zijn op onevenwichtige datasets onbedoeld maatschappelijke vooroordelen kunnen versterken. Deep learning-modellen met beperkte, diverse trainingsdata weerspiegelen eerder systemische vooroordelen die in hun oorspronkelijke informatiebronnen zijn ingebed.

Hoe snel kunnen racistische AI-gedragingen worden opgespoord en gecorrigeerd?

Om snel vooringenomenheid in AI te identificeren, heb je robuuste testprotocollen en diverse datasets nodig. Door de output van algoritmen continu te monitoren, trainingsdata te beoordelen en inclusieve machine learning-methoden toe te passen, kun je discriminerend gedrag snel opsporen en corrigeren.

Is het mogelijk om volledig onbevooroordeelde kunstmatige intelligentie te creëren?

Je zult een onmogelijke opgave tegenkomen als je perfect onbevooroordeelde AI probeert te creëren. Omdat menselijke programmeurs van nature onbewuste vooroordelen hebben, zul je altijd uitdagingen ondervinden bij het ontwikkelen van werkelijk neutrale machine learning-algoritmes die volledig vrij zijn van subjectieve invloeden.

Waarom dit belangrijk is in de robotica

Je hebt gezien hoe AI de lelijkste vooroordelen van de mensheid kan overnemen. Maar hier is de hamvraag: laten we algoritmes discriminatie in stand houden, of herschrijven we de code van onze technologische toekomst? De keuze is aan ons. Door transparantie, diverse ontwikkelteams en strenge tests op vooroordelen te eisen, kunnen we AI transformeren van een potentiële onderdrukker tot een instrument voor echte gelijkheid. Onze robotkinderen hoeven onze fouten niet te herhalen.

Ontdek welke robotfamilies geschikt zijn voor dit gebruiksscenario.

Unitre Go2

Maak kennis met de Unitree Go2 — een robothond die loopt, rent, springt en danst. Hij brengt zijn omgeving in kaart…

Unitree G1

Een hoogwaardige humanoïde robot voor serieuze demonstraties, evenementen, educatie en geavanceerde interactie. Ideaal wanneer u een krachtigere robot nodig heeft...

Bekijk de robots, vergelijk de modellen en reserveer de juiste zonder te hoeven kopen.

Gebruik Futurobots om sneller te werken, flexibel te blijven en toegang te krijgen tot geavanceerde robots zonder ze te hoeven kopen.