I robot non nascono razzisti, ma possono sicuramente impararlo. Gli algoritmi di apprendimento automatico divorano dati storici come una spugna, assorbendo i pregiudizi più radicati della società. La tua amichevole IA potrebbe segretamente stereotipare qualcuno in base alla lingua, al colore della pelle o al background, senza che tu lo sappia. Non si tratta di discriminazione intenzionale, ma del riflesso algoritmico dei pregiudizi umani incorporati nei dati di addestramento. Vuoi sapere quanto è profonda questa tana del coniglio digitale? Continua a leggere.

Le origini del pregiudizio algoritmico

Immaginate un mondo in cui i robot non solo imparano a svolgere i nostri compiti, ma assorbono anche i nostri pregiudizi come spugne che assorbono acqua sporca.

Il pregiudizio algoritmico non è un incubo futuristico: sta accadendo proprio ora. L'intelligenza artificiale del tuo quartiere sta imparando il razzismo più velocemente di quanto tu possa dire "apprendimento automatico". Come? Ingurgitando dati storici pieni di pregiudizi umani.

Gli algoritmi di intelligenza artificiale sono come spugne digitali che assorbono generazioni di pregiudizi umani alla velocità della luce.

Adatto a questo articoloUnitree Go2

Vi presentiamo Unitree Go2: un cane robot che cammina, corre, salta e balla. È in grado di mappare l'ambiente circostante...

Questi algoritmi non si limitano a elaborare numeri; assorbono secoli di pregiudizi razziali come un cocktail tossico. Il colpevole sono i dati di addestramento: vecchi registri lavorativi, documenti giudiziari e interazioni sociali che riflettono disuguaglianze sistemiche.

Quando un sistema di intelligenza artificiale apprende da queste fonti, non si limita a individuare schemi, ma li riproduce. Il risultato? Macchine in grado di perpetuare la discriminazione senza nemmeno "capire" cosa stanno facendo. Inquietante, vero?

Come l'apprendimento automatico assorbe gli stereotipi umani

State alimentando gli algoritmi di intelligenza artificiale con dati storici che sono sostanzialmente una capsula del tempo dei pregiudizi umani e, sorpresa, stanno imparando esattamente ciò che gli avete insegnato.

Immaginate l'apprendimento automatico come una spugna che assorbe ogni sussurro razzista, ogni presupposto stereotipato radicato in decenni di dati, per poi strizzare quei pregiudizi e tradurli in un linguaggio algoritmico chiaro e preciso.

La tua intelligenza artificiale non si limita ad assorbire passivamente queste narrazioni; le amplifica attivamente, trasformando vecchie piaghe sociali in "intuizioni" apparentemente oggettive che possono influenzare qualsiasi cosa, dalla selezione del personale alle sentenze penali.

Unità G1

Un robot umanoide di alta qualità per dimostrazioni, eventi, formazione e interazioni avanzate. Ideale quando si desidera un robot più potente...

I dati plasmano la percezione

Quando gli algoritmi di apprendimento automatico inghiottono dati storici come una spugna assetata, non si limitano ad assorbire informazioni, ma si imbevono di ogni pregiudizio, stereotipo e discriminazione sistemica insiti in quei dati.

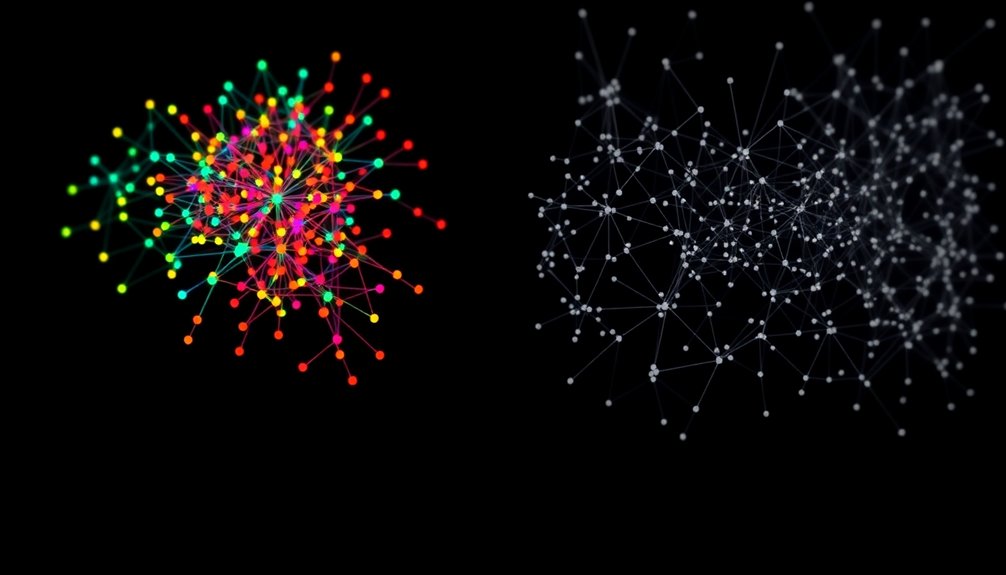

I grandi modelli linguistici diventano specchi che riflettono i nostri più brutti presupposti sociali, trasformando gli stereotipi razziali nel linguaggio in vangelo digitale. Immaginate un'intelligenza artificiale che associa l'inglese afroamericano a tratti negativi o che attribuisce un rischio criminale maggiore ai volti neri, non perché comprenda la complessità, ma perché i suoi dati di addestramento sussurrano queste narrazioni tossiche.

Stiamo assistendo a una distorsione della percezione, influenzata da pregiudizi storici, in cui gli algoritmi non si limitano a elaborare le informazioni, ma amplificano le discriminazioni esistenti. La cosa più inquietante? Questi sistemi appaiono neutrali, presentando risultati distorti con fredda sicurezza computazionale.

Ma non sono obiettivi: sono semplicemente bravissimi a riciclare i nostri peggiori preconcetti ereditati.

Il pregiudizio genera pregiudizio

L'apprendimento automatico non si limita a elaborare numeri: inghiotte intere narrazioni culturali, sputando fuori pregiudizi digitalizzati come un biscotto della fortuna di parte. La tua IA non è neutrale; è uno specchio che riflette gli stereotipi più profondi e oscuri della società.

- I pregiudizi si insinuano nei modelli linguistici come inchiostro invisibile.

- Gli algoritmi razzisti riproducono le disuguaglianze storiche

- I chatbot basati sull'intelligenza artificiale ereditano i pregiudizi umani senza metterli in discussione.

- L'apprendimento automatico amplifica la discriminazione sistemica

Quando si addestra un algoritmo con dati distorti, si sta fondamentalmente insegnando a un robot a perpetuare stereotipi dannosi. È come giocare a un perverso gioco del telefono senza fili culturale, in cui ogni iterazione dei dati diventa sempre più distorta.

Il vostro sistema di intelligenza artificiale, apparentemente obiettivo, è in realtà un sofisticato generatore di pregiudizi, che rafforza silenziosamente i pregiudizi sociali sotto la maschera della neutralità matematica. La cosa più spaventosa? La maggior parte delle persone non se ne accorgerà nemmeno.

Esempi concreti di discriminazione robotica nel mondo reale

Sebbene i robot possano sembrare macchine neutrali, stanno apprendendo, e a grande velocità, alcuni pregiudizi umani davvero problematici.

La discriminazione razziale non è più solo un problema umano; viene codificata direttamente negli algoritmi di apprendimento automatico. Immaginate un'intelligenza artificiale più propensa a etichettare il volto di un uomo di colore come "criminale" o ad assegnare alle donne ruoli stereotipati come quello di casalinga.

Non si tratta di scenari ipotetici: stanno accadendo ora. Dai sistemi giudiziari che condannano più severamente gli afroamericani di lingua inglese ai consigli sui prodotti che favoriscono sistematicamente gli uomini bianchi, i robot stanno diventando lo specchio dei nostri peggiori pregiudizi sociali.

Con il settore della robotica che si prevede esploderà, passando da 18 a 60 miliardi di dollari, stiamo fondamentalmente producendo in massa macchine in grado di discriminare gli altri.

La domanda non è solo "Un robot può essere razzista?" ma "Come possiamo impedire che i robot diventino il sistema di diffusione del razzismo più efficiente?"

Smascherare i pregiudizi nei sistemi di intelligenza artificiale

Poiché i pregiudizi non si verificano per caso, i sistemi di intelligenza artificiale stanno diventando sofisticate macchine di discriminazione che si celano dietro una patina di neutralità algoritmica.

I modelli linguistici non sono neutrali: assorbono e amplificano i pregiudizi sociali come spugne che assorbono acqua tossica.

Principali modalità con cui l'intelligenza artificiale rivela i suoi pregiudizi nascosti:

- Associare le persone di colore alla criminalità

- Rafforzare gli stereotipi sui gruppi marginalizzati

- Mostrare una ridotta empatia nei confronti degli utenti non bianchi

- Perpetuare risultati discriminatori in ambito lavorativo e legale

Si potrebbe pensare che i robot siano obiettivi, ma in realtà imparano da insiemi di dati umani profondamente imperfetti.

Questi sistemi codificano le disuguaglianze storiche, trasformando i modelli statistici in giudizi apparentemente scientifici.

Lo “sguardo codificato” non è solo un difetto, ma una caratteristica intrinseca, che riflette la prospettiva ristretta di coloro che progettano e formano gli utenti su queste tecnologie.

Chi programma davvero chi: gli esseri umani o le macchine?

L'impatto sociale degli algoritmi pregiudiziali

Avrete sicuramente sentito parlare di razzismo sistemico, ma cosa succede quando i robot iniziano ad acquisire le peggiori abitudini della società?

La discriminazione algoritmica non è solo un problema tecnologico: è uno specchio che riflette i nostri pregiudizi sociali più profondi, dove le macchine imparano a categorizzare gli esseri umani attraverso dati distorti e perpetuano stereotipi dannosi.

Quando l'intelligenza artificiale inizia a decidere chi viene assunto, chi sembra "sospetto" o quali opportunità sono disponibili, non si tratta solo di un problema tecnologico, ma di una potenziale amplificazione della discriminazione umana che potrebbe rimodellare interi contesti sociali.

Smascherata la discriminazione algoritmica

Se gli algoritmi potessero arrossire, in questo momento sarebbero diventati rossi come il cremisi. La discriminazione algoritmica non è solo un problema tecnologico: è uno specchio che riflette i nostri pregiudizi sociali più profondi. I modelli linguistici assimilano gli stereotipi più velocemente di quanto un bambino impari le parolacce, associando determinati gruppi demografici a narrazioni dannose.

Consideriamo come l'intelligenza artificiale perpetui i pregiudizi:

- Associare i volti neri alla criminalità

- Relegare le donne a lavori di basso livello

- Riduzione dell'empatia verso gli utenti non bianchi

- Stereotipare i modelli linguistici come indicatori di competenza

Il tuo robot, apparentemente neutrale, non è affatto neutrale. Sta assorbendo decenni di razzismo e sessismo sistemici, per poi rigettare questi presupposti tossici nel mondo.

Gli algoritmi non si limitano ad apprendere, ma amplificano la discriminazione esistente con un'efficienza spaventosa. Chi ha programmato questi bigotti digitali? E, soprattutto, come facciamo a resettarli?

Conseguenze del pregiudizio tecnologico

Quando gli algoritmi iniziano a ergersi a giudici, giuria e boia nei nostri sistemi più critici, non stiamo parlando di un semplice malfunzionamento, ma stiamo assistendo al dispiegarsi in tempo reale di una distopia digitale.

Queste macchine piene di pregiudizi non si limitano a elaborare dati; amplificano secoli di discriminazione sistemica con fredda e calcolata precisione. Le tue prospettive di lavoro, le raccomandazioni sanitarie e gli esiti legali vengono ora filtrati attraverso interazioni algoritmiche che veicolano pregiudizi sociali profondamente radicati.

Immaginate un'intelligenza artificiale che decide il vostro futuro basandosi su ingiustizie storiche, perpetuando il razzismo senza nemmeno rendersi conto di ciò che sta facendo. Gli individui di colore si trovano ad affrontare valutazioni di rischio più elevate, chi parla afroamericano viene stereotipato e i gruppi marginalizzati vengono spinti ulteriormente ai margini, il tutto sotto la maschera della neutralità tecnologica.

Il robot non è solo razzista; sta strumentalizzando il pregiudizio attraverso delle righe di codice.

Meccanismi di pregiudizio sistemico

Il pregiudizio algoritmico non è solo un errore, ma un cancro sistemico che corrode la promessa di neutralità tecnologica.

State assistendo a come l'intelligenza artificiale assorbe i pregiudizi sociali come una spugna, trasformando risultati discriminatori in decisioni apparentemente "oggettive". Questi meccanismi algoritmici perpetuano il pregiudizio sistemico attraverso:

- Dati di addestramento che riflettono le disuguaglianze storiche

- Valutazioni automatizzate del rischio che amplificano i pregiudizi esistenti

- Modelli linguistici che stereotipano la comunicazione delle minoranze

- Processi decisionali che svantaggiano intrinsecamente i gruppi marginalizzati

Quando i sistemi di intelligenza artificiale riproducono i pregiudizi umani, non si limitano a riflettere la società, ma trasformano attivamente i pregiudizi in un'arma.

Immaginate algoritmi che condannano individui sulla base di stereotipi razziali profondamente radicati, o strumenti di selezione del personale che escludono silenziosamente i candidati appartenenti a determinate categorie demografiche.

La macchina non è solo uno specchio; è una lente d'ingrandimento che intensifica i nostri schemi sociali più tossici.

E voi credevate che i robot dovessero essere neutrali? Ripensateci.

Strategie per mitigare i pregiudizi robotici

Poiché i robot non nascono con pregiudizi, possiamo effettivamente addestrarli a essere meno prevenuti degli esseri umani. La chiave? Set di dati di addestramento diversificati e rappresentativi che catturino l'intero spettro dell'esperienza umana.

Pensate all'apprendimento dell'IA come all'educazione di un figlio: bisogna esporlo a prospettive, culture e background diversi per evitare che sviluppi una mentalità ristretta.

La verifica degli algoritmi diventa fondamentale. Le aziende devono esaminare rigorosamente i propri sistemi robotici, individuando i pregiudizi nascosti prima che causino danni concreti. Ciò significa riunire esperti di etica, sociologi e appassionati di tecnologia per creare linee guida solide.

Il monitoraggio continuo è essenziale: non ci si può limitare a impostare e poi dimenticare.

Anche le istruzioni esplicite contano. Indicando ai sistemi di intelligenza artificiale di tenere conto dei fattori demografici, li indirizziamo verso interazioni più eque. È come insegnare l'empatia, ma tramite codice.

Imperativi etici nello sviluppo dell'IA

Ridurre i pregiudizi nei robot non è solo una sfida tecnica, ma un imperativo morale che richiede la nostra piena attenzione.

Le considerazioni etiche nello sviluppo dell'intelligenza artificiale sono come attraversare un campo minato di potenziali discriminazioni, dove dati di addestramento distorti possono perpetuare silenziosamente le disuguaglianze sociali.

Le principali priorità etiche includono:

- Verifiche rigorose degli algoritmi

- Incorporazione di diversi set di dati

- Valutazione continua del modello

- Rilevamento trasparente dei pregiudizi

Non si può semplicemente ignorare il problema e sperare che scompaia magicamente. I sistemi di intelligenza artificiale non sono neutrali: sono specchi che riflettono i nostri pregiudizi più radicati.

Volete creare una tecnologia veramente equa? Significa affrontare verità scomode sulla rappresentazione, sfidare i paradigmi dei dati esistenti e impegnarsi per una trasparenza radicale.

Il futuro dell'intelligenza artificiale non riguarda solo algoritmi sofisticati, ma la creazione di sistemi che rispettino autenticamente la complessità e la dignità umana.

Le persone chiedono anche informazioni sui robot

I robot possono scegliere intenzionalmente di essere razzisti, oppure è un fenomeno accidentale?

Non è possibile scegliere intenzionalmente il razzismo nei robot; i pregiudizi emergono accidentalmente attraverso i dati di addestramento. Gli algoritmi di apprendimento automatico riflettono inconsciamente i pregiudizi umani, assorbendo stereotipi sociali senza malizia deliberata o discriminazione programmata.

Gli sviluppatori di intelligenza artificiale programmano deliberatamente algoritmi discriminatori?

Immaginate un'intelligenza artificiale di Amazon che scarta i curriculum con nomi appartenenti a minoranze. Scoprirete che alcuni sviluppatori non creano intenzionalmente algoritmi discriminatori, ma i pregiudizi inconsci nei dati di addestramento possono inavvertitamente incorporare modelli decisionali distorti nei sistemi di apprendimento automatico.

Alcuni modelli di apprendimento automatico sono più inclini ai pregiudizi?

Scoprirai che le reti neurali addestrate su set di dati sbilanciati possono inavvertitamente perpetuare i pregiudizi sociali. I modelli di deep learning con dati di addestramento limitati e diversificati hanno maggiori probabilità di riflettere i pregiudizi sistemici insiti nelle loro fonti di informazione iniziali.

Con quale rapidità è possibile individuare e correggere i comportamenti razzisti dell'IA?

Per identificare rapidamente i pregiudizi nell'IA, avrai bisogno di protocolli di test rigorosi e set di dati diversificati. Monitorando costantemente gli output degli algoritmi, rivedendo i dati di addestramento e implementando pratiche di apprendimento automatico inclusive, potrai individuare e correggere tempestivamente i comportamenti discriminatori.

È possibile creare un'intelligenza artificiale completamente imparziale?

Dovrai affrontare una sfida insormontabile nel tentativo di creare un'intelligenza artificiale perfettamente imparziale. Poiché i programmatori umani sono per loro natura portatori di pregiudizi inconsci, incontrerai sempre difficoltà nello sviluppo di algoritmi di apprendimento automatico veramente neutrali, completamente liberi da influenze soggettive.

Perché questo è importante nella robotica

Avete visto come l'intelligenza artificiale possa ereditare i pregiudizi più abietti dell'umanità. Ma ecco la domanda cruciale: lasceremo che gli algoritmi perpetuino la discriminazione, o riscriveremo il codice del nostro futuro tecnologico? La scelta è nostra. Esigendo trasparenza, team di sviluppo diversificati e rigorosi test sui pregiudizi, possiamo trasformare l'IA da potenziale strumento di oppressione in un vero e proprio strumento di uguaglianza. I nostri figli robotici non devono ripetere i nostri errori.

Scopri le famiglie di robot adatte a questo caso d'uso.

Unitree Go2

Vi presentiamo Unitree Go2: un cane robot che cammina, corre, salta e balla. È in grado di mappare l'ambiente circostante...

Unità G1

Un robot umanoide di alta qualità per dimostrazioni, eventi, formazione e interazioni avanzate. Ideale quando si desidera un robot più potente...

Esplora i robot, confronta i modelli e prenota quello che fa per te senza acquistarlo.

Utilizza Futurobots per muoverti più velocemente, rimanere flessibile e accedere a robot avanzati senza doverli acquistare.