Los robots no nacen racistas, pero sin duda pueden aprenderlo. Los algoritmos de aprendizaje automático absorben datos históricos como una esponja, asimilando los prejuicios más arraigados de la sociedad. Tu IA amigable podría, sin que te des cuenta, estereotiparte en secreto por tu idioma, color de piel o procedencia. No se trata de discriminación intencional, sino de un reflejo algorítmico de los sesgos humanos incorporados en los datos de entrenamiento. ¿Quieres saber hasta dónde llega este laberinto digital? Sigue leyendo.

Los orígenes del prejuicio algorítmico

Imagina un mundo donde los robots no solo aprenden nuestras tareas, sino que absorben nuestros prejuicios como esponjas que absorben agua sucia.

El sesgo algorítmico no es una pesadilla futurista: está ocurriendo ahora mismo. La IA, tu vecina de confianza, está aprendiendo racismo más rápido de lo que te imaginas. ¿Cómo? Devorando datos históricos repletos de prejuicios humanos.

Los algoritmos de IA son como esponjas digitales que absorben generaciones de prejuicios humanos a la velocidad del rayo.

Encaja bien con este artículo.Unitree Go2

Les presentamos a Unitree Go2: un perro robot que camina, corre, salta y baila. Mapea su entorno…

Estos algoritmos no solo procesan datos; absorben siglos de prejuicios raciales como si fueran un cóctel tóxico. Los datos de entrenamiento son los culpables: antiguos registros laborales, documentos judiciales e interacciones sociales que reflejan desigualdades sistémicas.

Cuando un sistema de IA aprende de estas fuentes, no solo detecta patrones, sino que los reproduce. ¿El resultado? Máquinas capaces de perpetuar la discriminación sin siquiera "entender" lo que hacen. Da miedo, ¿verdad?

Cómo el aprendizaje automático absorbe los estereotipos humanos

Estás alimentando los algoritmos de IA con datos históricos que son básicamente una cápsula del tiempo de los prejuicios humanos, y sorpresa: están aprendiendo exactamente lo que les has estado enseñando.

Piensa en el aprendizaje automático como una esponja que absorbe cada susurro racista, cada suposición estereotipada arraigada en décadas de datos, para luego exprimir esos prejuicios en un lenguaje algorítmico y preciso.

Tu IA no se limita a absorber pasivamente estas narrativas; las amplifica activamente, convirtiendo viejas toxicidades sociales en "conocimientos" aparentemente objetivos que pueden influir en todo, desde la selección de personal hasta las sentencias penales.

Árbol unitario G1

Un robot humanoide de alta gama para demostraciones profesionales, eventos, educación e interacción avanzada. Ideal cuando se busca un robot más potente…

Los datos dan forma a la percepción.

Cuando los algoritmos de aprendizaje automático devoran datos históricos como una esponja sedienta, no solo absorben información, sino que también absorben todos los sesgos, estereotipos y prejuicios sistémicos incrustados en esos registros.

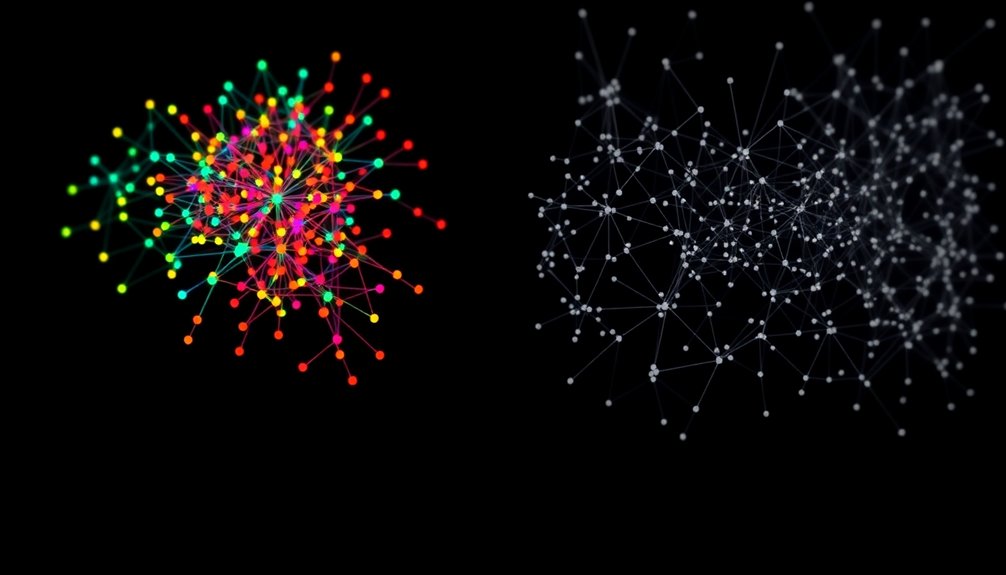

Los grandes modelos lingüísticos se convierten en espejos que reflejan nuestros prejuicios sociales más oscuros, transformando los estereotipos raciales en una verdad absoluta. Imaginemos una IA que asocia el inglés afroamericano con rasgos negativos o que asigna un mayor riesgo criminal a los rostros negros, no porque comprenda la complejidad, sino porque sus datos de entrenamiento susurran estas narrativas tóxicas.

Estás presenciando cómo la percepción se ve manipulada por prejuicios históricos, donde los algoritmos no solo procesan información, sino que amplifican la discriminación existente. ¿Lo más aterrador? Estos sistemas aparentan neutralidad, presentando resultados sesgados con una fría seguridad computacional.

Pero no son objetivos; simplemente son muy buenos reciclando nuestras peores ideas erróneas heredadas.

Los prejuicios engendran prejuicios.

El aprendizaje automático no se limita a procesar números, sino que absorbe narrativas culturales enteras, escupiendo prejuicios digitalizados como una galleta de la fortuna sesgada. Tu IA no es neutral; es un espejo que refleja los estereotipos más profundos y oscuros de la sociedad.

- Los sesgos se infiltran en los modelos lingüísticos como tinta invisible.

- Los algoritmos racistas reproducen las desigualdades históricas.

- Los chatbots de IA heredan los prejuicios humanos sin cuestionarlos.

- El aprendizaje automático amplifica la discriminación sistémica.

Cuando entrenas un algoritmo con datos sesgados, básicamente estás enseñando a un robot a perpetuar estereotipos dañinos. Es como jugar a un retorcido juego del teléfono cultural, donde cada iteración de los datos se vuelve más distorsionada.

Tu sistema de IA, aparentemente objetivo, es en realidad un sofisticado generador de prejuicios que refuerza silenciosamente los sesgos sociales bajo la apariencia de neutralidad matemática. ¿Lo más aterrador? La mayoría de la gente ni siquiera se dará cuenta.

Ejemplos reales de discriminación robótica

Aunque los robots puedan parecer máquinas neutrales, están aprendiendo algunos sesgos humanos muy problemáticos, y a gran velocidad.

La discriminación racial ya no es solo un problema humano; se está incorporando directamente a los algoritmos de aprendizaje automático. Imagínese una IA que tenga más probabilidades de identificar el rostro de un hombre negro como "criminal" o de asignar a las mujeres roles estereotipados como el de ama de casa.

No se trata de escenarios hipotéticos: están ocurriendo ahora mismo. Desde sistemas judiciales que condenan con mayor severidad a los afroamericanos angloparlantes hasta recomendaciones de productos que favorecen sistemáticamente a los hombres blancos, los robots se están convirtiendo en reflejos de nuestros peores prejuicios sociales.

Dado que se prevé que la industria robótica se dispare de 18 millones de dólares a 60 millones, estamos produciendo en masa máquinas de discriminación.

La pregunta no es solo "¿Puede un robot ser racista?", sino "¿Cómo evitamos que los robots se conviertan en el sistema de difusión más eficiente del racismo?".

Desenmascarando los sesgos en los sistemas de inteligencia artificial

Dado que los prejuicios no surgen por casualidad, los sistemas de inteligencia artificial se están convirtiendo en sofisticadas máquinas de discriminación que se esconden tras una apariencia de neutralidad algorítmica.

Los modelos lingüísticos no son neutrales: absorben y amplifican los prejuicios sociales como esponjas que absorben agua tóxica.

Principales maneras en que la IA revela sus sesgos ocultos:

- Asociar a las personas negras con la criminalidad

- Reforzar los estereotipos sobre los grupos marginados

- Mostrar menor empatía hacia los usuarios no blancos

- Perpetuando resultados laborales y legales discriminatorios

Podrías pensar que los robots son objetivos, pero aprenden a partir de conjuntos de datos humanos profundamente defectuosos.

Estos sistemas codifican las desigualdades históricas, transformando los patrones estadísticos en juicios aparentemente científicos.

La “mirada codificada” no es solo un fallo, sino una característica que refleja las perspectivas limitadas de quienes diseñan y entrenan estas tecnologías.

¿Quién programa realmente a quién: los humanos o las máquinas?

El impacto social de los algoritmos sesgados

Has oído hablar del racismo sistémico, pero ¿qué ocurre cuando los robots empiezan a adquirir los peores hábitos de la sociedad?

La discriminación algorítmica no es solo un problema tecnológico, sino un espejo que refleja nuestros prejuicios sociales más profundos, donde las máquinas aprenden a categorizar a los humanos a través de datos sesgados y perpetúan estereotipos dañinos.

Cuando la IA empieza a decidir quién es contratado, quién parece "sospechoso" o qué oportunidades están disponibles, no solo estamos ante un fallo tecnológico, sino ante una posible amplificación de la discriminación humana que podría transformar por completo el panorama social.

Discriminación algorítmica al descubierto

Si los algoritmos pudieran sonrojarse, ahora mismo estarían rojos como la sangre. La discriminación algorítmica no es solo un problema tecnológico, sino un reflejo de nuestros prejuicios sociales más arraigados. Los modelos lingüísticos captan estereotipos más rápido que un niño pequeño aprende palabrotas, asociando a ciertos grupos demográficos con narrativas dañinas.

Consideremos cómo la IA perpetúa los prejuicios:

- Asociar rostros negros con la criminalidad

- Relegar a las mujeres a trabajos de bajo estatus.

- Reducción de la empatía hacia los usuarios no blancos

- Estereotipos sobre patrones lingüísticos como indicadores de capacidad.

Tu robot, aparentemente neutral, no lo es en absoluto. Está absorbiendo décadas de racismo y sexismo sistémicos, para luego escupir esas ideas tóxicas de vuelta al mundo.

Los algoritmos no solo aprenden, sino que amplifican la discriminación existente con una eficacia aterradora. ¿Quién programó a estos intolerantes digitales? Y, lo que es más importante, ¿cómo podemos reiniciar el sistema?

Consecuencias del sesgo tecnológico

Cuando los algoritmos empiezan a hacer de juez, jurado y verdugo en nuestros sistemas más críticos, no hablamos simplemente de un fallo técnico, sino que estamos presenciando el desarrollo en tiempo real de una distopía digital.

Estas máquinas sesgadas no solo procesan datos; amplifican siglos de discriminación sistémica con fría precisión calculada. Tus perspectivas laborales, recomendaciones de atención médica y resultados legales ahora se filtran mediante interacciones algorítmicas que portan sesgos sociales profundamente arraigados.

Imagina una IA que decide tu futuro basándose en injusticias históricas, perpetuando el racismo sin siquiera comprender lo que hace. Las personas negras se enfrentan a mayores riesgos, los hablantes de inglés afroamericano son estereotipados y los grupos marginados son relegados aún más a los márgenes, todo bajo el pretexto de la neutralidad tecnológica.

El robot no solo es racista; está instrumentalizando el prejuicio a través de líneas de código.

Mecanismos de prejuicio sistémico

El sesgo algorítmico no es solo un fallo, sino un cáncer sistémico que está erosionando la promesa de neutralidad tecnológica.

Estás presenciando cómo la IA absorbe los prejuicios sociales como una esponja, transformando resultados discriminatorios en decisiones aparentemente “objetivas”. Estos mecanismos algorítmicos perpetúan el prejuicio sistémico a través de:

- Datos de capacitación que reflejan las desigualdades históricas.

- Evaluaciones de riesgo automatizadas que amplifican los sesgos existentes

- Modelos lingüísticos que estereotipan la comunicación de las minorías

- Procesos de toma de decisiones que inherentemente perjudican a los grupos marginados.

Cuando los sistemas de IA reproducen los prejuicios humanos, no solo reflejan a la sociedad, sino que utilizan activamente los sesgos como arma.

Imagínese algoritmos que condenan a personas basándose en estereotipos raciales profundamente arraigados, o herramientas de selección de personal que filtran silenciosamente a candidatos de ciertos grupos demográficos.

La máquina no es solo un espejo; es una lupa que intensifica nuestros patrones sociales más tóxicos.

¿Y pensabas que los robots debían ser neutrales? Piénsalo de nuevo.

Estrategias para mitigar el sesgo robótico

Dado que los robots no nacen con prejuicios, podemos entrenarlos para que sean menos parciales que los humanos. ¿La clave? Conjuntos de datos de entrenamiento diversos y representativos que abarquen todo el espectro de la experiencia humana.

Piensa en el aprendizaje de la IA como en la crianza de un hijo: tienes que exponerlo a diferentes perspectivas, culturas y orígenes para evitar que desarrolle una mentalidad cerrada.

La auditoría de algoritmos se vuelve fundamental. Las empresas necesitan examinar rigurosamente sus sistemas robóticos, detectando sesgos ocultos antes de que causen daños reales. Esto implica reunir a expertos en ética, sociólogos y especialistas en tecnología para crear directrices sólidas.

La monitorización continua es esencial; no se puede simplemente configurar y olvidarse.

Las instrucciones explícitas también son importantes. Al indicarles a los sistemas de IA que tengan en cuenta los factores demográficos, los impulsamos hacia interacciones más equitativas. Es como enseñar empatía, pero mediante código.

Imperativos éticos en el desarrollo de la IA

Mitigar los sesgos robóticos no es solo un desafío técnico, sino un imperativo moral que exige toda nuestra atención.

Las consideraciones éticas en el desarrollo de la IA son como atravesar un campo minado de posible discriminación, donde los datos de entrenamiento sesgados pueden perpetuar silenciosamente las desigualdades sociales.

Las prioridades éticas clave incluyen:

- Auditorías rigurosas de algoritmos

- Incorporación de conjuntos de datos diversos

- Evaluación continua del modelo

- Detección de sesgo transparente

No se puede simplemente ignorar el problema y esperar que desaparezca por arte de magia. Los sistemas de IA no son neutrales; son espejos que reflejan nuestros prejuicios más arraigados.

¿Quieres crear tecnología verdaderamente equitativa? Eso implica afrontar verdades incómodas sobre la representación, desafiar los paradigmas de datos existentes y comprometerse con una transparencia radical.

El futuro de la IA no se trata solo de algoritmos sofisticados, sino de construir sistemas que respeten genuinamente la complejidad y la dignidad humanas.

La gente también pregunta sobre los robots.

¿Pueden los robots elegir intencionadamente ser racistas, o es algo accidental?

No se puede elegir intencionadamente el racismo en los robots; el sesgo surge accidentalmente a través de los datos de entrenamiento. Los algoritmos de aprendizaje automático reflejan inconscientemente los prejuicios humanos, absorbiendo estereotipos sociales sin malicia deliberada ni discriminación programada.

¿Los desarrolladores de IA programan deliberadamente algoritmos discriminatorios?

Imagina que la IA de contratación de Amazon rechazara currículums con nombres de minorías. Verás que algunos desarrolladores no crean algoritmos discriminatorios intencionadamente, pero los sesgos inconscientes en los datos de entrenamiento pueden incorporar inadvertidamente patrones de toma de decisiones prejuiciosos en los sistemas de aprendizaje automático.

¿Algunos modelos de aprendizaje automático son más propensos a los sesgos?

Descubrirás que las redes neuronales entrenadas con conjuntos de datos desequilibrados pueden perpetuar inadvertidamente los sesgos sociales. Los modelos de aprendizaje profundo con datos de entrenamiento diversos y limitados tienen más probabilidades de reflejar prejuicios sistémicos inherentes a sus fuentes de información iniciales.

¿Con qué rapidez se pueden detectar y corregir los comportamientos racistas de la IA?

Necesitarás protocolos de prueba rigurosos y conjuntos de datos diversos para identificar rápidamente los sesgos en la IA. Al monitorear continuamente los resultados de los algoritmos, revisar los datos de entrenamiento e implementar prácticas de aprendizaje automático inclusivas, podrás detectar y corregir rápidamente los comportamientos discriminatorios.

¿Es posible crear una inteligencia artificial completamente imparcial?

Te enfrentarás a una tarea titánica intentando crear una IA completamente imparcial. Dado que los programadores humanos, por naturaleza, tienen sesgos inconscientes, siempre te encontrarás con dificultades para desarrollar algoritmos de aprendizaje automático verdaderamente neutrales y totalmente libres de influencias subjetivas.

Por qué esto importa en robótica

Ya hemos visto cómo la IA puede heredar los prejuicios más atroces de la humanidad. Pero aquí está la pregunta clave: ¿permitiremos que los algoritmos perpetúen la discriminación o reescribiremos el código de nuestro futuro tecnológico? La decisión es nuestra. Exigiendo transparencia, equipos de desarrollo diversos y pruebas rigurosas de sesgo, podemos transformar la IA de un potencial opresor en una herramienta de verdadera igualdad. Nuestros hijos robóticos no tienen por qué repetir nuestros errores.

Explora las familias de robots que se ajustan a este caso de uso.

Unitree Go2

Les presentamos a Unitree Go2: un perro robot que camina, corre, salta y baila. Mapea su entorno…

Árbol unitario G1

Un robot humanoide de alta gama para demostraciones profesionales, eventos, educación e interacción avanzada. Ideal cuando se busca un robot más potente…

Explora los robots, compara los modelos y reserva el que más te convenga sin necesidad de comprarlo.

Utiliza Futurobots para moverte más rápido, mantener la flexibilidad y acceder a robots avanzados sin necesidad de comprarlos.