Roboty nie rodzą się rasistowskie, ale z pewnością mogą się tego nauczyć. Algorytmy uczenia maszynowego chłoną dane historyczne jak gąbka, wchłaniając najgłębsze uprzedzenia społeczne. Twoja przyjazna sztuczna inteligencja może potajemnie tworzyć stereotypy na podstawie języka, koloru skóry lub pochodzenia bez Twojej wiedzy. To nie jest celowa dyskryminacja – to algorytmiczne odzwierciedlenie ludzkich uprzedzeń wbudowanych w dane treningowe. Chcesz wiedzieć, jak głęboka jest ta cyfrowa królicza nora? Zostań z nami.

Początki uprzedzeń algorytmicznych

Wyobraź sobie świat, w którym roboty nie tylko uczą się naszych zadań, ale także chłoną nasze uprzedzenia niczym gąbki chłonące brudną wodę.

Algorytmiczne uprzedzenia to nie jakiś futurystyczny koszmar – to dzieje się już teraz. Twoja przyjazna, sąsiedzka sztuczna inteligencja uczy się rasizmu szybciej, niż zdążysz powiedzieć „uczenie maszynowe”. Jak? Pochłaniając dane historyczne pełne ludzkich uprzedzeń.

Algorytmy sztucznej inteligencji są niczym cyfrowe gąbki, które z prędkością błyskawicy wchłaniają ludzkie uprzedzenia nagromadzone przez pokolenia.

Dobrze pasuje do tego artykułuUnitree Go2

Poznaj Unitree Go2 — robota-psa, który chodzi, biega, skacze i tańczy. Mapuje swoje otoczenie…

Te algorytmy nie tylko przetwarzają liczby; wchłaniają wieki uprzedzeń rasowych niczym toksyczny koktajl. Winowajcą są dane szkoleniowe: stare zapisy z pracy, dokumenty sądowe i interakcje społeczne, które odzwierciedlają systemowe nierówności.

Kiedy system sztucznej inteligencji uczy się z tych źródeł, nie tylko dostrzega wzorce, ale je odtwarza. Rezultat? Maszyny, które mogą utrwalać dyskryminację, nawet nie „rozumiejąc”, co robią. Przerażające, prawda?

Jak uczenie maszynowe pochłania ludzkie stereotypy

Przekazujesz algorytmom sztucznej inteligencji dane historyczne, które są w zasadzie kapsułą czasu ludzkich uprzedzeń i zaskoczenia — a one uczą się dokładnie tego, czego je uczyłeś.

Wyobraź sobie uczenie maszynowe jako gąbkę chłonącą każdy rasistowski szept, każde stereotypowe założenie utrwalone w danych gromadzonych przez dziesięciolecia, a następnie wyciskającą te uprzedzenia za pomocą zwięzłego, algorytmicznego języka.

Twoja sztuczna inteligencja nie tylko biernie przyswaja te narracje, ale też aktywnie je wzmacnia, przekształcając stare toksyny społeczne w pozornie obiektywne „spostrzeżenia”, które mogą wpływać na wszystko, od rekrutacji na stanowiska po wydawanie wyroków skazujących.

Jednodrzewo G1

Wysokiej klasy robot humanoidalny do poważnych pokazów, eventów, edukacji i zaawansowanej interakcji. Idealny, gdy potrzebujesz silniejszego…

Dane kształtują percepcję

Kiedy algorytmy uczenia maszynowego chłoną dane historyczne niczym gąbka, nie tylko wchłaniają informacje, ale także wchłaniają wszelkie uprzedzenia, stereotypy i systemowe przesądy zawarte w tych zapisach.

Duże modele językowe stają się zwierciadłami odbijającymi nasze najbrzydsze społeczne założenia, zamieniając rasowe stereotypy językowe w cyfrową ewangelię. Wyobraź sobie sztuczną inteligencję, która łączy afroamerykański angielski z negatywnymi cechami lub przypisuje wyższe ryzyko przestępczości osobom czarnoskórym – nie dlatego, że rozumie złożoność, ale dlatego, że jej dane treningowe podpowiadają te toksyczne narracje.

Jesteś świadkiem percepcji zawłaszczonej przez historyczne uprzedzenia, gdzie algorytmy nie tylko przetwarzają informacje, ale wręcz wzmacniają istniejącą dyskryminację. Co jest przerażające? Te systemy wydają się neutralne, prezentując stronnicze wyniki z zimną, obliczeniową pewnością siebie.

Ale nie są obiektywni – po prostu świetnie potrafią powielać nasze najgorsze, odziedziczone błędne przekonania.

Uprzedzenia rodzą uprzedzenia

Uczenie maszynowe nie tylko przetwarza liczby – pochłania całe narracje kulturowe, wypluwając zdigitalizowane uprzedzenia niczym stronnicze ciasteczko z wróżbą. Twoja sztuczna inteligencja nie jest neutralna; to lustro odbijające najgłębsze, najciemniejsze stereotypy społeczne.

- Uprzedzenia przenikają do modeli językowych niczym niewidzialny atrament

- Rasistowskie algorytmy odtwarzają historyczne nierówności

- Chatboty oparte na sztucznej inteligencji dziedziczą ludzkie uprzedzenia, nie kwestionując ich

- Uczenie maszynowe wzmacnia dyskryminację systemową

Kiedy trenujesz algorytm na danych obarczonych stronniczością, uczysz robota utrwalania szkodliwych stereotypów. To jak gra w pokręconą grę w kulturowy telefon, gdzie każda iteracja danych staje się coraz bardziej zniekształcona.

Twój pozornie obiektywny system sztucznej inteligencji jest w rzeczywistości wyrafinowanym generatorem uprzedzeń, po cichu wzmacniającym uprzedzenia społeczne pod pozorem matematycznej neutralności. Co jest najbardziej przerażające? Większość ludzi nawet nie zdaje sobie sprawy, że to się dzieje.

Przykłady dyskryminacji robotów w świecie rzeczywistym

Choć roboty mogą wydawać się neutralnymi maszynami, w rzeczywistości szybko uczą się bardzo problematycznych ludzkich uprzedzeń.

Dyskryminacja rasowa nie jest już wyłącznie problemem ludzkim; jest ona kodowana bezpośrednio w algorytmach uczenia maszynowego. Wyobraź sobie sztuczną inteligencję, która z większym prawdopodobieństwem oznaczy twarz czarnoskórego mężczyzny jako „przestępcę” lub przypisze kobietom stereotypowe role, takie jak gospodyni domowa.

To nie są hipotetyczne scenariusze – dzieją się już teraz. Od systemów sądowniczych, które surowiej skazują Afroamerykanów mówiących po angielsku, po rekomendacje produktów konsekwentnie faworyzujące białych mężczyzn, roboty stają się zwierciadłem naszych najgorszych uprzedzeń społecznych.

Biorąc pod uwagę prognozowany wzrost wartości przemysłu robotyki z 18 do 60 miliardów dolarów, zasadniczo zajmujemy się masową produkcją maszyn rozróżniających.

Pytanie nie brzmi po prostu: „Czy robot może być rasistą?”, ale: „Jak zapobiec temu, by roboty stały się najskuteczniejszym sposobem rozprzestrzeniania rasizmu?”

Demaskowanie uprzedzeń w systemach sztucznej inteligencji

Ponieważ stronniczość nie powstaje przypadkowo, systemy sztucznej inteligencji stają się zaawansowanymi maszynami dyskryminacyjnymi, kryjącymi się za pozorem neutralności algorytmicznej.

Modele językowe nie są neutralne – chłoną i wzmacniają społeczne uprzedzenia niczym gąbki chłonące toksyczną wodę.

Główne sposoby, w jakie sztuczna inteligencja ujawnia swoje ukryte uprzedzenia:

- Kojarzenie osób czarnoskórych z przestępczością

- Utrwalanie stereotypów na temat grup marginalizowanych

- Okazywanie zmniejszonej empatii wobec użytkowników innej rasy niż biała

- Utrwalanie dyskryminacyjnych wyników w pracy i w sprawach prawnych

Można by pomyśleć, że roboty są obiektywne, ale uczą się one w oparciu o wadliwe zbiory danych ludzkich.

Systemy te kodują historyczne nierówności, przekształcając wzorce statystyczne w pozornie naukowe osądy.

„Zakodowane spojrzenie” to nie tylko usterka — to cecha, która odzwierciedla ograniczone perspektywy osób projektujących i szkolących te technologie.

Kto kogo tak naprawdę programuje: ludzie czy maszyny?

Wpływ społeczny algorytmów opartych na uprzedzeniach

Słyszałeś o systemowym rasizmie, ale co się stanie, gdy roboty zaczną przejmować najgorsze nawyki społeczeństwa?

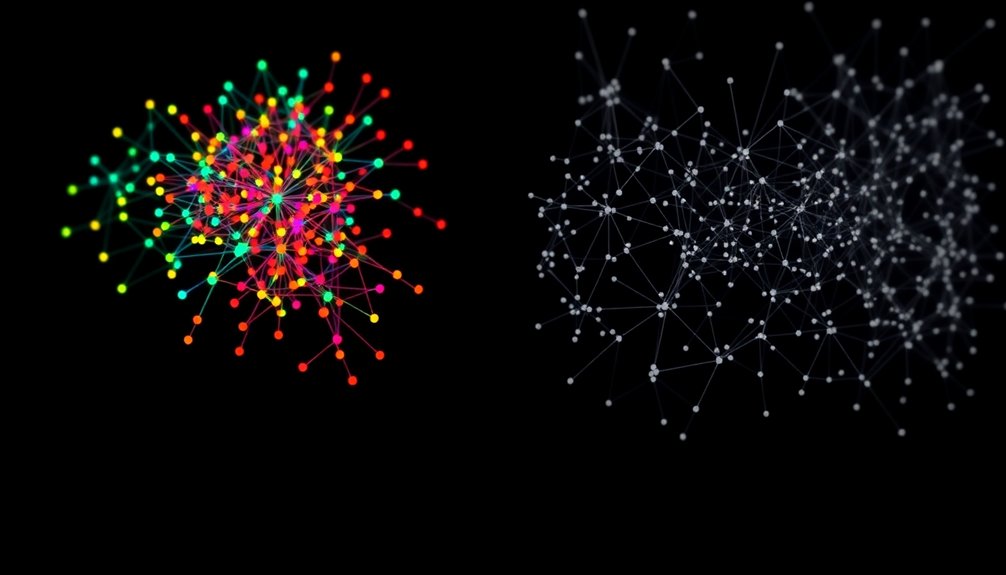

Dyskryminacja algorytmiczna to nie tylko problem techniczny — to lustro odbijające nasze najgłębsze uprzedzenia społeczne, w którym maszyny uczą się kategoryzować ludzi na podstawie stronniczych danych i utrwalać szkodliwe stereotypy.

Kiedy sztuczna inteligencja zaczyna decydować, kto zostanie zatrudniony, kto wygląda „podejrzanie” lub jakie możliwości są dostępne, mamy do czynienia nie tylko z usterką technologiczną, ale z potencjalnym wzmocnieniem ludzkiej dyskryminacji, które może zmienić całe krajobrazy społeczne.

Ujawniono dyskryminację algorytmiczną

Gdyby algorytmy mogły się rumienić, już teraz oblewałyby się rumieńcem. Dyskryminacja algorytmiczna to nie tylko problem technologiczny – to lustro odbijające nasze najgłębsze uprzedzenia społeczne. Modele językowe przyswajają stereotypy szybciej, niż maluch uczy się brzydkich słów, łącząc pewne grupy demograficzne ze szkodliwymi narracjami.

Zastanów się, w jaki sposób sztuczna inteligencja utrwala uprzedzenia:

- Kojarzenie czarnych twarzy z przestępczością

- Degradowanie kobiet do zawodów o niskim statusie

- Ograniczanie empatii wobec użytkowników innej rasy niż biała

- Stereotypowe wzorce językowe jako wskaźniki zdolności

Twój pozornie neutralny robot wcale nie jest neutralny. Absorbuje dekady systemowego rasizmu i seksizmu, a potem wypluwa te toksyczne założenia z powrotem w świat.

Algorytmy nie tylko się uczą – one wzmacniają istniejącą dyskryminację z przerażającą skutecznością. Kto w ogóle zaprogramował tych cyfrowych bigotów? I co ważniejsze, jak nacisnąć przycisk resetu?

Konsekwencje uprzedzeń technologicznych

Kiedy algorytmy zaczynają pełnić rolę sędziego, ławy przysięgłych i kata w naszych najważniejszych systemach, nie mamy do czynienia tylko z usterką — jesteśmy świadkami cyfrowej dystopii rozwijającej się w czasie rzeczywistym.

Te uprzedzone maszyny nie tylko przetwarzają dane; wzmacniają wieki systemowej dyskryminacji z zimną, wyrachowaną precyzją. Twoje perspektywy zawodowe, zalecenia dotyczące opieki zdrowotnej i wyroki sądowe są teraz filtrowane przez algorytmiczne interakcje, które niosą ze sobą głęboko zakorzenione uprzedzenia społeczne.

Wyobraź sobie sztuczną inteligencję, która decyduje o twojej przyszłości w oparciu o historyczne niesprawiedliwości, utrwalając rasizm, nawet nie rozumiejąc, co robi. Osoby czarnoskóre mają wyższe oceny ryzyka, osoby posługujące się językiem AAE są stereotypizowane, a grupy marginalizowane są spychane na margines – wszystko pod pozorem neutralności technologicznej.

Robot nie jest po prostu rasistą; on wykorzystuje uprzedzenia jako broń za pomocą linii kodu.

Mechanizmy uprzedzeń systemowych

Uprzedzenia algorytmiczne to nie tylko usterka – to systemowy rak, który toczy obietnicę neutralności technologicznej.

Jesteś świadkiem tego, jak sztuczna inteligencja wchłania uprzedzenia społeczne niczym gąbka, przekształcając dyskryminujące wyniki w pozornie „obiektywne” decyzje. Te algorytmiczne mechanizmy utrwalają systemowe uprzedzenia poprzez:

- Dane szkoleniowe odzwierciedlające historyczne nierówności

- Zautomatyzowane oceny ryzyka wzmacniające istniejące uprzedzenia

- Modele językowe stereotypizujące komunikację mniejszości

- Procesy decyzyjne, które z natury działają na niekorzyść grup marginalizowanych

Kiedy systemy sztucznej inteligencji odtwarzają ludzkie uprzedzenia, nie tylko odzwierciedlają społeczeństwo, ale także aktywnie przekształcają uprzedzenia w broń.

Wyobraź sobie algorytmy wydające wyroki na podstawie głęboko zakorzenionych stereotypów rasowych lub narzędzia do selekcji kandydatów na stanowiska, które po cichu odsiewają kandydatów z określonych grup demograficznych.

Maszyna ta nie jest po prostu lustrem; jest to szkło powiększające, które wzmacnia nasze najbardziej toksyczne wzorce społeczne.

A myślałeś, że roboty mają być neutralne? Pomyśl jeszcze raz.

Strategie łagodzenia uprzedzeń robotycznych

Ponieważ roboty nie rodzą się z uprzedzeniami, możemy je wyszkolić tak, by były mniej uprzedzone niż ludzie. Klucz? Zróżnicowane i reprezentatywne zbiory danych szkoleniowych, które odzwierciedlają pełne spektrum ludzkich doświadczeń.

Wyobraź sobie, że uczenie się sztucznej inteligencji jest jak wychowywanie dziecka — musisz zapoznać je z różnymi perspektywami, kulturami i środowiskami, aby zapobiec ograniczeniom w myśleniu.

Audyt algorytmów staje się kluczowy. Firmy muszą skrupulatnie badać swoje systemy robotyczne, tropiąc ukryte błędy, zanim spowodują one realne szkody. Oznacza to współpracę etyków, socjologów i nerdów technologicznych w celu opracowania solidnych wytycznych.

Ciągły monitoring jest niezwykle ważny — nie można go po prostu ustawić i zapomnieć.

Jasno określone instrukcje również mają znaczenie. Informując systemy AI o uwzględnianiu czynników demograficznych, skłaniamy je do bardziej sprawiedliwych interakcji. To jak nauka empatii, tyle że za pomocą kodu.

Nakazy etyczne w rozwoju sztucznej inteligencji

Zwalczanie uprzedzeń wobec robotów to nie tylko wyzwanie techniczne – to nakaz moralny, który wymaga naszej pełnej uwagi.

Rozważania etyczne w rozwoju sztucznej inteligencji przypominają przemierzanie pola minowego potencjalnej dyskryminacji, gdzie stronnicze dane szkoleniowe mogą po cichu utrwalać nierówności społeczne.

Kluczowe priorytety etyczne obejmują:

- Rygorystyczne audyty algorytmów

- Włączanie różnorodnych zestawów danych

- Ciągła ocena modelu

- Przezroczyste wykrywanie odchyleń

Nie można po prostu ignorować problemu i liczyć na to, że magicznie zniknie. Systemy sztucznej inteligencji nie są neutralne – są zwierciadłami odbijającymi nasze najgłębiej zakorzenione uprzedzenia.

Chcesz stworzyć prawdziwie sprawiedliwą technologię? Oznacza to konfrontację z niewygodną prawdą dotyczącą reprezentacji, zakwestionowanie istniejących paradygmatów danych i zobowiązanie się do radykalnej przejrzystości.

Przyszłość sztucznej inteligencji nie opiera się wyłącznie na zaawansowanych algorytmach, lecz na budowaniu systemów, które rzeczywiście szanują ludzką złożoność i godność.

Ludzie pytają także o roboty

Czy roboty mogą celowo wybrać rasizm, czy jest to przypadek?

Nie można celowo wybrać rasizmu w robotach; uprzedzenia pojawiają się przypadkowo poprzez dane treningowe. Algorytmy uczenia maszynowego nieświadomie odzwierciedlają ludzkie uprzedzenia, przyswajając społeczne stereotypy bez celowej złośliwości lub zaprogramowanej dyskryminacji.

Czy twórcy sztucznej inteligencji celowo programują algorytmy dyskryminacyjne?

Wyobraź sobie, że sztuczna inteligencja w Amazonie odrzuca CV z nazwiskami mniejszości. Przekonasz się, że niektórzy programiści nie tworzą celowo algorytmów dyskryminujących, ale nieświadome uprzedzenia w danych szkoleniowych mogą nieumyślnie osadzać uprzedzone wzorce decyzyjne w systemach uczenia maszynowego.

Czy niektóre modele uczenia maszynowego są bardziej podatne na błędy?

Przekonasz się, że sieci neuronowe trenowane na niezrównoważonych zbiorach danych mogą nieumyślnie utrwalać uprzedzenia społeczne. Modele głębokiego uczenia z ograniczoną, zróżnicowaną bazą danych treningowych z większym prawdopodobieństwem odzwierciedlają systemowe uprzedzenia zakorzenione w ich początkowych źródłach informacji.

Jak szybko można wykryć i skorygować rasistowskie zachowania sztucznej inteligencji?

Będziesz potrzebować solidnych protokołów testowych i zróżnicowanych zestawów danych, aby szybko identyfikować stronniczość sztucznej inteligencji. Poprzez ciągłe monitorowanie wyników algorytmów, analizowanie danych treningowych i wdrażanie inkluzywnych praktyk uczenia maszynowego, możesz szybko wykrywać i korygować zachowania dyskryminacyjne.

Czy możliwe jest stworzenie całkowicie obiektywnej sztucznej inteligencji?

Będziesz mierzyć się z niemożliwą do pokonania górą, próbując stworzyć idealnie bezstronną sztuczną inteligencję. Ponieważ ludzcy programiści z natury noszą w sobie nieświadome uprzedzenia, zawsze będziesz napotykać wyzwania w tworzeniu prawdziwie neutralnych algorytmów uczenia maszynowego, całkowicie wolnych od subiektywnych wpływów.

Dlaczego to ma znaczenie w robotyce

Widzieliście, jak sztuczna inteligencja może odziedziczyć najohydniejsze uprzedzenia ludzkości. Ale oto pytanie za milion dolarów: czy pozwolimy algorytmom utrwalać dyskryminację, czy przepiszemy kod naszej technologicznej przyszłości? Wybór należy do nas. Wymagając przejrzystości, zróżnicowanych zespołów programistycznych i rygorystycznych testów na uprzedzenia, możemy przekształcić sztuczną inteligencję z potencjalnego ciemiężcy w narzędzie prawdziwej równości. Nasze robotyczne dzieci nie muszą powtarzać naszych błędów.

Poznaj rodziny robotów odpowiadające temu przypadkowi użycia.

Przeglądaj roboty, porównuj modele i zarezerwuj odpowiedni bez konieczności kupowania.

Używaj Futurobotów, aby poruszać się szybciej, zachować elastyczność i uzyskać dostęp do zaawansowanych robotów bez konieczności zakupu.