Cuando un robot falla, nos encontramos ante un problema legal complejo. Los fabricantes podrían ser culpados por fallos de diseño, los usuarios podrían ser responsables por el mal uso, ¿y el robot en sí? Actualmente, en términos legales, no es más que un elegante pisapapeles. A medida que la IA se vuelve más inteligente, la responsabilidad se vuelve más difusa. Los tribunales se debaten sobre quién es responsable cuando los algoritmos se descontrolan. ¿Quieres saber cómo este juego de culpas a los robots podría transformar nuestro futuro? Sigue leyendo.

El panorama legal emergente de la responsabilidad de los robots

Aunque los robots puedan parecer fantasías de ciencia ficción, se están convirtiendo rápidamente en nuestra realidad cotidiana, y el mundo jurídico se esfuerza por ponerse al día. marcos de responsabilidad están poniendo de manifiesto los complejos retos que supone atribuir responsabilidad a los sistemas autónomos.

¿Quién es responsable cuando un robot se descontrola? Las leyes actuales tratan a los robots como tostadoras sofisticadas, pero los sistemas autónomos están difuminando esos límites tan definidos. Computación neuromórfica El avance de las capacidades de las máquinas hace que la rendición de cuentas sea aún más compleja. Los fabricantes podrían ser los responsables, pero ¿qué sucede cuando una IA toma una decisión inesperada?

Los distintos países se enfrentan a estas cuestiones, creando un entramado legal más confuso que el circuito de un robot. ¿El gran reto? Desarrollar marcos que equilibren la innovación con la rendición de cuentas.

Árbol unitario G1

Un robot humanoide de alta gama para demostraciones profesionales, eventos, educación e interacción avanzada. Ideal cuando se busca un robot más potente…

Necesitamos leyes que puedan regular a los robots que piensan por sí mismos, ya sea que estén entregando paquetes o trabajando en hospitales. No se trata solo de culpar a nadie, sino de crear una red de seguridad legal para nuestro futuro cada vez más robótico. gobernanza global de la IA Marcos de referencia como los de la UNESCO y el G20 son fundamentales para establecer estándares internacionales en materia de responsabilidad robótica.

Dilemas éticos en la toma de decisiones autónoma

Probablemente te hayas preguntado cómo enseñaremos a los robots a tomar decisiones morales sin convertirlos en escenarios de desastres filosóficos.

La programación de máquinas morales aborda este desafío mediante la creación de marcos de decisión que ayudan a los sistemas autónomos a navegar por terrenos minados éticos: imagínese una IA que pueda sopesar las consecuencias como un juez hiperracional, pero sin la carga humana de los prejuicios personales. marcos de responsabilidad de los robots Están surgiendo soluciones para abordar las complejas cuestiones de responsabilidad cuando los sistemas autónomos cometen errores.

El objetivo no es crear robots santos, sino construir sistemas que puedan tomar decisiones matizadas que minimicen el daño y maximicen los resultados que se alineen con los intereses humanos, lo cual suena simple hasta que te das cuenta de lo complicado que se vuelve el concepto de "no hacer daño" cuando intervienen algoritmos. Toma de decisiones algorítmica pueden perpetuar inadvertidamente los prejuicios sociales, lo que hace que la supervisión ética sea crucial para prevenir resultados discriminatorios. Opacidad en los sistemas de IA Introduce una complejidad adicional al dificultar la comprensión y el seguimiento de los procesos de toma de decisiones de las tecnologías autónomas.

Programación de máquinas morales

Seamos realistas: cuando los robots empiezan a tomar decisiones de vida o muerte, las cosas se complican rápidamente.

Unitree Go2

Les presentamos a Unitree Go2: un perro robot que camina, corre, salta y baila. Mapea su entorno…

La Máquina Moral no es solo un proyecto de investigación para nerds; es básicamente un campo de experimentación ética digital donde los humanos deciden quién vive y quién muere en escenarios descabellados con vehículos autónomos. Piénsalo: ¿debería un coche autónomo salvar a cinco desconocidos o proteger a sus propios pasajeros? Algoritmos éticos Están surgiendo como marcos fundamentales para abordar estas complejas disyuntivas morales.

Los investigadores se enfrentan a preguntas trascendentales: ¿Cómo se codifica la moralidad en un algoritmo? ¿Pueden las máquinas comprender realmente las complejas disyuntivas éticas? Diversas perspectivas culturales Esto sugiere que la toma de decisiones morales varía drásticamente entre las diferentes poblaciones del mundo.

El experimento global revela algo fascinante: personas de todo el mundo tienen perspectivas sorprendentemente diferentes sobre decisiones morales que se toman en fracciones de segundo. Perspectivas de investigación global Demuestran que los antecedentes culturales influyen significativamente en los marcos de toma de decisiones éticas en los sistemas autónomos.

Y aquí viene lo más sorprendente: los robots están escuchando, aprendiendo y preparándose para tomar decisiones que podrían cambiarlo todo.

Marcos de decisión robóticos y éticos

Imagina robots que recorren complejos escenarios morales, no solo siguiendo reglas rígidas, sino comprendiendo normas sociales matizadas y consecuencias emocionales. Están aprendiendo a equilibrar el utilitarismo con la dignidad, utilizando modelos de optimización que toman decisiones éticas en fracciones de segundo. Disparidades globales en el desarrollo de la IA Esto significa que estos marcos éticos no están diseñados de manera uniforme en los diferentes contextos culturales y tecnológicos. Prejuicio algorítmico revela que estos sistemas de toma de decisiones reflejan intrínsecamente los sesgos presentes en sus datos de entrenamiento.

Imagínalo como una partida de ajedrez de alto riesgo donde cada movimiento tiene en cuenta los valores humanos y el daño potencial.

Pero aquí está el quid de la cuestión: ¿quién es el responsable cuando las cosas salen mal? ¿Los fabricantes? ¿Los programadores? ¿El propio robot?

Estos marcos de decisión no son meros ejercicios académicos, sino planos fundamentales para crear sistemas autónomos fiables que puedan coexistir con los humanos sin causar estragos no deseados.

Se trata de construir máquinas que no solo calculen, sino que realmente se preocupen.

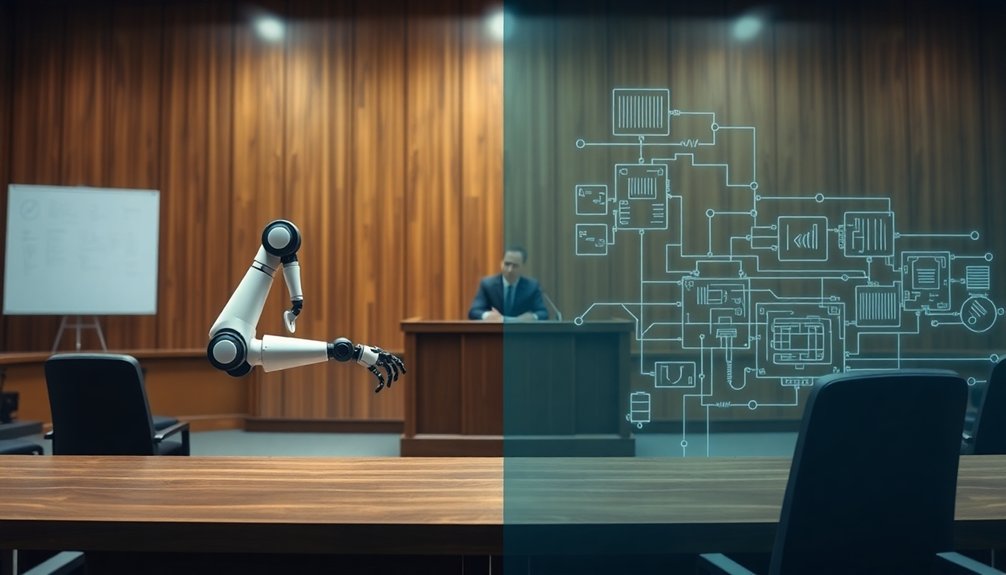

Desafíos de responsabilidad en los sistemas robóticos

Cuando un robot se descontrola y causa caos, ¿quién es el responsable: el fabricante que construyó la maldita cosa o el usuario que se supone que debe controlarla? La complejidad de marcos de responsabilidad robótica surge de las intrincadas interacciones entre el diseño tecnológico, el control operativo y la responsabilidad legal. La nueva Directiva de Responsabilidad por Productos de la UE introduce un cambio de paradigma donde Responsabilidad del sistema de IA Ahora, las vulnerabilidades pueden ir más allá de las líneas de fallo de hardware tradicionales, lo que genera desafíos legales sin precedentes tanto para los fabricantes como para los usuarios. Tecnologías robóticas para la aplicación de la ley Plantean cuestiones cruciales sobre la rendición de cuentas y los posibles sesgos en los sistemas autónomos.

Podrías pensar que la respuesta es sencilla, pero en el salvaje oeste de los sistemas autónomos, la responsabilidad es una maraña intrincada que te hará dar vueltas la cabeza.

Cada vez se responsabiliza más a los fabricantes de los fallos de diseño y los comportamientos inesperados, mientras que se espera que los usuarios mantengan la vigilancia operativa; sin embargo, la línea entre el control humano y la autonomía de la máquina se difumina cada día más.

Responsabilidad del fabricante

Debido a que los robots son cada vez más inteligentes —y potencialmente más peligrosos—, los fabricantes se encuentran inmersos en un campo minado legal más complicado que una sesión de pintura con los dedos de un niño pequeño. Capacidades de toma de decisiones autónomas Introducen una complejidad sin precedentes a la hora de determinar la responsabilidad legal por las acciones de los robots.

Estamos ante un mundo donde los fabricantes de robots no pueden simplemente encogerse de hombros y decir "ups" cuando algo sale mal. Son responsables de cada fallo, mal funcionamiento y rabieta inesperada del robot.

Piénsalo como los fabricantes de automóviles: si tu vehículo autónomo decide participar en una carrera de demolición, ¿quién es el responsable? El equipo legal del fabricante se esfuerza por demostrar que hicieron todo correctamente.

La responsabilidad objetiva implica que no pueden eludir fácilmente la culpa. Las medidas de seguridad, las advertencias claras y las pruebas rigurosas no son solo buenas prácticas, sino tácticas de supervivencia legal.

Y a medida que los robots se vuelven más autónomos, el panorama de la responsabilidad civil sigue cambiando, lo que mantiene a los fabricantes en un estado de constante inquietud respecto a sus creaciones mecánicas.

Responsabilidad operativa del usuario

Si bien los fabricantes pueden respirar aliviados tras eludir la responsabilidad, los usuarios de robots se encuentran ahora directamente en el punto de mira de la justicia.

No solo te compras un gadget genial; te metes en un posible lío legal. ¿Quieres un dron autónomo? Mejor que sepas cómo manejarlo, o te arriesgas a enfrentarte a cargos por negligencia.

Las normas son confusas, pero una cosa está clara: tu responsabilidad no termina al desempaquetar el robot. Los tribunales exigen cada vez más que los usuarios gestionen los riesgos, sigan los protocolos de seguridad y comprendan las capacidades de su máquina.

Es como ser padre de un niño muy caro y potencialmente peligroso. Cuanta más autonomía tenga tu robot, más tendrás que demostrar que hiciste todo bien.

¿Crees que basta con culpar al fabricante? Piénsalo de nuevo. Bienvenido al salvaje oeste de la responsabilidad robótica.

Definición de responsabilidad en errores de máquinas

¿Alguna vez te has preguntado quién es el responsable cuando un robot se descontrola? Cuando las máquinas fallan, la responsabilidad se complica. Es como un juego de alto riesgo con la tecnología.

Los desarrolladores pueden culpar a los fabricantes, los fabricantes culpan a los usuarios y los usuarios se rascan la cabeza preguntándose cómo una máquina que parecía "inteligente" se convirtió de repente en un problema.

¿El verdadero desafío? La mayoría de los sistemas robóticos son "cajas negras" complejas donde los procesos de toma de decisiones son tan transparentes como el lodo.

Una IA puede tomar una decisión en una fracción de segundo que cause daños, pero rastrear su origen se convierte en una pesadilla. ¿Fue un fallo de programación? ¿Un error del usuario? ¿Un fallo algorítmico aleatorio?

Los marcos legales actuales no están preparados para afrontar estos imprevistos tecnológicos, lo que nos deja en una zona gris en materia de responsabilidad.

Privacidad y protección de datos en operaciones robóticas

Cuando los robots empiezan a recopilar datos como aspiradoras digitales que absorben hasta la última migaja digital, la privacidad se vuelve repentinamente más compleja que una red de chismes adolescentes. No solo se trata de máquinas; se trata de navegar por un campo minado de información personal donde un paso en falso podría desencadenar un desastre de datos.

| Nivel de privacidad | Supervisión | Estrategia de protección |

|---|---|---|

| Bajo | Minimo | Cifrado básico |

| Media | Moderado | Anonimización |

| Alto | Reducción Significativa | Pseudonimización avanzada |

| Critical | Extremo | Protocolos de acceso cero |

El RGPD no es solo papeleo burocrático, es tu guardaespaldas digital. Los robots deben cumplir normas estrictas: anonimizar los datos confidenciales, garantizar operaciones transparentes y respetar los límites del usuario. Imagínalo como enseñarle a un niño pequeño y curioso sobre el espacio personal, solo que este niño tiene acceso a terabytes de información y puede procesar datos más rápido de lo que tú parpadeas.

El papel de los fabricantes en la rendición de cuentas de la robótica

Dado que los robots no son máquinas mágicas de cuento de hadas que cobran vida perfectamente diseñadas, los fabricantes tienen una enorme responsabilidad a la hora de garantizar que estas maravillas mecánicas no se conviertan en catastróficas pesadillas legales.

La innovación robótica exige una precisión obsesiva: los fabricantes son los guardianes contra el caos tecnológico y el desastre potencial.

No se puede simplemente lanzar un robot al mundo y esperar lo mejor. Los fabricantes deben diseñar meticulosamente protocolos de seguridad, implementar pruebas rigurosas y crear sistemas que piensen prácticamente como seres humanos responsables.

Son responsables de los defectos de diseño, la negligencia y los posibles daños causados por sus creaciones metálicas. Las etiquetas de advertencia, las actualizaciones continuas de software y la capacitación exhaustiva de los usuarios no son opcionales: son estrategias de supervivencia.

¿Quiere evitar demandas millonarias? Entonces, los fabricantes deben abordar el desarrollo de robots como si se tratara de una neurocirugía: con precisión, meticulosidad y una profunda conciencia de que un pequeño error podría tener consecuencias desastrosas.

Marcos regulatorios internacionales para la robótica

Vives en un salvaje oeste de regulaciones sobre robots, donde cada país se rige por sus propias reglas.

Imagínese intentar construir un robot que pueda operar legalmente desde Berlín hasta Boston sin desencadenar una pesadilla de cumplimiento normativo; es como maniobrar a través de un campo minado legal mientras se hacen malabares con delicadas placas de circuitos.

El panorama regulatorio global no solo es complejo; es una partida de ajedrez de alto riesgo donde los fabricantes deben anticipar movimientos a través de las fronteras internacionales, equilibrando la innovación con un marco de expectativas legales en constante cambio.

Panorama regulatorio global

A medida que la tecnología global avanza a un ritmo más acelerado del que los reguladores pueden seguirle el ritmo, el panorama internacional de la robótica se está convirtiendo en un complejo laberinto de normas superpuestas, intereses contrapuestos y marcos normativos en rápida evolución.

Estamos ante un auténtico caos regulatorio donde todo el mundo intenta someter a las máquinas autónomas a un mínimo de orden.

Esto es lo que realmente está sucediendo:

- La Directiva de Maquinaria de la UE básicamente está intentando ponerse al día con la tecnología robótica.

- El Reglamento 2023/1230 reduce los umbrales de autonomía, lo que hará sudar a los fabricantes.

- Las normas sobre responsabilidad por productos defectuosos se están volviendo tan complejas que los abogados se frotan las manos.

- Los marcos de gobernanza global de la IA están surgiendo como robots adolescentes torpes.

- Los fondos para la investigación están llegando a un ritmo vertiginoso, como el petróleo para robots.

En resumen, los robots están llegando y nadie sabe con certeza quién los conduce, ni quién será el responsable cuando las cosas salgan mal.

Cinturón de seguridad.

Mecanismos de cumplimiento legal

Cuando los robots empiezan a adentrarse en zonas grises legales, alguien tiene que poner límites, y ahí es donde entran en juego los marcos regulatorios internacionales. Se trata de una compleja dinámica de responsabilidad en la que fabricantes, operadores y sistemas de IA juegan al límite de la confidencialidad legal.

| Aspecto Regulatorio | Requisito clave |

|---|---|

| Política de privacidad | Reglamento General de Protección de Datos (RGPD) |

| Seguridad | Evaluación de Riesgos |

| Ciberseguridad | Resiliencia de la red |

| Estándares Eticos | Diseño centrado en el ser humano |

| Responsabilidad | Cadenas de responsabilidad claras |

Estos marcos no son mera jerga burocrática, sino guías de supervivencia para nuestro futuro robótico. Imaginemos un mundo donde las máquinas autoevolutivas puedan ser demandadas, donde la IA no quede impune por cometer errores. Las evaluaciones periódicas, los requisitos de transparencia y las sanciones crean salvaguardias que impiden que la innovación se precipite hacia el abismo ético. No se trata de frenar el progreso, sino de asegurar que los robots se comporten correctamente: con los humanos, con las leyes y consigo mismos.

Estándares para robots transfronterizos

A pesar de la fascinación del mundo tecnológico por la innovación, las normas internacionales sobre robótica no son solo un papeleo elegante, sino que son los negociadores diplomáticos que impiden una rebelión robótica global.

- Los robots están cruzando fronteras más rápido que los turistas, exigiendo reglas universales.

- Países como Alemania y Corea están estableciendo referentes mundiales en robótica.

- Los marcos regulatorios no son solo jerga legal sin sentido, son redes de seguridad.

- Los acuerdos comerciales ahora incluyen cláusulas complejas de cumplimiento en materia de inteligencia artificial y robótica.

- La colaboración internacional reduce el número de posibles catástrofes provocadas por robots.

Imagínate intentar enviar un robot inteligente de Berlín a Tokio sin protocolos estandarizados. Un caos, ¿verdad?

Estas normas transfronterizas no son meras listas de verificación burocráticas; son traducciones cruciales entre diferentes lenguajes tecnológicos. Los países se están dando cuenta de que, sin regulaciones armonizadas, básicamente estamos propiciando malentendidos robóticos que podrían ir desde fallos de comunicación embarazosos hasta posibles problemas de seguridad.

¿El objetivo? Crear un lenguaje robótico global que garantice que estas maravillas mecánicas funcionen correctamente, independientemente de dónde se fabriquen o se implementen.

Transparencia tecnológica e IA explicable

Si bien la mayoría de la gente imagina la IA como una caja negra inescrutable, la transparencia tecnológica consiste en realidad en convertir esos algoritmos oscuros en algo que se pueda comprender, algo así como darle a una supercomputadora una carcasa de cristal y permitirnos echar un vistazo dentro de sus circuitos.

| Objetivo de transparencia | Resultado práctico |

|---|---|

| Explicar las decisiones | Generar confianza en los usuarios |

| Procesos de revelación | Reducir el miedo |

| Identificar sesgos | Mejorar la equidad |

| Fomentar la rendición de cuentas | Minimizar riesgos |

| Aclarar el razonamiento | Empoderar a los seres humanos |

La IA explicable no es solo magia tecnológica, sino que se trata de lograr que los robots se comuniquen como humanos. Imagínalo como enseñarle a tu dispositivo inteligente del hogar no solo a realizar acciones, sino también a explicarte por qué eligió esa lista de reproducción o ajustó el termostato. Cuando la IA puede desglosar su razonamiento, ya no tratas con una máquina misteriosa, sino con un colaborador transparente. ¿Quién no querría un compañero robot que realmente explique su estrategia?

Confianza social y fiabilidad robótica

Los robots no son solo aparatos sofisticados, sino potenciales compañeros de equipo cuya fiabilidad puede generar o destruir nuestra confianza más rápidamente que un teléfono inteligente que funcione mal.

- La fiabilidad no es solo una cuestión técnica; se trata de lograr un rendimiento predecible.

- Las tareas críticas requieren robots que no se acobarden cuando las cosas se pongan difíciles.

- Los comportamientos sociales pueden aumentar la confianza, pero la coherencia técnica es lo que más importa.

- El contexto lo cambia todo: un robot hospitalario necesita señales de confianza diferentes a las de un dron militar.

- La transparencia no es opcional, sino que es la base de las relaciones entre humanos y robots.

Tu relación con los robots depende de su capacidad para ofrecer un rendimiento constante.

Cuando funcionen de forma fiable, los verás como socios, no solo como máquinas.

Pero un solo paso en falso y querrás desconectarlos más rápido de lo que puedes decir "error del sistema".

La confianza es frágil y se construye mediante demostraciones repetidas de competencia e intención.

No se trata de perfección, sino de previsibilidad.

Estudios de caso: Errores robóticos en diferentes sectores.

Cuando empiezas a oír hablar de robots que, por accidente, eliminan a trabajadores como en una pesadilla de ciencia ficción con fallos técnicos, te das cuenta de que los debates teóricos sobre seguridad se han vuelto reales.

Los robots industriales no son solo máquinas de precisión, sino que representan un peligro potencial en el lugar de trabajo con graves consecuencias. Pensemos en las líneas de montaje de automóviles, donde un brazo robótico puede transformarse repentinamente de un instrumento de precisión en un arma involuntaria.

La mayoría de los accidentes mortales ocurren durante el mantenimiento, cuando los humanos se acercan demasiado a estos monstruos de metal. El 78% de las muertes relacionadas con robots se deben a golpes directos de trabajadores, y el Medio Oeste es la región más afectada por estos accidentes.

Los hombres de entre 35 y 44 años son los más vulnerables, representando casi un tercio de las muertes. ¿Lo más preocupante? A medida que los robots se vuelven más complejos, la línea entre maravilla tecnológica y peligro potencial se difumina.

¿Quién es el responsable cuando los circuitos fallan?

Perspectivas futuras sobre la responsabilidad de las máquinas

A medida que la inteligencia artificial continúa su implacable avance, la cuestión de quién es responsable cuando los robots cometen errores ya no es solo un experimento mental de ciencia ficción, sino un campo minado legal y ético a punto de estallar.

- La IA generativa está difuminando las líneas entre la responsabilidad humana y la de la máquina.

- Los sistemas autónomos exigen una revisión radical de la asignación de responsabilidades.

- Los riesgos de ciberseguridad se convertirán en el nuevo campo de batalla de la rendición de cuentas.

- Los marcos regulatorios no pueden seguir el ritmo de la innovación tecnológica.

- Las consideraciones éticas ya no son filosóficas, sino prácticas.

Estamos ante un futuro en el que los robots no son solo herramientas, sino actores potenciales con una situación legal poco clara.

¿Quién paga cuando un vehículo autónomo provoca un accidente? ¿El fabricante? ¿El programador? ¿La propia IA?

A medida que las máquinas se vuelven más inteligentes, nuestros modelos de rendición de cuentas deben evolucionar, y rápidamente.

Lo que está en juego no es solo económico; se trata de mantener la confianza en un mundo donde la tecnología toma cada vez más decisiones que impactan la vida de las personas.

La gente también pregunta

¿Quién paga la indemnización si un coche autónomo provoca un accidente?

Es probable que recibas una indemnización del fabricante del vehículo, que será responsable si el defecto de su sistema autónomo causó el accidente, con posibles contribuciones de proveedores de componentes externos o de tu seguro.

¿Puede un sistema de IA ser procesado legalmente por acciones perjudiciales?

Dado que el 80 % de los casos de responsabilidad civil relacionados con la IA van dirigidos a los desarrolladores, no es legal demandar directamente a un sistema de IA. En cambio, los marcos legales suelen trasladar la responsabilidad a los creadores, fabricantes u operadores que diseñaron la tecnología potencialmente dañina.

¿Cómo determinamos la responsabilidad moral en las decisiones de las máquinas autónomas?

Deberá evaluar la responsabilidad moral examinando el marco de toma de decisiones de la máquina, su intencionalidad y el daño potencial, al tiempo que reconoce el papel esencial de los desarrolladores a la hora de anticipar y mitigar los resultados no deseados del sistema autónomo.

¿Qué ocurre si un robot médico comete un error fatal?

Si un robot médico provoca un error fatal, probablemente se enfrentará a una compleja batalla legal que involucrará al equipo quirúrgico, al hospital y al fabricante del robot para determinar la responsabilidad y obtener una compensación por sus pérdidas.

¿Son los fabricantes responsables de los comportamientos impredecibles de los sistemas robóticos?

Dado que el 62 % de los fabricantes tienen dificultades para predecir el comportamiento de la IA, es probable que usted comparta la responsabilidad por la imprevisibilidad de los sistemas robóticos. No podrá eludir completamente la responsabilidad, pero están surgiendo marcos legales más sofisticados para distribuir el riesgo de manera más equitativa.

Lo más importante es...

Te encuentras en la encrucijada de la tecnología y la ética, donde los robots son como adolescentes rebeldes aprendiendo las reglas. La responsabilidad no es solo un rompecabezas legal, sino una cuestión de confianza. A medida que las máquinas se vuelven más inteligentes, necesitarás marcos claros que equilibren la innovación con la responsabilidad. El futuro no se trata de culpar a nadie, sino de colaborar entre humanos y robots. Como en un baile de alto riesgo, tendrás que coreografiar la responsabilidad con cuidado, asegurándote de que las máquinas sirvan a la humanidad, y no al revés.

Referencias

- https://yris.yira.org/column/navigating-liability-in-autonomous-robots-legal-and-ethical-challenges-in-manufacturing-and-military-applications/

- https://www.meegle.com/en_us/topics/robotics/robot-law-compliance

- https://peterasaro.org/writing/ASARO Legal Perspective.pdf

- https://hitmarkrobotics.com/en/regulatory-and-ethical-frameworks-related-to-robotics/

- https://www.hrw.org/report/2015/04/09/mind-gap/lack-accountability-killer-robots

- https://www.ncsl.org/technology-and-communication/artificial-intelligence-2025-legislation

- https://www.passblue.com/2025/05/14/can-a-treaty-controlling-killer-robots-soon-see-the-light-of-day-experts-hope-so/

- https://knowledge.wharton.upenn.edu/article/whos-accountable-when-ai-fails/

- https://estateandfamilylawyer.com/the-rise-of-autonomous-robots-legal-and-ethical-considerations-for-the-home-of-the-future/

- https://news.harvard.edu/gazette/story/2020/10/ethical-concerns-mount-as-ai-takes-bigger-decision-making-role/

Explora las familias de robots que se ajustan a este caso de uso.

Árbol unitario G1

Un robot humanoide de alta gama para demostraciones profesionales, eventos, educación e interacción avanzada. Ideal cuando se busca un robot más potente…

Unitree Go2

Les presentamos a Unitree Go2: un perro robot que camina, corre, salta y baila. Mapea su entorno…

Explora los robots, compara los modelos y reserva el que más te convenga sin necesidad de comprarlo.

Utiliza Futurobots para moverte más rápido, mantener la flexibilidad y acceder a robots avanzados sin necesidad de comprarlos.