Robotervision verwandelt Maschinen in sehende Wesen, die die Welt wie hochintelligente Kameras interpretieren. Sie erfahren, wie Kameras, Sensoren und hochentwickelte Algorithmen Robotern das „Sehen“ ermöglichen, indem sie visuelle Daten in verwertbare Informationen umwandeln. Stellen Sie sich vor, Robotern Augen zu geben, die jedes Pixel analysieren, Objekte erkennen und sich in Millisekunden in komplexen Umgebungen zurechtfinden können. Möchten Sie einen Blick hinter die Kulissen werfen und erfahren, wie Maschinen das Sehen lernen? Dann bleiben Sie dran.

Wie Robotervision funktioniert

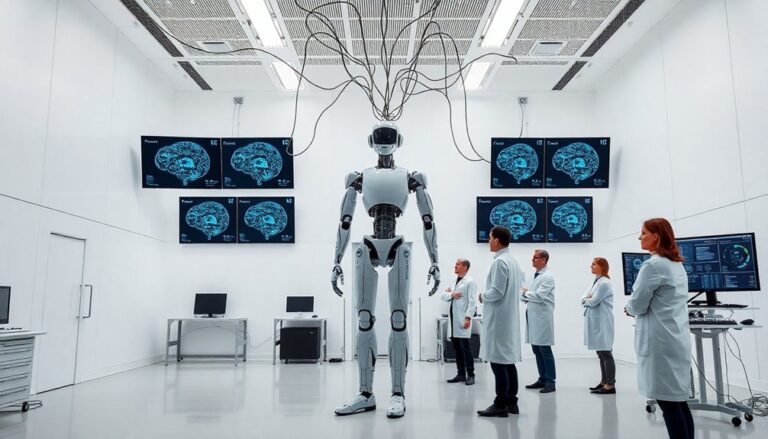

Auch wenn Roboter wie etwas direkt aus einem Science-Fiction-Film wirken mögen, ist ihre Fähigkeit zu „sehen“ in Wirklichkeit ein atemberaubendes technologisches Zusammenspiel von Sensoren, Algorithmen und roher Rechenleistung.

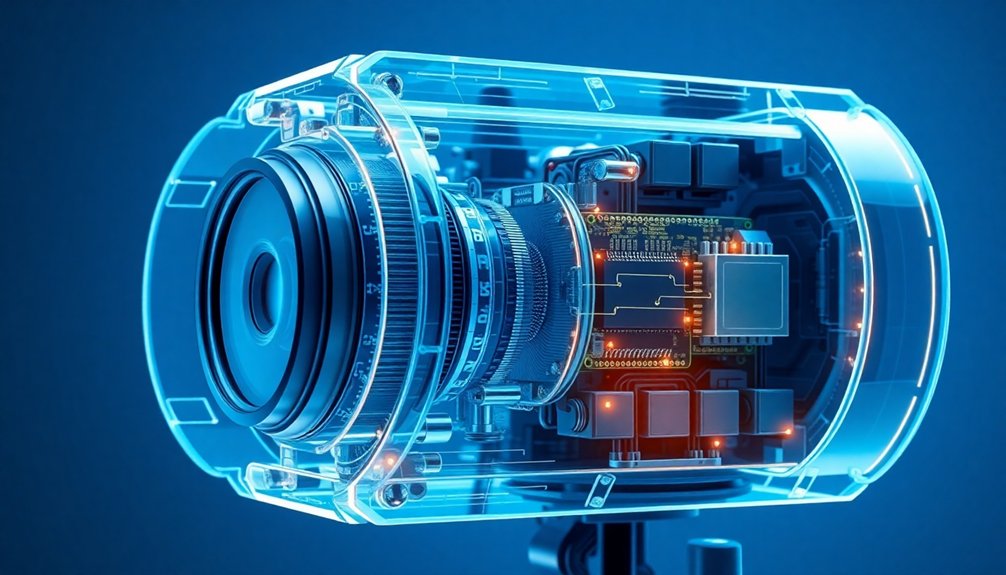

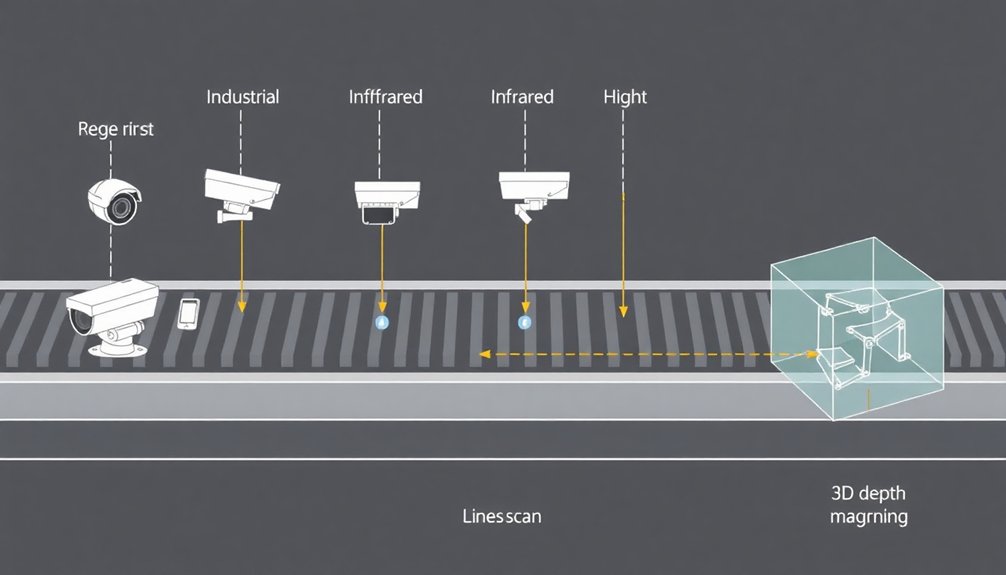

Man kann sich die Robotervision wie ein hochleistungsfähiges Kamerasystem vorstellen, das nicht nur Bilder aufnimmt, sondern versteht, was es sieht. Tiefenwahrnehmungsfähigkeiten Sie ermöglichen es Robotern, zwischen nahen und fernen Objekten zu unterscheiden und erweitern so ihre visuelle Verarbeitung um ein wichtiges räumliches Vorstellungsvermögen. Diese mechanischen Augen erfassen zunächst Bilder mithilfe von Kameras oder LiDAR-Sensoren und verarbeiten die Rohdaten anschließend in einem komplexen Bereinigungsprozess.

Robotervision: eine intelligente Linse, die erfasst und versteht und Rohsensordaten in ein intelligentes Verständnis der Umgebung umwandelt.

Passt gut zu diesem ArtikelEinheitsbaum Go2

Lernen Sie den Unitree Go2 kennen – einen Roboterhund, der geht, rennt, springt und tanzt. Er kartiert seine Umgebung…

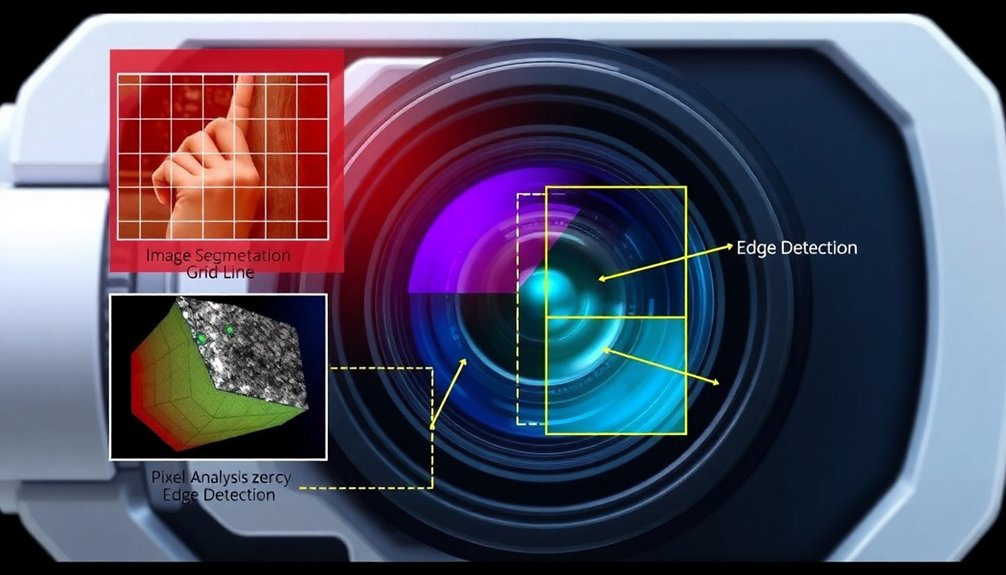

Die Vorverarbeitung entfernt Rauschen, schärft Details und normalisiert Informationen. Anschließend erfolgt die Merkmalsextraktion – die Suche nach Kanten, Formen und wichtigen Details, die dem Roboter helfen, seine Umgebung zu verstehen. Erweiterte Bildverarbeitungsalgorithmen Bildverarbeitungssysteme werden in hochentwickelte Werkzeuge umgewandelt, die gefertigte Produkte mit präzisen Referenzbildern vergleichen und so eine umfassende Qualitätskontrolle ermöglichen.

Anschließend setzt die Mustererkennung ein und wandelt visuelle Daten in handlungsrelevante Erkenntnisse um. Es ist, als würde man Robotern ein Gehirn geben, um ihre visuellen Eingaben zu interpretieren und so kalte, mechanische Wahrnehmung in intelligentes Umweltverständnis zu verwandeln.

Wesentliche Komponenten von Bildverarbeitungssystemen

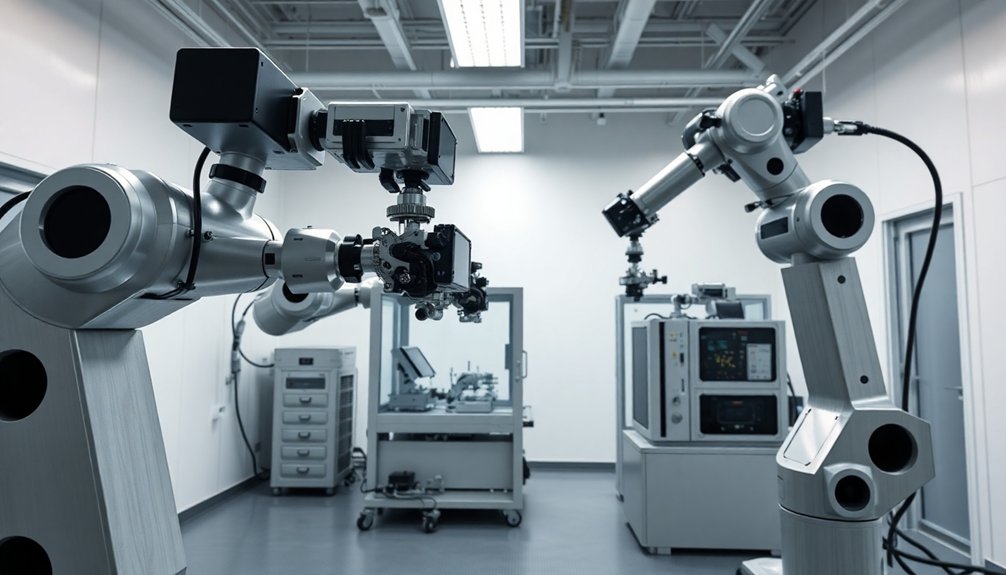

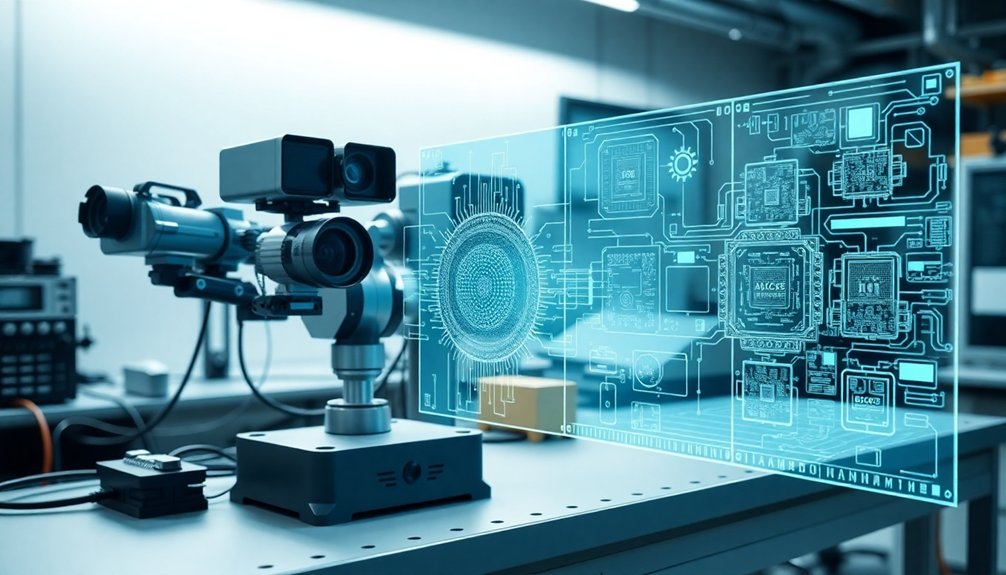

Robotervision ist keine magische Blackbox – sie ist ein Zusammenspiel sorgfältig entwickelter Komponenten, die wie ein präzises Schweizer Uhrwerk zusammenarbeiten. Jede Komponente spielt eine entscheidende Rolle bei der Umwandlung von visuellen Rohdaten in verwertbare Erkenntnisse. industrielle Automatisierungslandschaft ist auf diese komplexen Systeme angewiesen, um komplexe Aufgaben mit beispielloser Genauigkeit auszuführen. Verständnis Funktionsprinzipien optoelektronischer Sensoren ermöglicht es Ingenieuren, Bildverarbeitungssysteme zu entwickeln, die nuancierte visuelle Informationen mit außergewöhnlicher Präzision erfassen. Stereokameratechnologie ermöglicht es diesen Systemen, eine menschenähnliche Tiefenwahrnehmung nachzubilden und so ein differenzierteres Verständnis der visuellen Umgebung zu schaffen.

- BeleuchtungssystemeDie stillen Helden, die Dinge erhellen und verborgene Details hervorheben wie ein Scheinwerfer auf einen Geheimagenten.

- Optische KomponentenObjektive, die Bilder mit chirurgischer Präzision aufnehmen und Licht in digitales Gold verwandeln.

- BildsensorenPixelbasierte Übersetzer, die visuelle Signale in computerlesbare Sprache umwandeln.

- BildverarbeitungssystemeAlgorithmische Gehirne, die Bilder schneller analysieren, als man blinzeln kann.

Wollen Sie wissen, wie Roboter eigentlich „sehen“? Es ist ein komplexes Zusammenspiel von Hardware und Software, das Licht mit atemberaubender Geschwindigkeit und Genauigkeit in Intelligenz umwandelt.

Kameratechnologien für die Robotik

Sie haben vielleicht gehört, dass Kameras nur Bilder aufnehmen, aber in der Robotik sind sie viel komplexer – man kann sie sich als die Augen des Roboters auf Steroiden vorstellen. Aus den Fallstudien in der Studiorobotik, Roboterkamerasysteme sind zunehmend versierter darin geworden, sich an dynamische Produktionsumgebungen anzupassen. Multispektrale Bildgebung Dank moderner Technologien können Roboter heute nicht nur visuelle Daten, sondern auch Tiefeninformationen, Farben und Kontextinformationen mit beispielloser Präzision analysieren.

Unitree R1

Ein leichterer, benutzerfreundlicherer humanoider Roboter für Content-Erstellung, Aktionen, Schulungen und öffentliche Vorführungen. Ideal, wenn es auf Leistung ankommt…

Bei den verschiedenen Kamerasensortypen geht es nicht nur um Megapixel; es geht vielmehr darum, wie präzise ein Roboter seine Umgebung interpretieren kann, von mikroskopisch kleinen Leiterplatten bis hin zu riesigen Produktionshallen. Tiefenwahrnehmungstechnologien So ermöglichen beispielsweise Stereo- und 3D-Vision-Kameras Robotern die Erstellung umfassender räumlicher Karten ihrer Umgebung und wandeln visuelle Eingaben in verwertbare räumliche Informationen um.

Bei der Auswahl der Kameratechnik für einen Roboter müssen Sie die Auflösung, die Leistungsmerkmale und die Objektivauswahl verstehen – denn eine falsche Entscheidung kann den Unterschied zwischen einem Roboter, der sieht, und einem Roboter, der stolpert, ausmachen.

Kamerasensortypen

In der Welt der Robotervision sind nicht alle Kameras gleich. Die visuelle Wahrnehmung Ihres Roboters hängt von der Wahl des richtigen Sensortyps ab:

- CCD-Sensoren: Hochwertige Bildaufnahme im klassischen Stil, perfekt für präzise Aufgaben

- CMOS-SensorenModern, energieeffizient, mit integrierter Verarbeitungstechnologie

- Infrarotkameras: Jenseits der Grenzen des sichtbaren Lichts sehen

- 3D-SensorenTiefenwahrnehmung, die das räumliche Bewusstsein von Robotern revolutioniert

Stellen Sie sich Kamerasensoren wie die Augen Ihres mechanischen Freundes vor. CCD-Sensoren liefern gestochen scharfe Bilder, verbrauchen aber Unmengen an Strom. CMOS-Sensoren hingegen sind die schlanken, leistungsstarken Geräte, die Bilder in Echtzeit verarbeiten können.

Sie möchten sich durch Rauch oder Dunkelheit bewegen? Infrarot- und Ultraschallkameras werden zur Geheimwaffe Ihres Roboters. Jeder Sensortyp dient nicht nur der Bildaufnahme, sondern ermöglicht es, die Umgebung auf eine Weise zu erfassen, die dem menschlichen Auge verborgen bleibt. Zeilenkameras Durch das Scannen jeweils einer Zeile wird eine präzise Bildaufnahme ermöglicht, wodurch eine detaillierte Inspektion von kontinuierlichen Materialien in der Fertigung möglich wird.

Der richtige Sensor verwandelt eine blinde Maschine in einen aufmerksamen, anpassungsfähigen Begleiter. KI-gestützte Bildverarbeitungssysteme Sie revolutionieren die Art und Weise, wie Roboter komplexe visuelle Umgebungen interpretieren und mit ihnen interagieren, und bieten ein beispielloses Maß an intelligenter Wahrnehmung.

Auflösung und Leistung

Fünf Millisekunden. So schnell können Roboter-Vision-Systeme Objekte heute mit nahezu perfekter Genauigkeit erkennen und klassifizieren. Haben Sie sich jemals gefragt, wie Maschinen die Welt sehen? Es ist keine Magie – es ist Präzisionstechnik. Präzision der Pixelauflösung hat einen direkten Einfluss auf die Fähigkeit eines Roboters, kleinste Details zu erkennen und Objekte mit außergewöhnlicher Genauigkeit zu klassifizieren.

Die Kamera Ihres Roboters nimmt nicht nur Bilder auf, sondern misst jedes Pixel wie ein mikroskopisches Lineal. Auflösung bedeutet nicht nur Megapixel – es geht darum, kleinste Details mit höchster Genauigkeit zu erfassen. Adaptives maschinelles Lernen Ermöglicht es Bildverarbeitungssystemen, ihre Objekterkennungsfähigkeiten kontinuierlich zu verbessern, indem sie komplexe Sensordaten verarbeiten und Wahrnehmungsalgorithmen verfeinern. Fortschrittliche Bildverarbeitungssysteme können die Objekterkennung dadurch erheblich verbessern. strategische Kalibrierungstechniken, um eine gleichbleibende Leistung in unterschiedlichen Fertigungsumgebungen zu gewährleisten.

Doch hier liegt der Haken: Roboteraugen sind nicht alle gleich. Manche Systeme erreichen in kontrollierten Umgebungen eine Objekterkennungsrate von 99.9 %, während andere bei geringem Kontrast oder schwierigen Lichtverhältnissen Probleme haben.

Sie benötigen ein System, das Ihren spezifischen Anforderungen entspricht – sei es für die Fabrikinspektion oder die Bewältigung komplexen Geländes. Die richtige Auflösung entscheidet darüber, ob ein Roboter funktioniert oder nur gut aussieht.

Grundlagen der Objektivauswahl

Die Wahl des richtigen Kameraobjektivs für einen Roboter ist keine Raketenwissenschaft – es ist eher wie die Partnersuche für Maschinen. Die Wahl des Objektivs kann die visuelle Leistung eines Roboters entscheidend beeinflussen, also achten Sie genau darauf:

- Die Sensorgröße ist wichtigPassen Sie Ihr Objektiv an Ihren Sensor an wie ein perfekt passendes Puzzleteil.

- Die Brennweite ist entscheidend: Steuern Sie die visuelle Reichweite Ihres Roboters mit der richtigen Objektivlänge.

- Arbeitsabstand zählt: Wissen Sie, wie weit Ihr Roboter „sehen“ muss.

- Licht ist allesDie Blende steuert, wie viele visuelle Informationen einfallen.

Betrachten Sie eine Linse als das Auge Ihres Roboters. Es geht nicht nur darum, Bilder aufzunehmen – es geht darum, die richtigen Bilder aufzunehmen.

Eine unpassende Linse ist, als würde man seinem Roboter eine Brille vom falschen Augenarzt geben. Präzision ist entscheidend. Die falsche Linse kann Ihr Hightech-Sehsystem in einen teuren Briefbeschwerer verwandeln.

Treffen Sie die richtige Wahl, und Ihr Roboter wird es Ihnen mit kristallklarer Wahrnehmung danken.

Bildaufnahmemethoden verstehen

Wenn Roboter die Welt sehen müssen, greifen sie auf eine schier unüberschaubare Anzahl von Bildaufnahmemethoden zurück, die die Kamera Ihres Smartphones wie ein Malwerkzeug aus der Steinzeit erscheinen lassen.

Von Webcams, die Einzelbilder aufnehmen, bis hin zu Tiefenkameras, die Entfernungen messen – diese visuellen Systeme sind weit mehr als nur einfache Point-and-Shoot-Geräte.

Stellen Sie sich Stereosehen vor, das dem menschlichen Auge nachempfunden ist, wobei zwei Kameras leicht unterschiedliche Perspektiven erfassen, um ein räumliches 3D-Wahrnehmungsvermögen zu erzeugen.

Oder denken Sie an strukturierte Lichteffekte, die Muster auf Oberflächen projizieren, um die Tiefe abzubilden, ähnlich einer Art robotischem Röntgenblick.

Laufzeitsensoren senden Lichtimpulse aus und messen deren Rückweg, wodurch Robotern im Prinzip eine übermenschliche Entfernungswahrnehmung verliehen wird.

Sie wünschen sich Präzision?

Maschinelle Lernalgorithmen analysieren diese aufgenommenen Bilder schneller, als Sie blinzeln können, identifizieren Objekte und berechnen Navigationsrouten mit erschreckender Genauigkeit.

Optische Sensoren und ihre Funktionen

Die mechanischen Augen der Robotik – die optischen Sensoren – sind die unbesungenen Helden, die Maschinen von blinden Metallkreaturen in präzise sehende digitale Jäger verwandeln.

Stellen Sie sich diese Sensoren als das Schweizer Taschenmesser der Sicht Ihres Roboters vor:

- Wärmebildkamera, die Wärmesignaturen wie ein Science-Fiction-Superheld erkennt

- Tiefenwahrnehmung, die Umgebungen schneller erfasst, als man blinzeln kann.

- Farberkennung, die Materialien mit laserähnlicher Präzision unterscheidet

- Annäherungswarnungen, die Kollisionskatastrophen verhindern

Diese winzigen technologischen Wunderwerke können mehr als nur ihre Umgebung betrachten – sie interpretieren komplexe visuelle Landschaften in Millisekunden.

Von Produktionshallen bis hin zu Operationssälen wandeln optische Sensoren Rohdaten in verwertbare Informationen um.

Sie machen den Unterschied aus zwischen einem Roboter, der seine Aufgaben unbeholfen erledigt, und einem, der mit chirurgischer Präzision navigiert.

Sie wollen eine Maschine, die wirklich sieht? Optische Sensoren sind Ihr Ticket in die Zukunft.

Grundlagen der Bildverarbeitung

Von robotischen optischen Sensoren, die Umgebungen scannen, zoomen wir nun in die digitalen Gehirne hinter der maschinellen Bildverarbeitung hinein: die Bildverarbeitung. Hier werden rohe visuelle Daten in aussagekräftige Erkenntnisse umgewandelt, die Roboter tatsächlich verstehen können. Deep-Learning-Algorithmen Robotern ermöglichen, ihr visuelles Verständnis durch kontinuierliche Konfrontation mit unterschiedlichen Bildern schrittweise zu verbessern.

| Produktion | Zweck | Komplexität |

|---|---|---|

| Filterung | Schalldämmung | Niedrig |

| Segmentierung | Objektidentifikation | Medium |

| Merkmalsextraktion | Pattern Recognition | Hoch |

| Farbtransformation | Erweiterte Analyse | Medium |

Bildverarbeitung lässt sich mit dem Lehren des Sehens für einen Roboter vergleichen – nicht nur das Sammeln von Pixeln, sondern deren Interpretation. Es geht darum, visuelle Informationen in verständliche Einheiten zu zerlegen: Kanten zu erkennen, Formen zu identifizieren und räumliche Beziehungen zu verstehen. Algorithmen wandeln chaotisches Bildrauschen in strukturierte Daten um. Stellen Sie sich vor, wie aus einem unscharfen Schnappschuss eine präzise Karte von Objekten, Texturen und potenziellen Interaktionen entsteht. Die Magie geschieht durch mathematische Transformationen, die komplexe visuelle Informationen vereinfachen und so die Wahrnehmung von Robotern ermöglichen. Wer hätte gedacht, dass Mathematik Maschinen Augen verleihen kann?

Beleuchtungstechniken für klare Sicht

Sie werden die Beleuchtung für die Robotersicht so perfekt beherrschen wie ein professioneller Fotograf, aber mit deutlich coolerer Technologie.

Eine diffuse Lichtverteilung trägt dazu bei, die Beleuchtung gleichmäßig über die Oberflächen zu verteilen und so sicherzustellen, dass Ihr Roboter jedes mikroskopische Detail ohne harte Schatten oder tote Winkel erkennen kann.

Diffuse Lichtverteilung

Stellen Sie sich vor, Roboter-Vision-Systeme haben Schwierigkeiten, in rauen Industrieumgebungen klar zu sehen – genau da kommt die diffuse Lichtverteilung wie ein Beleuchtungs-Superheld ins Spiel.

Warum ist das wichtig? Schau dir diese Blitz-Superkräfte an:

- Beseitigt störende Schatten und Blendeffekte, die Maschinen zum Blinzeln bringen.

- Sorgt für eine gleichmäßige Ausleuchtung komplexer Oberflächen

- Wirkt wie von Zauberhand auf glänzenden, gewölbten Objekten, die Kameras normalerweise verwirren.

- Verwandelt knifflige Inspektionsaufgaben in kristallklare visuelle Erlebnisse

Kuppel- und flache Streulichtleuchten sind nicht nur schicke Accessoires – sie revolutionieren Bildverarbeitungssysteme. Indem sie ein Objekt mit weichem, aus verschiedenen Winkeln einfallendem Licht ausleuchten, lösen diese Technologien Sichtbarkeitsprobleme, an denen herkömmliche Kameras versagen würden.

Ob Sie winzige Leiterplatten oder massive Automobilteile prüfen – diffuses Licht garantiert Ihrem Roboter chirurgische Präzision. Schluss mit Rätselraten, Schluss mit übersehenen Fehlern – nur noch klare, ungetrübte Sicht.

Direkte Oberflächenbeleuchtung

Wenn Roboter-Visionsysteme gestochen scharfe Bilder benötigen, kommt die direkte Oberflächenbeleuchtung wie ein Licht-Ninja zum Einsatz, der bereit ist, visuelles Rauschen zu durchdringen.

Es ist quasi der Superheld der Bildverarbeitung: Es projiziert Licht direkt auf Oberflächen und macht so jedes noch so kleine Detail sichtbar. Sie wollen den winzigen Kratzer auf einer Platine entdecken? Mit dieser Technik ist das kein Problem.

Durch die strategische Positionierung von Lichtern – oft in einem 90-Grad-Winkel – werden Unvollkommenheiten sichtbar, die normalerweise im Schatten verborgen bleiben würden.

Man kann es sich wie forensische Beleuchtung für Maschinen vorstellen: kontrastreiche, schnörkellose Beleuchtung, die vage Formen in präzise Datenpunkte verwandelt.

Ideal für die Qualitätskontrolle, die robotergestützte Montage und die Sicherstellung, dass jedes gefertigte Teil den Spezifikationen entspricht. Wer hätte gedacht, dass Licht ein so präziser Detektiv sein kann?

Hintergrundbeleuchtung Objektdetails

Drei Schlüsselelemente machen die Hintergrundbeleuchtung zu einer Geheimwaffe in der Robotervision: reiner Kontrast, präzise Silhouetten und fehlerfreie Detektion. Diese Beleuchtungstechnik verwandelt die Robotervision in einen Superhelden mit röntgenähnlichen Kräften:

- Sofortige Objekterkennung durch die Erstellung scharfer Schwarz-Weiß-Umrisse

- Messung äußerer Abmessungen mit chirurgischer Präzision

- Die Anwesenheit oder Abwesenheit eines Objekts schneller erkennen, als man blinzeln kann.

- Aufdeckung verborgener innerer Strukturen durch unterschiedliche Lichtdurchdringung

Das Coolste daran? Bei der Hintergrundbeleuchtung geht es nicht um Oberflächendetails – es geht einzig und allein um das Gesamtbild.

Indem Sie Lichter hinter Objekten positionieren und deren Silhouetten erfassen, verleihen Sie Ihrem Roboter-Vision-System im Grunde eine Art Wahrheitsserum. Es reduziert die Komplexität und lässt nur reine, unverfälschte Form und Dimension übrig.

Wer braucht schon ausgefeilte Kameratricks, wenn man buchstäblich durch Dinge hindurchsehen kann?

Interpretation visueller Daten

Wie „sehen“ Roboter eigentlich ihre Umgebung? Es ist, als würde man Maschinen ein Gehirn und Augen geben, nur viel cooler. Sie verarbeiten visuelle Daten mithilfe komplexer Algorithmen, die Bilder in überschaubare Informationen zerlegen.

Zuerst erfassen Kameras und Sensoren die visuellen Rohdaten, dann kommt hochentwickelte Software zum Einsatz – sie filtert Rauschen, erkennt Kanten und segmentiert Szenen in Windeseile. Deep-Learning-Modelle erkennen Objekte mit unglaublicher Genauigkeit und wandeln Pixel in aussagekräftige Erkenntnisse um.

Man kann es sich vorstellen wie die Ausbildung eines übermenschlichen Detektivs, der niemals müde wird. Die Magie entsteht, wenn diese Systeme in Millisekunden einen Stuhl erkennen, seine Entfernung messen, seinen Kontext verstehen und entscheiden können, was als Nächstes zu tun ist.

Im Wesentlichen wandelt die Robotervision bedeutungslose visuelle Daten in verwertbare Informationen um, die Maschinen dabei helfen, sich in der Welt zurechtzufinden und mit ihr zu interagieren.

Software-Algorithmen in der Robotervision

Da Roboter keine Augen wie wir haben, sind sie auf ausgeklügelte Softwarealgorithmen angewiesen, um visuelle Rohdaten in aussagekräftige Erkenntnisse umzuwandeln.

Diese digitalen Bildverarbeitungssysteme wandeln Pixel durch clevere Rechentricks in aussagekräftige Wahrnehmungen um:

- Das Rauschen herausfilternGauß- und Medianfilter entfernen visuelle Störungen und sorgen so für kristallklare Bilder.

- Grenzen findenKantenerkennungsalgorithmen verfolgen Objektkonturen wie ein robotergestützter Forensikexperte.

- Aus Beispielen lernenConvolutional Neural Networks verschlingen Bilddatensätze und erkennen komplexe Muster schneller, als man blinzeln kann.

- Kontext verstehenDie semantische Segmentierung kennzeichnet jedes Pixel und liefert Robotern so eine detaillierte Szenenkarte.

Man kann sich diese Algorithmen als die Augen des Roboters vorstellen – sie übersetzen visuelles Chaos in verwertbare Informationen.

Sie sehen nicht nur, sie interpretieren, analysieren und treffen in Sekundenbruchteilen Entscheidungen, die die menschliche Wahrnehmung wie eine Zeitlupenwiederholung erscheinen lassen.

Integration mit Robotersteuerungssystemen

Sie haben sich wahrscheinlich schon einmal gefragt, wie Roboter ihre Welt eigentlich „sehen“ und verstehen – und es dreht sich alles um ausgeklügelte Kommunikationsprotokolle und blitzschnelle Bildverarbeitung.

Wenn Kameras und Sensoren über Hochgeschwindigkeitsnetzwerke mit Robotersteuerungssystemen kommunizieren, schaffen sie im Grunde ein Echtzeit-Nervensystem, das es Maschinen ermöglicht, schneller zu reagieren, als man blinzeln kann.

Stellen Sie sich vor, Sie geben Ihrem Roboterfreund ein Paar Hochleistungsaugen, die visuelle Daten sofort in präzise Bewegungen umsetzen können und so das, was einst Science-Fiction war, zur heutigen industriellen Realität machen. Sensorfusionstechnologien Robotern ermöglichen, mehrere Datenströme zu integrieren und so ein umfassendes Verständnis ihrer Umgebung zu schaffen, das über die traditionelle visuelle Wahrnehmung hinausgeht.

Datenkommunikationsprotokolle

Wenn Roboter miteinander kommunizieren, benötigen sie eine gemeinsame Sprache – und genau hier kommen Datenkommunikationsprotokolle ins Spiel.

Diese digitalen Übersetzer sorgen dafür, dass Roboter-Bildverarbeitungssysteme in Industrieanlagen reibungslos funktionieren. Hier erfahren Sie, warum sie so wichtig sind:

- Protokolle definieren, wie Maschinen Informationen austauschen, von Sensordaten bis hin zu präzisen Bewegungsbefehlen.

- Unterschiedliche Kommunikationsmethoden (Ethernet, seriell, drahtlos) dienen spezifischen Roboteranforderungen.

- Die Echtzeitfähigkeit hängt von der Wahl des richtigen Protokolls ab.

- Die Kompatibilität entscheidet darüber, ob Ihr Roboter-Vision-System funktioniert oder zu einem teuren Briefbeschwerer wird.

EtherNet/IP und EtherCAT sind unangefochten die führenden Technologien und ermöglichen blitzschnelle Datenübertragungen zwischen Bildverarbeitungssystemen und Robotersteuerungen.

Man kann sie sich als die universellen Übersetzer der Automatisierungswelt vorstellen – sie helfen Maschinen, sich nahtlos zu unterhalten und Missverständnisse zu vermeiden, die eine präzise Aufgabe in eine mechanische Komödie der Fehler verwandeln könnten.

Echtzeit-Bildverarbeitung

Die Datenkommunikationsprotokolle bilden die Grundlage, aber die Echtzeit-Bildverarbeitung ist der Punkt, an dem Roboter erst richtig zum Leben erwachen.

Stellen Sie sich einen Roboter vor, der nicht nur blind Anweisungen befolgt, sondern seine Umgebung tatsächlich wahrnimmt und versteht. Solche Systeme transformieren die Roboterwahrnehmung von starrer Programmierung hin zu dynamischer Interaktion.

Hochgeschwindigkeitskameras und Sensoren erfassen Details in Sekundenbruchteilen und wandeln Informationen aus der realen Welt in handlungsrelevante Daten um – schneller als man blinzeln kann. Dank visueller Servoregelung können Roboter ihre Bewegungen nun spontan anpassen, ohne auf vorprogrammierte Koordinaten angewiesen zu sein.

Sie sind nicht mehr nur Maschinen; sie sind adaptive Wesen, die Objekte erkennen, die Anwesenheit von Menschen wahrnehmen und mit verblüffender Präzision reagieren.

Man kann es sich so vorstellen, als würde man Robotern ein Gehirn und Augen geben, die perfekt synchron arbeiten – Schluss mit gedankenloser Automatisierung, sondern intelligente, kontextsensitive Maschinen, die bereit sind, die Art und Weise, wie wir mit Technologie interagieren, zu revolutionieren.

Neue Trends in der Bildverarbeitungstechnologie

Während die Technologie des maschinellen Sehens wie ein Sportwagen ohne Geschwindigkeitsbegrenzung vorwärts rast, verändert sich die Landschaft der KI-gesteuerten visuellen Wahrnehmung schneller, als die meisten Branchen blinzeln können.

Bereit für einen Blick in die Zukunft? Entdecken Sie diese atemberaubenden Trends:

- Edge Computing bringt die Echtzeit-Bildverarbeitung direkt auf Ihre Geräte.

- 3D-Rekonstruktionsalgorithmen werden digitale Zwillinge physischer Räume erzeugen.

- Spezialisierte Sensoren werden über die menschlichen Sehgrenzen hinaussehen.

- KI wird synthetische Trainingsdatensätze generieren und so das maschinelle Lernen beschleunigen.

Stellen Sie sich Roboter vor, die Tiefen wahrnehmen, komplexe Umgebungen analysieren und blitzschnell Entscheidungen treffen können, ohne dabei ins Schwitzen zu geraten.

Wir sprechen hier nicht nur von schrittweisen Verbesserungen – es handelt sich um eine umfassende Revolution in der Art und Weise, wie Maschinen visuelle Informationen verstehen.

Die Zukunft kommt nicht nur, sie verändert bereits unsere technologische Landschaft – Pixel für Pixel.

Die Leute fragen auch nach Robotern.

Was kostet ein einfaches Roboter-Bildverarbeitungssystem typischerweise für kleine Unternehmen?

Sie finden Einsteiger-Robotik-Bildverarbeitungssysteme für 1,000 bis 3,000 US-Dollar, die sich perfekt für kleine Unternehmen eignen, die grundlegende Qualitätskontrollen, Barcode-Lesung und einfache Messungen durchführen möchten, ohne dabei ihr Budget zu sprengen.

Können Roboter-Visionsysteme auch bei schlechten Lichtverhältnissen oder in schwierigen Umgebungen effektiv funktionieren?

Sie sehen klar, passen sich schnell an und nehmen Details intensiv wahr. Robotervisionssysteme für schwache Lichtverhältnisse ermöglichen die effektive Navigation in anspruchsvollen Umgebungen durch den Einsatz fortschrittlicher Sensoren, Spezialkameras und innovativer Technologien, die die Bildqualität bei schlechten Lichtverhältnissen verbessern.

Welche Programmierkenntnisse sind für die Entwicklung oder Wartung von Bildverarbeitungssystemen erforderlich?

Sie benötigen Python für vielseitige Einsatzmöglichkeiten, C++ für optimale Leistung und OpenCV für die Bildverarbeitung. Meistern Sie Techniken des maschinellen Lernens, verstehen Sie neuronale Netze und entwickeln Sie fundierte ROS-Kenntnisse, um robuste Robotervisionssysteme effektiv zu erstellen und zu warten.

Wie genau sind Roboter-Visionsysteme im Vergleich zur menschlichen Sehwahrnehmung?

Wie ein Falke, der seine Beute erspäht, arbeiten Roboter-Vision-Systeme unglaublich präzise und erreichen bei strukturierten Aufgaben oft nahezu perfekte Genauigkeit. Sie übertreffen den Menschen in Geschwindigkeit, Zuverlässigkeit und der Erkennung kleinster Defekte in verschiedensten industriellen Anwendungen.

Benötigen unterschiedliche Robotervisionssysteme eine spezielle Schulung der Bediener?

Ja, Sie benötigen spezielle Schulungen für die verschiedenen Robotervisionssysteme. Diese verfügen über jeweils eigene Hardware, Software und Anwendungen. Zertifizierungsprogramme und herstellerspezifische Kurse helfen Ihnen, die für jedes System erforderlichen Kenntnisse und Fähigkeiten zu erwerben.

Warum das in der Robotik wichtig ist

Robotervision ist keine Science-Fiction mehr – sie ist Realität. Bis 2025 wird der Markt für maschinelles Sehen ein Volumen von 14.4 Milliarden US-Dollar erreichen und damit beweisen, dass diese intelligenten Augen kein vorübergehender Trend sind. Sie erleben gerade eine technologische Revolution, in der Maschinen ihre Umgebung buchstäblich sehen und verstehen können. Von der Fertigung bis zum Gesundheitswesen verändert Robotervision unsere Interaktion mit Technologie grundlegend. Wollen Sie auf dem neuesten Stand bleiben? Lernen Sie kontinuierlich dazu, bleiben Sie neugierig und nutzen Sie die Revolution der visuellen Intelligenz.

Referenzen

- https://robotsdoneright.com/Articles/components-of-a-robotic-vision-system.html

- https://www.borunte.net/info/what-are-the-general-components-of-a-simple-ro-84696243.html

- https://recognitionrobotics.com/what-are-robotic-vision-systems/

- https://www.loopr.ai/blogs/understanding-the-key-components-of-machine-vision-systems

- https://www.baslerweb.com/en-us/learning/components-vision-system/

- https://www.tencentcloud.com/techpedia/105783

- https://www.tdipacksys.com/blog/principles-of-vision-inspection-system/

- https://www.borunte.net/info/detailed-introduction-to-the-working-principle-81967228.html

- https://lewisgroup.uta.edu/ee5325/lectures99/vision.pdf

- https://www.augmentus.tech/blog/what-is-robot-vision-system/

Erkunden Sie die Roboterfamilien, die für diesen Anwendungsfall geeignet sind.

Einheitsbaum Go2

Lernen Sie den Unitree Go2 kennen – einen Roboterhund, der geht, rennt, springt und tanzt. Er kartiert seine Umgebung…

Unitree R1

Ein leichterer, benutzerfreundlicherer humanoider Roboter für Content-Erstellung, Aktionen, Schulungen und öffentliche Vorführungen. Ideal, wenn es auf Leistung ankommt…

Stöbern Sie durch die Roboter, vergleichen Sie die Modelle und reservieren Sie den passenden, ohne ihn kaufen zu müssen.

Mit Futurobots bewegen Sie sich schneller, bleiben flexibel und erhalten Zugang zu fortschrittlichen Robotern, ohne diese kaufen zu müssen.