Robotyczna wizja zmienia maszyny w maszyny widzące, które interpretują świat niczym superinteligentne kamery. Odkryjesz, jak kamery, czujniki i szalenie inteligentne algorytmy pomagają robotom „widzieć”, przekształcając dane wizualne w użyteczną inteligencję. Wyobraź sobie, że dajesz robotom oczy, które potrafią analizować każdy piksel, wykrywać obiekty i poruszać się po złożonych środowiskach w ciągu milisekund. Chcesz zajrzeć za kulisy i dowiedzieć się, jak maszyny uczą się widzieć? Zostań z nami.

Jak działa widzenie robotyczne

Choć roboty mogą wydawać się czymś żywcem wyjętym z filmu science fiction, ich zdolność „widzenia” to w rzeczywistości zdumiewający technologiczny taniec czujników, algorytmów i czystej mocy obliczeniowej.

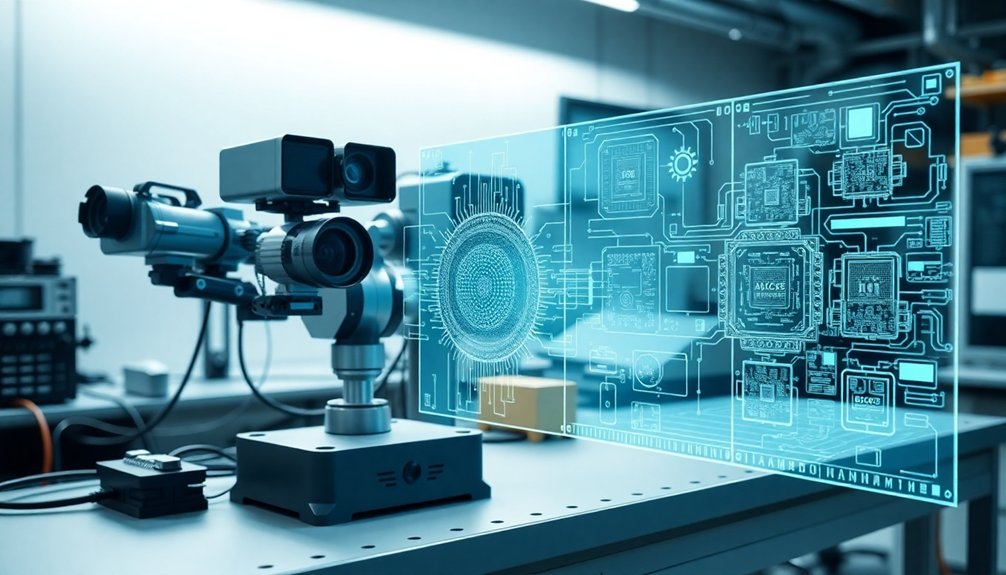

Wyobraź sobie wizję robota jako superdoładowany system kamer, który nie tylko robi zdjęcia, ale także rozumie, na co patrzy. Zdolność postrzegania głębi Umożliwiają robotom rozróżnianie obiektów bliskich i dalekich, dodając im kluczowej świadomości przestrzennej do przetwarzania obrazu. Te mechaniczne oczy zaczynają od przechwytywania obrazów za pomocą kamer lub czujników LiDAR, a następnie przetwarzają te surowe dane w złożonym procesie czyszczenia.

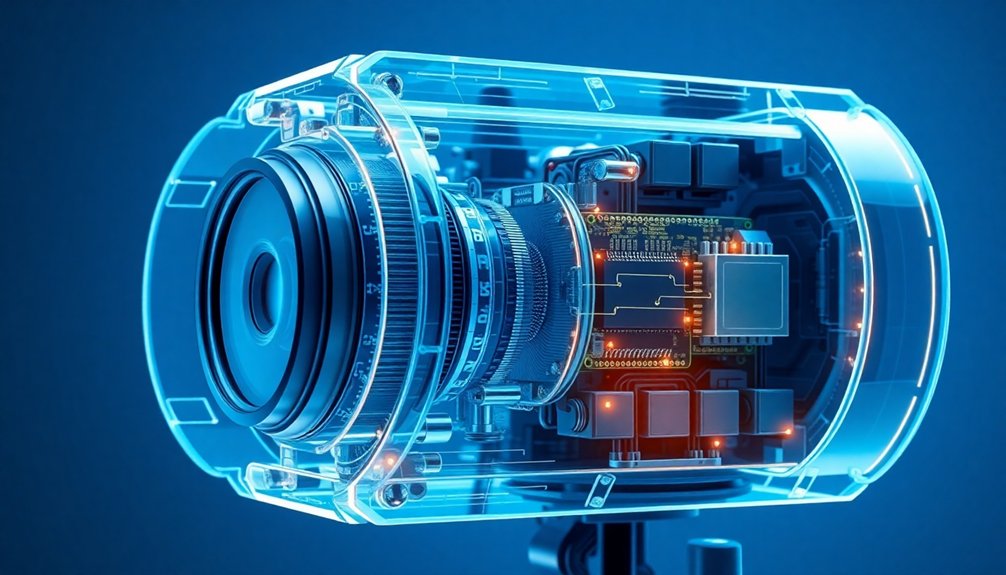

Wizja robota: inteligentna soczewka, która rejestruje i przetwarza surowe dane z czujników, przekształcając je w inteligentne narzędzie do analizy otoczenia.

Dobrze pasuje do tego artykułuUnitree Go2

Poznaj Unitree Go2 — robota-psa, który chodzi, biega, skacze i tańczy. Mapuje swoje otoczenie…

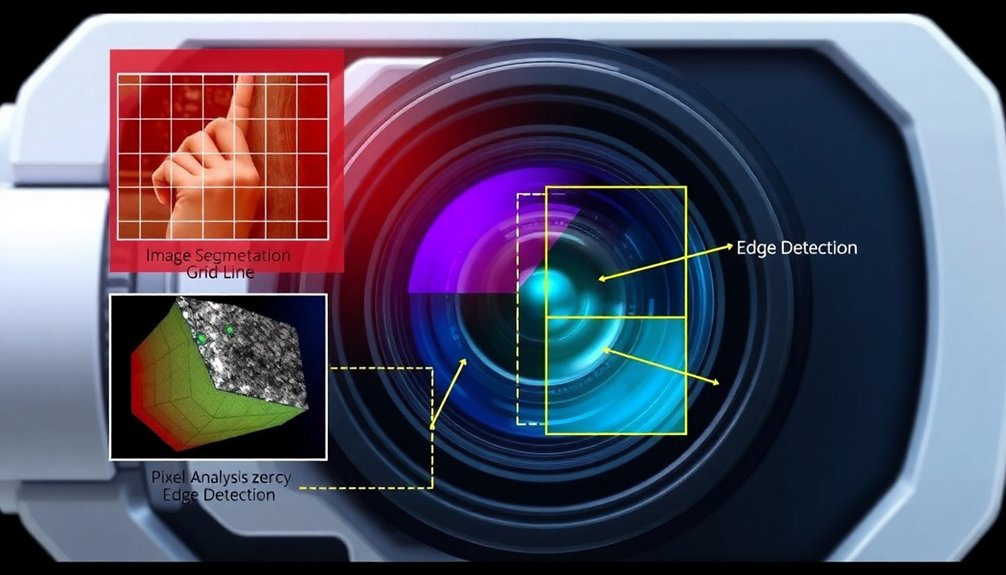

Proces wstępnego przetwarzania usuwa szum, wyostrza szczegóły i normalizuje informacje. Następnie rozpoczyna się ekstrakcja cech – poszukiwanie krawędzi, kształtów i kluczowych szczegółów, które pomagają robotowi zrozumieć otaczający go świat. Zaawansowane algorytmy przetwarzania obrazu przekształcić systemy wizyjne w zaawansowane narzędzia, które porównują wytworzone produkty z precyzyjnymi obrazami referencyjnymi, umożliwiając kompleksową kontrolę jakości.

Następnie funkcję tę przejmuje rozpoznawanie wzorców, przekształcając dane wizualne w praktyczne wnioski. To tak, jakby dać robotom mózg do interpretowania bodźców wizualnych, przekształcając zimną, mechaniczną percepcję w inteligentne rozumienie otoczenia.

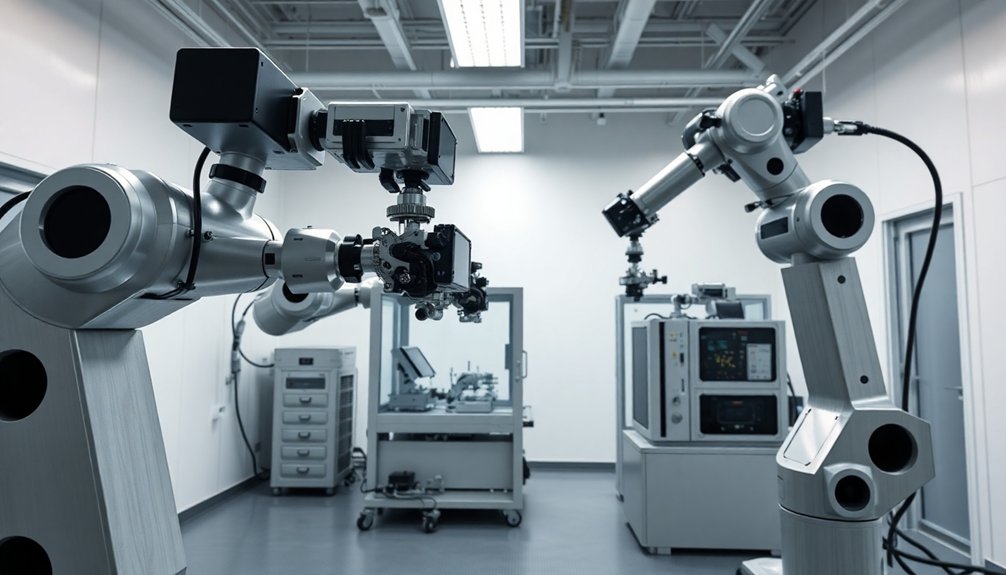

Niezbędne komponenty systemów wizyjnych

Wizja robota to nie tylko magiczna czarna skrzynka – to symfonia starannie zaprojektowanych komponentów, które współpracują ze sobą jak precyzyjny szwajcarski zegarek. Każdy komponent odgrywa kluczową rolę w przekształcaniu surowych danych wizualnych w praktyczne wnioski. krajobraz automatyki przemysłowej opiera się na tych skomplikowanych systemach, aby wykonywać złożone zadania z niespotykaną dotąd dokładnością. Zrozumienie zasady działania czujników optoelektronicznych Umożliwia inżynierom projektowanie systemów wizyjnych, które rejestrują szczegółowe informacje wizualne z niezwykłą precyzją. Technologia kamer stereoskopowych umożliwia tym systemom odtworzenie percepcji głębi podobnej do ludzkiej, co pozwala na bardziej zaawansowane rozumienie środowisk wizualnych.

- Systemy oświetleniowe:Nieopiewani bohaterowie, którzy oświetlają przedmioty, sprawiając, że ukryte szczegóły stają się widoczne niczym reflektor skierowany na tajnego agenta.

- Elementy optyczne:Obiektywy, które rejestrują obrazy z chirurgiczną precyzją, zmieniając światło w cyfrowe złoto.

- Czujniki obrazu:Tłumacze oparte na pikselach, zamieniające sygnały wizualne na język czytelny dla komputera.

- Systemy przetwarzania wizji:Algorytmiczne mózgi analizujące obrazy szybciej, niż człowiek mrugnie.

Chcesz wiedzieć, jak roboty naprawdę „widzą”? To skomplikowany taniec sprzętu i oprogramowania, który przekształca światło w inteligencję z oszałamiającą szybkością i dokładnością.

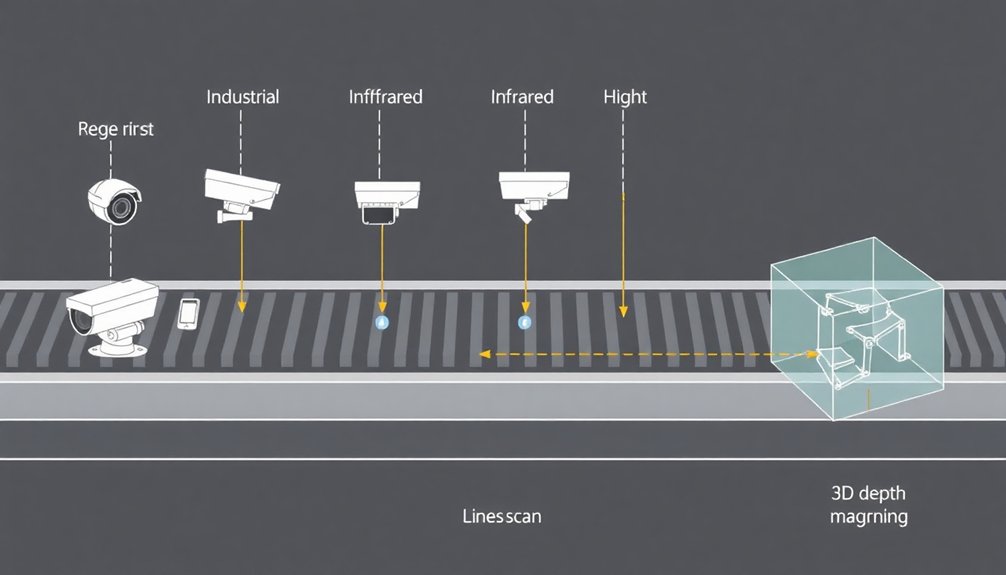

Technologie kamer dla robotyki

Słyszałeś, że kamery to tylko urządzenia rejestrujące obraz, ale w robotyce są o wiele bardziej złożone – pomyśl o nich jak o gałkach ocznych robota na sterydach. Ze studiów przypadków z robotyki studyjnej, systemy kamer robotycznych stają się coraz bardziej wyrafinowane w dostosowywaniu się do dynamicznych środowisk produkcyjnych. Obrazowanie wielospektralne Technologie te umożliwiają obecnie robotom analizowanie nie tylko danych wizualnych, ale także głębi, koloru i informacji kontekstowych z niespotykaną dotąd precyzją.

Unitree R1

Lżejszy, bardziej przystępny robot humanoidalny do zastosowań w treściach, aktywacjach, edukacji i pokazach dla publiczności. Najlepszy, gdy potrzebujesz silnego…

Różne typy czujników kamer nie ograniczają się tylko do megapikseli; chodzi o to, jak precyzyjnie robot potrafi interpretować otaczający go świat, od mikroskopijnych płytek drukowanych po ogromne hale produkcyjne. Technologie percepcji głębi Kamery stereoskopowe i trójwymiarowe umożliwiają robotom tworzenie kompleksowych map przestrzennych otoczenia, przekształcając dane wizualne w użyteczną inteligencję przestrzenną.

Wybierając technologię kamery dla robota, musisz wziąć pod uwagę rozdzielczość, parametry wydajności i dobór obiektywu — ponieważ jeden zły wybór może oznaczać różnicę między robotem, który widzi, a robotem, który się potyka.

Typy czujników aparatu

W świecie wizji robotów nie wszystkie kamery są sobie równe. Percepcja wizualna robota zależy od wyboru odpowiedniego typu czujnika:

- Czujniki CCD:Stara, wysokiej jakości technologia przechwytywania obrazu, idealna do zadań wymagających precyzji

- Czujniki CMOS:Nowoczesny, energooszczędny, ze zintegrowaną magią przetwarzania

- Kamery na podczerwień:Widzenie poza ograniczeniami światła widzialnego

- Czujniki 3D:Percepcja głębi, która zmienia świadomość przestrzenną robotów

Wyobraź sobie czujniki aparatu jak oczy swojego mechanicznego przyjaciela. Matryce CCD zapewniają ostry obraz, ale pożerają energię jak spragniony robot. Matryce CMOS to smukłe, wytrzymałe, widzące maszyny, które potrafią przetwarzać obrazy w locie.

Chcesz poruszać się w dymie lub ciemności? Kamery podczerwone i ultradźwiękowe staną się tajną bronią Twojego robota. Każdy typ czujnika nie służy tylko do rejestrowania obrazu, ale także do rozumienia otoczenia w sposób niedostępny dla ludzkiego oka. Kamery liniowe zapewniają precyzyjne przechwytywanie obrazu poprzez skanowanie linii po linii, umożliwiając szczegółową kontrolę materiałów ciągłych w procesie produkcyjnym.

Odpowiedni czujnik zmienia niewidomą maszynę w spostrzegawczego i zdolnego do adaptacji towarzysza. Systemy wizyjne z obsługą sztucznej inteligencji rewolucjonizują sposób, w jaki roboty interpretują i wchodzą w interakcje ze złożonymi środowiskami wizualnymi, oferując niespotykany dotąd poziom inteligentnej percepcji.

Rozdzielczość i wydajność

Pięć milisekund. Tak szybko robotyczne systemy wizyjne potrafią teraz wykrywać i klasyfikować obiekty z niemal idealną dokładnością. Czy zastanawiałeś się kiedyś, jak maszyny widzą świat? To nie magia, to precyzyjna inżynieria. Precyzja rozdzielczości pikseli ma bezpośredni wpływ na zdolność robota do wykrywania drobnych szczegółów i klasyfikowania obiektów z niezwykłą dokładnością.

Kamera Twojego robota nie tylko rejestruje obrazy, ale mierzy każdy piksel niczym mikroskopijna linijka. Rozdzielczość to nie tylko megapiksele – to wykrywanie najdrobniejszych szczegółów z niesamowitą dokładnością. Adaptacyjne uczenie maszynowe Umożliwia systemom wizyjnym ciągłe doskonalenie możliwości wykrywania obiektów poprzez przetwarzanie złożonych danych z czujników i udoskonalanie algorytmów percepcji. Zaawansowane systemy wizyjne mogą znacząco poprawić wykrywanie obiektów poprzez strategiczne techniki kalibracji, zapewniając spójną wydajność w różnych środowiskach produkcyjnych.

Ale jest pewien haczyk: nie wszystkie oczy robotów są sobie równe. Niektóre systemy wykrywają obiekty w 99.9% w kontrolowanych warunkach, podczas gdy inne mają problemy z niskim kontrastem lub trudnym oświetleniem.

Potrzebujesz systemu dopasowanego do Twoich konkretnych potrzeb – niezależnie od tego, czy chodzi o inspekcję fabryki, czy o poruszanie się po trudnym terenie. Właściwa rozdzielczość to różnica między robotem, który działa, a takim, który po prostu wygląda świetnie.

Podstawy wyboru obiektywu

Wybór odpowiedniego obiektywu do robota to nie fizyka kwantowa – to raczej dobieranie maszyn. Wybór obiektywu może zadecydować o jakości obrazu robota, więc zwróć uwagę na:

- Rozmiar czujnika ma znaczenie:Dopasuj obiektyw do czujnika jak idealny element układanki.

- Ogniskowa jest najważniejsza:Kontroluj zasięg widzenia swojego robota za pomocą odpowiedniej długości soczewki.

- Odległość robocza ma znaczenie:Dowiedz się, jak daleko musi „widzieć” Twój robot.

- Światło jest wszystkim:Aperture kontroluje ilość napływających informacji wizualnych.

Wyobraź sobie soczewkę jako gałkę oczną swojego robota. Nie chodzi tylko o robienie zdjęć, ale o robienie właściwych zdjęć.

Niedopasowana soczewka to jak danie robotowi okularów korekcyjnych od niewłaściwego okulisty. Precyzja ma znaczenie. Niewłaściwa soczewka może zamienić Twój zaawansowany technologicznie system widzenia w drogi przycisk do papieru.

Dokonuj mądrego wyboru, a Twój robot podziękuje Ci krystalicznie czystą percepcją.

Zrozumienie metod przechwytywania obrazu

Kiedy roboty muszą zobaczyć świat, wykorzystują oszałamiającą liczbę metod przechwytywania obrazu, przy których aparat w Twoim smartfonie wyglądałby jak narzędzie malarskie z epoki kamienia łupanego.

Począwszy od kamer internetowych rejestrujących pojedyncze klatki, aż po kamery głębi mierzące odległości, te systemy wizualne to coś więcej niż tylko urządzenia typu „wyceluj i pstryknij”.

Wyobraź sobie widzenie stereoskopowe imitujące ludzkie oko, z dwiema kamerami rejestrującymi nieco różne perspektywy, co pozwala na stworzenie trójwymiarowej przestrzeni.

Można też pomyśleć o sztuczkach ze światłem strukturalnym, które rzucają wzory na powierzchnie, aby odwzorować głębię, niczym w robotycznym widzeniu rentgenowskim.

Czujniki czasu przelotu wysyłają impulsy świetlne i mierzą ich drogę powrotną, zapewniając robotom nadludzką percepcję odległości.

Chcesz precyzji?

Algorytmy uczenia maszynowego będą analizować zarejestrowane obrazy szybciej, niż zdążysz mrugnąć, identyfikując obiekty i wyznaczając trasy nawigacyjne z przerażającą dokładnością.

Czujniki optyczne i ich funkcje

Mechaniczne gałki oczne robotyki — czujniki optyczne — to nieopiewani bohaterowie, którzy przekształcają maszyny ze ślepych, metalowych stworzeń w precyzyjnie widzących, cyfrowych łowców.

Wyobraź sobie te czujniki jako szwajcarski scyzoryk Twojego robota:

- Wizja termiczna, która wykrywa sygnatury cieplne niczym superbohater z filmów science fiction

- Percepcja głębi, która mapuje otoczenie szybciej, niż mrugniesz okiem

- Rozpoznawanie kolorów pozwalające rozróżniać materiały z precyzją lasera

- Alerty o bliskości zapobiegające katastrofom kolizyjnym

Te niewielkie cuda techniki potrafią zrobić więcej niż tylko rozglądać się – potrafią interpretować złożone krajobrazy wizualne w ciągu milisekund.

Od hal produkcyjnych po sale operacyjne – czujniki optyczne przekształcają surowe dane w użyteczne informacje.

To one decydują o różnicy między robotem wykonującym zadania nieudolnie, a takim, który porusza się z chirurgiczną precyzją.

Szukasz maszyny, która naprawdę widzi? Czujniki optyczne to Twój bilet do przyszłości.

Podstawy przetwarzania obrazu

Od robotycznych czujników optycznych skanujących otoczenie, teraz zagłębiamy się w cyfrowe mózgi stojące za wizją maszynową: przetwarzanie obrazu. To właśnie tam surowe dane wizualne przekształcają się w istotne wnioski, które roboty mogą faktycznie zrozumieć. Algorytmy głębokiego uczenia umożliwić robotom stopniowe doskonalenie rozumienia wizualnego poprzez ciągłą ekspozycję na różnorodne obrazy.

| Działanie | Cel | Złożoność |

|---|---|---|

| Filtracja | Redukcja szumów | Niski |

| Segmentacja | Identyfikacja obiektu | Średni |

| Ekstrakcja cech | Pattern Recognition | Wysoki |

| Transformacja koloru | Ulepszona analiza | Średni |

Wyobraź sobie przetwarzanie obrazu jako uczenie robota „widzenia” – nie tylko zbierania pikseli, ale także ich interpretacji. Chodzi o rozbicie informacji wizualnej na łatwe do przyswojenia fragmenty: wykrywanie krawędzi, rozpoznawanie kształtów i rozumienie relacji przestrzennych. Algorytmy przekształcają chaotyczny szum wizualny w ustrukturyzowane dane. Wyobraź sobie, że rozmazana migawka zamienia się w precyzyjną mapę obiektów, tekstur i potencjalnych interakcji. Magia dzieje się dzięki matematycznym transformacjom, które upraszczają złożone informacje wizualne, umożliwiając robotom percepcję. Kto by pomyślał, że matematyka może dać maszynom oczy?

Techniki oświetlenia zapewniające wyraźne widzenie

Będziesz chciał uzyskać oświetlenie pozwalające na obserwację robota jak profesjonalny fotograf, ale przy użyciu o wiele lepszej technologii.

Rozproszone światło pozwala na równomierne rozprowadzenie oświetlenia na powierzchniach, dzięki czemu robot może dostrzec każdy, nawet mikroskopijny szczegół, bez ostrych cieni i martwych punktów.

Rozproszony rozkład światła

Wyobraź sobie, że systemy wizyjne robotów mają problem z wyraźnym widzeniem w trudnych warunkach przemysłowych — to właśnie tam rozproszone światło wkracza do akcji niczym superbohater oświetlenia.

Dlaczego to takie ważne? Sprawdź te supermoce oświetlenia:

- Eliminuje nieprzyjemne cienie i odblaski, które powodują mrużenie oczu przez maszyny

- Zapewnia równomierne oświetlenie złożonych powierzchni

- Działa cuda na błyszczących, zakrzywionych obiektach, które zazwyczaj mylą aparaty fotograficzne

- Przekształca trudne zadania inspekcyjne w krystalicznie czyste doświadczenia wizualne

Oświetlenie kopułkowe i płaskie oświetlenie rozproszone to nie tylko eleganckie dodatki – to rewolucja w systemach wizyjnych. Zalewając obiekt miękkim, wielokątowym światłem, technologie te rozwiązują problemy z widocznością, które wprawiłyby tradycyjne aparaty w cyfrowy szał.

Niezależnie od tego, czy inspekcjonujesz maleńkie płytki drukowane, czy masywne części samochodowe, oświetlenie rozproszone gwarantuje, że Twój robot zobaczy wszystko z chirurgiczną precyzją. Koniec z domysłami, koniec z pomijanymi defektami – tylko czysta, niezakłócona przejrzystość obrazu.

Bezpośrednie oświetlenie powierzchni

Gdy systemy wizyjne robotów potrzebują niezwykle ostrego obrazu, bezpośrednie oświetlenie powierzchni wchodzi na scenę niczym ninja oświetlenia gotowy przebić się przez szum wizualny.

To w zasadzie superbohater wizji maszynowej, który oświetla powierzchnie światłem, ujawniając każdy, nawet mikroskopijny szczegół. Chcesz uchwycić tę drobną rysę na płytce drukowanej? Ta technika Ci pomoże.

Strategiczne rozmieszczenie świateł — często pod kątem 90 stopni — pozwala uwydatnić niedoskonałości, które normalnie pozostałyby ukryte w cieniu.

Można to porównać do oświetlenia kryminalistycznego maszyn: oświetlenie o wysokim kontraście i bez zbędnych dodatków, które zmienia niewyraźne kształty w precyzyjne punkty danych.

Idealne do kontroli jakości, montażu robotów i dbania o to, by każda wyprodukowana część spełniała specyfikacje. Kto by pomyślał, że światło może być tak precyzyjnym detektywem?

Szczegóły obiektu podświetlanego

Trzy kluczowe składniki sprawiają, że podświetlenie jest tajną bronią w wizji robota: czysty kontrast, precyzyjne sylwetki i detekcja bez zbędnych ceregieli. Ta technika oświetlenia zmienia wizję Twojego robota w superbohatera o mocy promieni rentgenowskich:

- Natychmiastowe wykrywanie obiektów poprzez tworzenie wyraźnych czarno-białych konturów

- Pomiar wymiarów zewnętrznych z precyzją chirurgiczną

- Rozpoznawanie obecności lub braku obiektu szybciej, niż mrugniesz

- Ujawnianie ukrytych struktur wewnętrznych poprzez różnicową penetrację światła

Chcesz wiedzieć, co jest w tym najfajniejsze? Podświetlenie nie zwraca uwagi na szczegóły powierzchni – liczy się tylko ogólny obraz.

Umieszczając światła za obiektami i rejestrując ich sylwetki, zasadniczo dajesz swojemu systemowi wizyjnemu robota serum prawdy. Usuwa ono złożoność, pozostawiając jedynie czysty, nieskażony kształt i wymiar.

Kto potrzebuje wymyślnych sztuczek fotograficznych, kiedy można patrzeć na rzeczy na wylot — dosłownie?

Interpretacja danych wizualnych

Jak roboty faktycznie „widzą” otaczający je świat? To tak, jakby dać maszynom mózg i gałki oczne, ale o wiele fajniejsze. Przetwarzają dane wizualne za pomocą złożonych algorytmów, które rozkładają obrazy na proste informacje.

Najpierw kamery i czujniki zbierają surowe dane wizualne, a następnie do pracy przystępuje zaawansowane oprogramowanie – filtrując szumy, wykrywając krawędzie i segmentując sceny szybciej, niż mrugniesz okiem. Modele głębokiego uczenia rozpoznają obiekty z niesamowitą dokładnością, przekształcając piksele w wartościowe spostrzeżenia.

Wyobraź sobie, że trenujesz nadludzkiego detektywa, który nigdy się nie męczy. Magia dzieje się, gdy te systemy potrafią zidentyfikować krzesło, zmierzyć jego odległość, zrozumieć jego kontekst i zdecydować, co dalej – wszystko w milisekundach.

Zasadniczo, widzenie robotów przekształca bezsensowne dane wizualne w użyteczną inteligencję, która pomaga maszynom poruszać się po świecie i wchodzić z nim w interakcje.

Algorytmy oprogramowania w wizji robotów

Ponieważ roboty nie mają oczu, tak jak my, polegają na niesamowitych algorytmach programowych, które przekształcają surowe dane wizualne w wartościowe informacje.

Te cyfrowe systemy wizyjne przekształcają piksele w potężne percepcje dzięki sprytnym sztuczkom obliczeniowym:

- Filtrowanie szumu:Filtry Gaussa i medianowe usuwają zakłócenia wizualne, dzięki czemu obrazy stają się krystalicznie czyste.

- Znajdowanie granic:Algorytmy wykrywania krawędzi śledzą kontury obiektów niczym roboty-eksperci ds. kryminalistyki.

- Uczenie się na przykładach:Sieci neuronowe konwolucyjne pochłaniają zbiory danych obrazowych i rozpoznają złożone wzorce szybciej, niż człowiek może mrugnąć.

- Zrozumienie kontekstu:Segmentacja semantyczna oznacza każdy piksel, zapewniając robotom szczegółową mapę sceny.

Można wyobrazić sobie te algorytmy jako mózg-oczy robota, które przekształcają wizualny chaos w użyteczną inteligencję.

Nie tylko widzą, ale też interpretują, analizują i podejmują decyzje w ułamku sekundy, przy których ludzka percepcja wyglądałaby jak powtórka w zwolnionym tempie.

Integracja z systemami sterowania robotami

Pewnie zastanawiałeś się kiedyś, w jaki sposób roboty tak naprawdę „widzą” i nadają sens otaczającemu je światu. Wszystko to jest możliwe dzięki zabójczym protokołom komunikacyjnym i błyskawicznemu przetwarzaniu obrazu.

Gdy kamery i czujniki zaczynają komunikować się z systemami sterowania robotami za pośrednictwem szybkich sieci, w zasadzie tworzą układ nerwowy działający w czasie rzeczywistym, który pozwala maszynom reagować szybciej, niż człowiek mrugnie.

Można to porównać do wyposażenia robota w supernowoczesny zestaw oczu, który może błyskawicznie przekształcić dane wizualne w precyzyjne ruchy, zmieniając to, co kiedyś było fantastyką naukową, w dzisiejszą przemysłową rzeczywistość. Technologie łączenia czujników umożliwiają robotom integrację wielu strumieni danych, tworząc kompleksowe zrozumienie otoczenia wykraczające poza tradycyjną percepcję wizualną.

Protokoły komunikacji danych

Kiedy roboty zaczynają ze sobą rozmawiać, potrzebują wspólnego języka — i tu właśnie pojawiają się protokoły komunikacji danych.

Te cyfrowe translatory zapewniają płynne działanie systemów wizyjnych robotów w środowiskach przemysłowych. Oto dlaczego są tak ważne:

- Protokoły określają sposób, w jaki maszyny wymieniają informacje – od danych z czujników po precyzyjne polecenia dotyczące ruchu.

- Różne metody komunikacji (Ethernet, szeregowa, bezprzewodowa) zaspokajają specyficzne potrzeby robotyki.

- Wydajność w czasie rzeczywistym zależy od wyboru właściwego protokołu.

- Zgodność decyduje o tym, czy system wizyjny Twojego robota będzie działał, czy stanie się kosztownym przyciskiem do papieru.

EtherNet/IP i EtherCAT królują, umożliwiając błyskawiczne przesyłanie danych między systemami wizyjnymi i sterownikami robotów.

Można je postrzegać jako uniwersalne tłumacze świata automatyzacji — pomagające maszynom w płynnej komunikacji i unikaniu nieporozumień, które mogłyby zamienić precyzyjne zadanie w mechaniczną komedię błędów.

Przetwarzanie wizji w czasie rzeczywistym

Protokoły komunikacji danych wyznaczają kierunek rozwoju, ale to przetwarzanie obrazu w czasie rzeczywistym sprawia, że roboty naprawdę ożywają.

Wyobraź sobie robota, który nie tylko ślepo wykonuje instrukcje, ale naprawdę widzi i rozumie swoje otoczenie. Te systemy przekształcają percepcję robota ze sztywnego programowania w dynamiczną interakcję.

Kamery i czujniki o dużej prędkości rejestrują szczegóły w ułamku sekundy, przekształcając informacje o świecie fizycznym w użyteczne dane szybciej, niż mrugniesz okiem. Serwomechanizmy wizualne oznaczają, że roboty mogą teraz dostosowywać ruchy na bieżąco, bez polegania na wstępnie zaprogramowanych współrzędnych.

Nie są już po prostu maszynami; są to zdolne do adaptacji jednostki, które rozpoznają obiekty, wykrywają obecność człowieka i reagują z niesamowitą precyzją.

Można to sobie wyobrazić jako wyposażenie robotów w mózgi i oczy, które działają w idealnej synchronizacji – koniec z bezmyślną automatyzacją, a inteligentne maszyny świadome kontekstu, gotowe zrewolucjonizować sposób, w jaki wchodzimy w interakcje z technologią.

Nowe trendy w technologii widzenia maszynowego

W miarę jak technologia widzenia maszynowego pędzi naprzód niczym samochody sportowe bez ograniczeń prędkości, krajobraz percepcji wizualnej opartej na sztucznej inteligencji zmienia się szybciej, niż większość branż jest w stanie mrugnąć.

Gotowy zajrzeć w przyszłość? Sprawdź te oszałamiające trendy:

- Edge computing zapewni przetwarzanie obrazu w czasie rzeczywistym bezpośrednio na Twoich urządzeniach

- Algorytmy rekonstrukcji 3D pozwolą na stworzenie cyfrowych bliźniaków przestrzeni fizycznych

- Specjalistyczne czujniki będą widzieć poza ludzkimi ograniczeniami wzrokowymi

- Sztuczna inteligencja wygeneruje syntetyczne zestawy danych szkoleniowych, co znacznie usprawni uczenie maszynowe

Wyobraź sobie roboty, które potrafią postrzegać głębię, analizować złożone środowiska i podejmować decyzje w ułamku sekundy, nie wydając przy tym ani krzty wysiłku.

Nie mówimy tu tylko o drobnych usprawnieniach – mamy do czynienia z całkowitą rewolucją w sposobie, w jaki maszyny rozumieją informacje wizualne.

Przyszłość nie nadchodzi dopiero co; ona już zmienia nasz krajobraz technologiczny, piksel po pikselu.

Ludzie pytają także o roboty

Ile kosztuje podstawowy system wizyjny dla małych firm?

Podstawowe systemy wizyjne z wykorzystaniem robotów kosztują od 1,000 do 3,000 dolarów. Są więc idealne dla małych firm, którym zależy na podstawowych kontrolach jakości, odczycie kodów kreskowych i prostych pomiarach, bez rujnowania budżetu.

Czy systemy wizyjne robotów mogą działać efektywnie w warunkach słabego oświetlenia lub w trudnych warunkach?

Będziesz widzieć wyraźnie, szybko się adaptować i postrzegać dogłębnie. Robotyczne systemy wizyjne o słabym oświetleniu mogą skutecznie poruszać się w trudnych warunkach dzięki zaawansowanym czujnikom, specjalistycznym kamerom i innowacyjnym technologiom, które poprawiają jakość obrazu w warunkach słabego oświetlenia.

Jakie umiejętności programistyczne są potrzebne do tworzenia i utrzymywania systemów wizyjnych?

Będziesz potrzebować Pythona dla wszechstronności, C++ dla wydajności i OpenCV do przetwarzania obrazu. Opanuj techniki uczenia maszynowego, zrozum sieci neuronowe i rozwiń solidne umiejętności w zakresie ROS, aby skutecznie tworzyć i utrzymywać solidne systemy wizyjne robotów.

Jak dokładne są systemy wizyjne robotów w porównaniu z ludzką percepcją wizualną?

Podobnie jak jastrząb wypatrujący ofiary, robotyczne systemy wizyjne potrafią być niezwykle precyzyjne, często osiągając niemal idealną dokładność w zadaniach o określonej strukturze. Przekonasz się, że przewyższają ludzi pod względem szybkości, spójności i wykrywania drobnych defektów w różnych zastosowaniach przemysłowych.

Czy różne systemy wizyjne robotów wymagają specjalistycznego szkolenia operatorów?

Tak, będziesz potrzebować specjalistycznego szkolenia z różnych systemów wizyjnych robotów. Mają one unikalny sprzęt, oprogramowanie i aplikacje. Programy certyfikacyjne i kursy dedykowane konkretnym producentom pomogą Ci opanować konkretne umiejętności i wiedzę wymagane dla każdego systemu.

Dlaczego to ma znaczenie w robotyce

Robotyczne widzenie to już nie tylko science fiction – to dzieje się już teraz. Do 2025 roku rynek systemów wizyjnych osiągnie wartość 14.4 miliarda dolarów, co dowodzi, że te inteligentne oczy to nie tylko chwilowy trend. Jesteśmy świadkami rewolucji technologicznej, w której maszyny mogą dosłownie widzieć i rozumieć swoje otoczenie. Od produkcji po opiekę zdrowotną, robotyczne widzenie zmienia sposób, w jaki wchodzimy w interakcje z technologią. Chcesz być na bieżąco? Ucz się, bądź ciekawy świata i dołącz do rewolucji w dziedzinie inteligencji wizualnej.

Referencje

- https://robotsdoneright.com/Articles/components-of-a-robotic-vision-system.html

- https://www.borunte.net/info/what-are-the-general-components-of-a-simple-ro-84696243.html

- https://recognitionrobotics.com/what-are-robotic-vision-systems/

- https://www.loopr.ai/blogs/understanding-the-key-components-of-machine-vision-systems

- https://www.baslerweb.com/en-us/learning/components-vision-system/

- https://www.tencentcloud.com/techpedia/105783

- https://www.tdipacksys.com/blog/principles-of-vision-inspection-system/

- https://www.borunte.net/info/detailed-introduction-to-the-working-principle-81967228.html

- https://lewisgroup.uta.edu/ee5325/lectures99/vision.pdf

- https://www.augmentus.tech/blog/what-is-robot-vision-system/

Poznaj rodziny robotów odpowiadające temu przypadkowi użycia.

Unitree Go2

Poznaj Unitree Go2 — robota-psa, który chodzi, biega, skacze i tańczy. Mapuje swoje otoczenie…

Unitree R1

Lżejszy, bardziej przystępny robot humanoidalny do zastosowań w treściach, aktywacjach, edukacji i pokazach dla publiczności. Najlepszy, gdy potrzebujesz silnego…

Przeglądaj roboty, porównuj modele i zarezerwuj odpowiedni bez konieczności kupowania.

Używaj Futurobotów, aby poruszać się szybciej, zachować elastyczność i uzyskać dostęp do zaawansowanych robotów bez konieczności zakupu.