Stellen Sie sich Roboter wie neugierige Kinder vor, die die Welt mit Hightech-Augen erkunden. Sie nutzen Kameras und Sensoren, um ihre Umgebung wie digitale Detektive zu erfassen, zu analysieren und zu verstehen. Maschinelles Lernen hilft ihnen, Objekte zu erkennen, Bewegungen vorherzusagen und Räume in Echtzeit zu kartieren. Von Fabrikhallen bis hin zu Gefahrenbereichen – diese mechanischen Gehirne wandeln Rohdaten in intelligente Entscheidungen um. Wollen Sie sehen, wie tief die Welt der Robotik reicht?

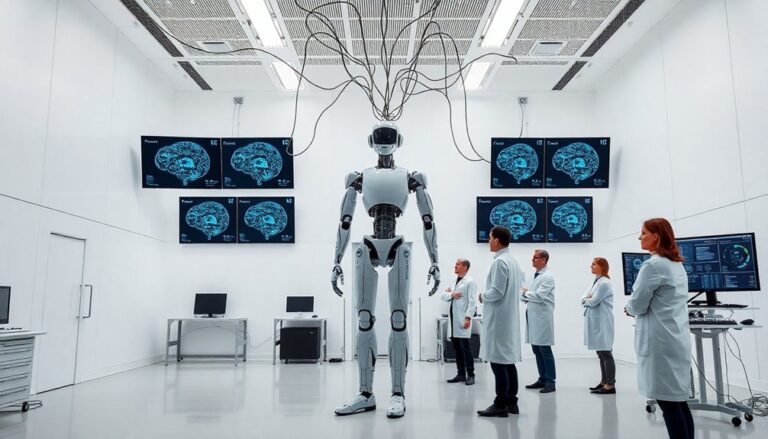

Was ist Roboterwahrnehmung?

Vision Quest: Robot Style.

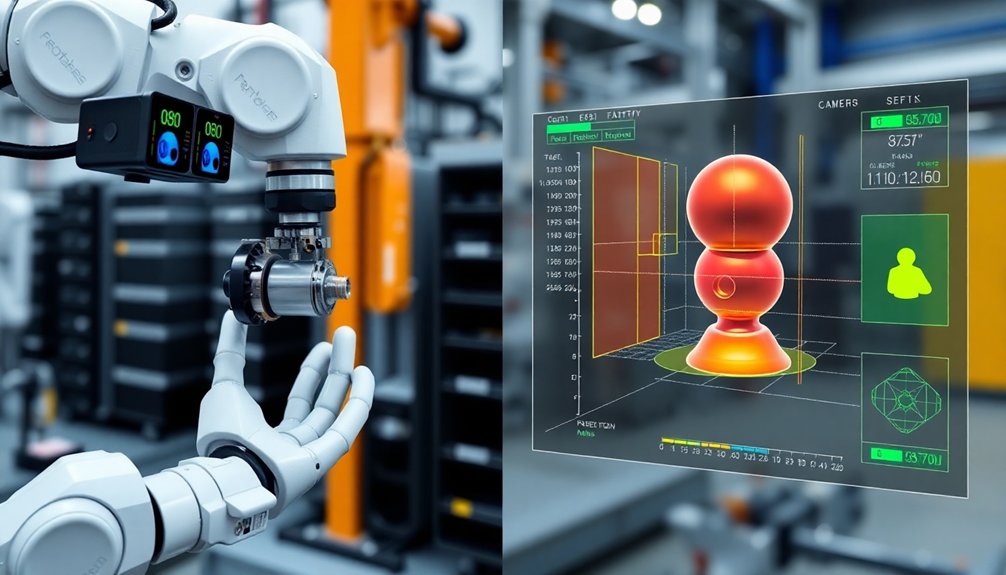

Haben Sie sich jemals gefragt, wie Roboter die Welt eigentlich „sehen“? Roboterwahrnehmung bedeutet im Grunde, Maschinen Augen und ein Gehirn zu geben, damit sie verstehen, was sie sehen. Es ist, als würde man einem Computer beibringen, Objekte so zu erkennen wie Menschen, nur viel präziser.

Mithilfe von Objekterkennungsalgorithmen können Roboter heute eine Kaffeetasse, einen Schraubenschlüssel oder einen winzigen Herstellungsfehler schneller erkennen, als man blinzeln kann.

Einheitsbaum Go2

Lernen Sie den Unitree Go2 kennen – einen Roboterhund, der geht, rennt, springt und tanzt. Er kartiert seine Umgebung…

Digitalkameras und intelligentes maschinelles Lernen sind der Schlüssel zum Erfolg. Diese Roboter erfassen nicht nur Bilder, sondern analysieren sie auch und lernen und verbessern sich mit jeder Aufnahme.

Sensortechnologien Roboter von einfachen Maschinen in intelligente Wesen verwandeln, die in der Lage sind, ihre Umgebung mit bemerkenswerter Raffinesse wahrzunehmen und zu interpretieren.

Man kann es sich wie das Training eines superintelligenten digitalen Assistenten vorstellen, der mit jeder Erkundung seiner Umgebung besser wird. Faszinierend, oder? Roboter entwickeln sich quasi zu visuellen Genies und verändern so unsere Interaktion mit Technologie.

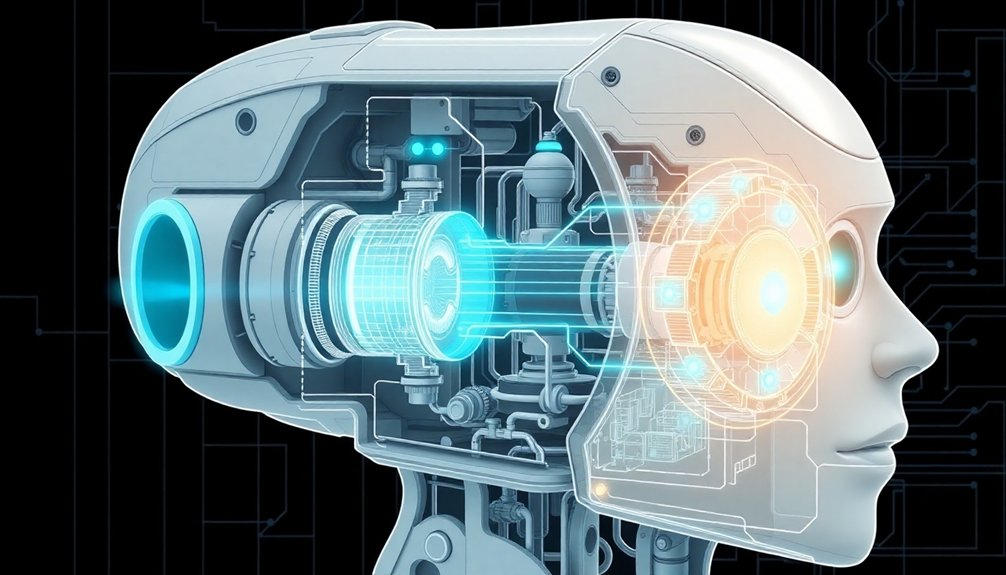

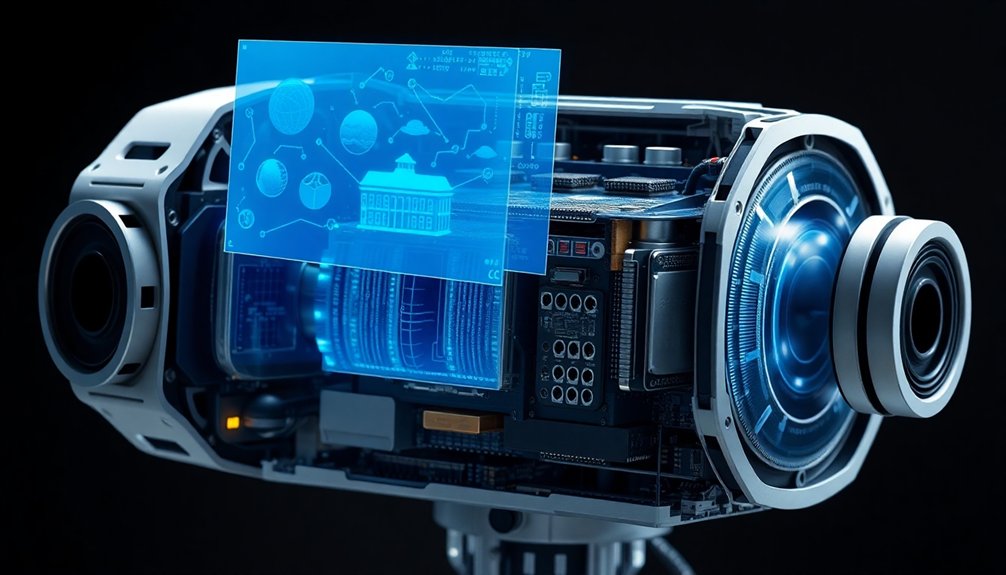

Die Augen eines Roboters: Kamera- und Sensortechnologien

Wenn man denkt, dass Roboter die Welt sehen, stellt man sich ihre Hightech-Kamerasysteme vor, die die Umgebung wie digitale Detektive abtasten und visuelle Hinweise zusammensetzen.

Diese robotischen „Augen“ sind nicht nur passive Kameras, sondern intelligente Sensoren, die Bilder mithilfe komplexer Algorithmen des maschinellen Lernens verarbeiten und so rohe visuelle Daten in ein aussagekräftiges räumliches Verständnis umwandeln.

Unitree G1

Ein hochwertiger humanoider Roboter für anspruchsvolle Demos, Events, Schulungen und fortgeschrittene Interaktion. Ideal, wenn Sie einen leistungsstärkeren Roboter benötigen…

So wie Menschen auf Tiefenwahrnehmung und Mustererkennung angewiesen sind, nutzen moderne Roboter stereoskopische Kameras und hochentwickelte Software, um ihre Umgebung mit zunehmender Präzision und Anpassungsfähigkeit zu interpretieren.

Gyroskope und Beschleunigungsmesser Die Roboterwahrnehmung wird um eine zusätzliche Dimension erweitert, wodurch eine Echtzeit-3D-Umgebungskartierung ermöglicht wird, die über herkömmliche visuelle Eingaben hinausgeht.

Grundlagen der Kamerasicht

Die Augen sind die Fenster zur Seele eines Roboters – oder zumindest zu seinem Verständnis der Welt. Computer Vision ist keine Zauberei, sondern ein fein abgestimmtes Zusammenspiel von Kameras und intelligenter Software. Bildverarbeitungssysteme wandeln visuelle Rohdaten in aussagekräftige Erkenntnisse um und ermöglichen es Robotern, mehr als nur Pixel zu sehen. Humanoide Robotertechnologien Nutzung fortschrittlicher Sensorsysteme zur Verbesserung der Wahrnehmungs- und Entscheidungsfähigkeit.

- Digitalkameras erfassen Farbe und Tiefe und schaffen so ein umfassendes Verständnis des Raumes.

- Maschinelle Lernalgorithmen dekodieren komplexe visuelle Informationen in Millisekunden.

- Kontinuierliches Lernen hilft Robotern, ihre Wahrnehmung mit jeder Interaktion zu verfeinern.

Man kann sich Roboterkameras wie hochintelligente Kleinkinder vorstellen, die ständig dazulernen. Sie machen nicht einfach nur Fotos, sondern analysieren auch Textur, Form und Bewegung. Eine RGBD-Kamera sieht nicht nur eine Tasse, sondern erfasst deren Abmessungen, Farbe und genaue Position.

Mit jeder Interaktion werden diese mechanischen Augen schärfer und wandeln visuelle Rohdaten in verwertbare Informationen um. Wer hätte gedacht, dass Roboter so schnell lernen können?

Sensorische Wahrnehmungstechnologien

Roboter werden nicht mit perfekter Wahrnehmung geboren – sie werden so konstruiert, dass sie die Welt durch ein ausgeklügeltes Netzwerk von Sensoren wahrnehmen, das Science-Fiction-Fans vor Neid erblassen lassen würde.

Roboter-Visionsysteme funktionieren wie kybernetische Augen auf Steroiden: Sie nutzen Digitalkameras, um Umgebungsbilder schneller aufzunehmen, als man blinzeln kann. Maschinelles Lernen wandelt diese Rohbilder in aussagekräftige Daten um und ermöglicht es Robotern, Objekte anhand von Farbe, Form und Textur immer präziser zu erkennen.

Stereoskopisches Sehen verleiht Robotern Tiefenwahrnehmung und ermöglicht es ihnen, räumliche Beziehungen zu verstehen, ähnlich wie ein Falke seine Beute verfolgt.

Deep-Learning-Algorithmen helfen diesen künstlichen Gehirnen, sich kontinuierlich zu verbessern, Interaktionen zu protokollieren und Objektentfernungen mit verblüffender Genauigkeit vorherzusagen. Man kann es sich so vorstellen, als würde man einem Computer beibringen zu sehen – nicht nur zu schauen – und man beginnt zu verstehen, wie diese technologischen Wunder unser Verständnis von Wahrnehmung grundlegend verändern.

Neuronale Netze Diese robotischen Wahrnehmungssysteme sollen durch adaptives Lernen transformiert werden, wodurch Roboter in die Lage versetzt werden, hochdimensionale Eingaben mit zunehmend ausgefeilten Entscheidungsfähigkeiten zu verarbeiten.

Verarbeitung visueller Informationen: Wie Maschinen Bilder verstehen

Digitalkameras haben die Wahrnehmung der Welt durch Maschinen revolutioniert und visuelle Rohdaten in eine hochentwickelte Sprache des Verstehens verwandelt. Deep-Learning-Algorithmen ermöglichen es Robotern heute, Objekte mit verblüffender Präzision zu erkennen. Humanoide Roboter Sie nutzen zunehmend fortschrittliche visuelle Wahrnehmungstechniken, um intelligenter mit ihrer Umwelt zu interagieren.

Ihr Roboterfreund betrachtet die Welt durch die Linse intelligenter Informationsverarbeitung:

- Extrahieren von Farb-, Form- und Texturdetails aus jedem Pixel

- Erstellung räumlicher Karten zur Entschlüsselung komplexer Umgebungen

- Kontinuierliches Lernen und Anpassen durch maschinelle Intelligenz

Stellen Sie sich einen Roboter vor, der mit jedem aufgenommenen Bild intelligenter wird – er analysiert die Tiefe, verfolgt Bewegungen und klassifiziert Objekte schneller, als Sie blinzeln können.

Ein mechanischer Verstand, der die Realität entschlüsselt und mit jedem Pixel visueller Daten lernt und sich weiterentwickelt.

Stereoskopisches Sehen hilft diesen mechanischen Gehirnen, räumliche Beziehungen zu begreifen und verwandelt so einstige Science-Fiction in die heutige technologische Realität. Sie sehen nicht nur, sondern verstehen, verarbeiten und lernen in Echtzeit.

Maschinelles Lernen und adaptive Bildverarbeitungssysteme

Maschinelles Lernen wandelt die Robotervision von starren, programmierten Reaktionen in ein dynamisches, sich selbst verbesserndes System um.

Stellen Sie sich Roboter vor, die wie neugierige Kinder lernen, Fotos machen und mit jeder Interaktion intelligenter werden. Computer Vision bedeutet nicht mehr nur Sehen – es geht ums Verstehen.

Indem man Roboter mit beschrifteten Bildern trainiert, bringt man ihnen im Grunde eine visuelle Sprache bei. Sie werden Objekte erkennen, sich in Räumen bewegen und sich schneller an neue Umgebungen anpassen, als man erwarten würde.

Selbstüberwachte Lernverfahren ermöglichen es Robotern, die Tiefe anhand einzelner Bilder abzuschätzen und so visuelle Rohdaten in räumliche Intelligenz umzuwandeln.

Die Magie entsteht durch kontinuierliche Belichtung: Vielfältigere Bilder bedeuten präzisere Algorithmen. Ihr Roboter sieht die Welt nicht nur – er lernt ihre Nuancen, sagt Bewegungen voraus und erstellt eine ständig wachsende mentale Karte seiner Umgebung.

Ziemlich cool, oder?

Objekterkennung und -klassifizierung

Wenn künstliche Intelligenz Detektivarbeit leistet, wird die Objekterkennung zu ihrer Lupe. Roboter sehen nicht nur – sie analysieren, klassifizieren und verstehen die Welt mithilfe ausgefeilter Bildverarbeitungstechniken, die selbst Sherlock Holmes neidisch machen würden.

- Deep-Learning-Modelle können Fertigungsfehler schneller erkennen als das menschliche Auge und verwandeln Roboter in Präzisionsinspektionsmaschinen.

- Stereoskopisches Sehen hilft Robotern, wie winzige, unermüdliche Vermesser, Tiefen und räumliche Beziehungen einzuschätzen.

- Die Selbstannotation ermöglicht es Robotern, ihre Fähigkeiten zur Objektklassifizierung autonom zu erlernen und zu verbessern, ohne dass ständig menschliche Hilfe benötigt wird.

Maschinelle Lernalgorithmen wandeln Rohbilder in aussagekräftige Daten um und lehren Roboter, Objekte anhand von Farbe, Form, Textur und Ausrichtung zu erkennen.

Es ist, als würde man Computern ein Gehirn geben, das sofort zwischen einem Schraubenschlüssel und einer Banane unterscheiden kann – nicht nur durch Hinsehen, sondern indem es wirklich versteht, was es sieht.

Tiefenwahrnehmung und räumliches Bewusstsein

Sie haben sich wahrscheinlich schon einmal gefragt, wie Roboter die Welt um sich herum eigentlich „sehen“, oder?

Die Tiefenmessung mittels Kameras ermöglicht es Robotern, Entfernungen zu messen und dreidimensionale Räume wie Menschen zu verstehen, indem sie Tricks wie stereoskopisches Sehen und Bewegungsverfolgung nutzen, die ihr räumliches Bewusstsein unheimlich präzise machen.

Kamera-Tiefenmessung

Augen sind die Fenster zum Verstehen – und für Roboter sind Kameras ihre digitalen Hornhäute. Die Tiefensensorik der Kameras verwandelt flache Bilder mithilfe ausgeklügelter Computertechnologie in detailreiche, dreidimensionale Landschaften. Roboter sehen nicht nur, sondern entschlüsseln räumliche Beziehungen mit bemerkenswerter Präzision.

- Stereoskopisches Sehen ahmt das menschliche Auge nach und berechnet Entfernungen durch den Vergleich zweier Kameraperspektiven.

- Tiefenschätzungsalgorithmen sagen die Pixeltiefe aus einzelnen RGB-Bildern voraus.

- Bewegungsbasierte Verfahren erfassen Szenenveränderungen, um Objektentfernungen abzuleiten.

Man kann es sich wie robotische Superkräfte vorstellen: Sie verwandeln zweidimensionale Momentaufnahmen in immersive 3D-Karten. Diese Systeme lernen, visuelle Daten schneller zu interpretieren, als man blinzeln kann, indem sie hochentwickelte Algorithmen nutzen, die Entfernungen und räumliche Beziehungen mit erstaunlicher Genauigkeit vorhersagen.

Wer braucht schon biologische Augen, wenn man über hochmoderne maschinelle Wahrnehmung verfügt?

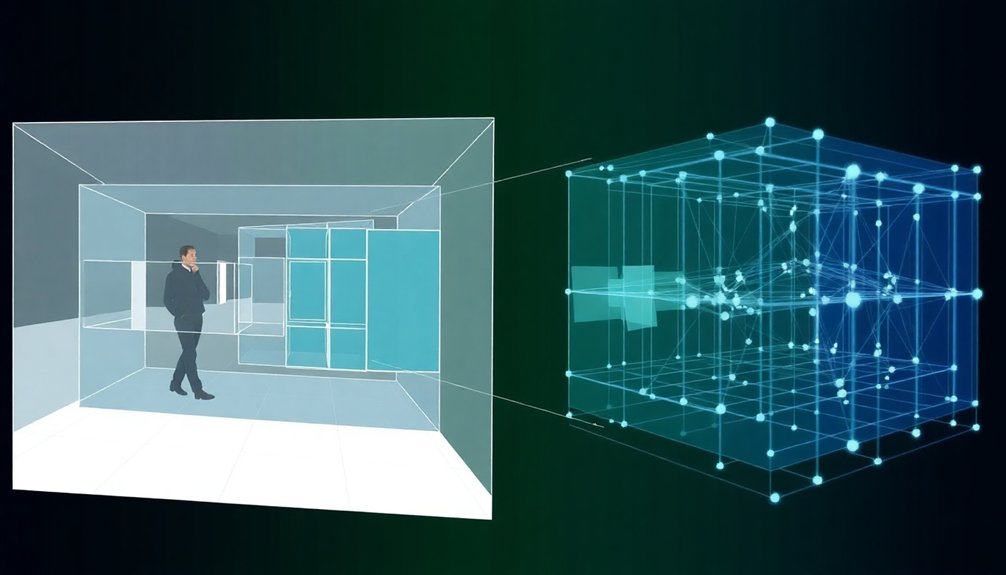

3D-Szenenverständnis

Da die Tiefenwahrnehmung die Geheimzutat des Roboters für das Manövrieren in komplexen Umgebungen ist, verwandelt das Verständnis von 3D-Szenen die mechanische Sehfähigkeit von bloßer Bildaufnahme in echte räumliche Intelligenz.

Roboter sehen nicht mehr nur – sie begreifen.

Tiefenschätzungstechniken wie stereoskopisches Sehen und selbstüberwachtes Lernen ermöglichen es Maschinen, Entfernungen auf Pixelebene aus einzelnen RGB-Bildern vorherzusagen.

Stellen Sie sich einen Roboter vor, der einen Raum analysiert und sofort weiß, wie weit jedes Objekt von seinen Sensoren entfernt ist.

Die semantische Segmentierung steigert diese Fähigkeit enorm und ermöglicht es Robotern, ganze 3D-Umgebungen in Echtzeit zu rekonstruieren.

Anwendungsbeispiele für Robotervision in der Praxis

Roboter klingen vielleicht nach Science-Fiction, doch ihre Bildverarbeitungssysteme revolutionieren bereits die Art und Weise, wie wir branchenübergreifend reale Herausforderungen meistern. Robotervision ist nicht nur faszinierende Technologie – sie verändert unsere Arbeitsweise, unser Recycling und unsere Sicherheit grundlegend.

- In der Fertigung erkennen mobile Manipulationsroboter mikroskopische Produktfehler schneller als das menschliche Auge.

- Lagerroboter nutzen Bildverarbeitungssysteme, um den Lagerbestand mit laserähnlicher Präzision zu erfassen.

- Gefahrenbereichsinspektionen finden nun statt, ohne Menschenleben zu gefährden.

Man stelle sich das vor: Diese mechanischen „Augen“ können sehen, was wir nicht sehen können. Sie sortieren Abfall, montieren empfindliche Elektronik und kriechen durch gefährliche Rohre – und machen dabei unsere Welt effizienter.

Robotervision: Mechanische Augen erweitern die menschlichen Fähigkeiten über traditionelle Grenzen hinaus und verwandeln unmögliche Aufgaben in präzise und effiziente Lösungen.

Robotervision ersetzt den Menschen nicht; sie erweitert unsere Fähigkeiten auf eine Weise, die wir erst allmählich verstehen. Wer wünscht sich nicht einen unermüdlichen, hochpräzisen mechanischen Partner?

Navigieren in komplexen Umgebungen

Sie haben sich sicher schon gefragt, wie Roboter es schaffen, sich in unübersichtlichen, unvorhersehbaren Umgebungen zurechtzufinden, ohne wie ein betrunkener Autoscooter gegen alles zu stoßen. Ihre Geheimwaffe? Hochintelligente Sensoren, die es ihnen ermöglichen, Umgebungen in Echtzeit zu kartieren. Mithilfe von Tiefenkameras und KI-Algorithmen verwandeln sie komplexe Räume quasi in überschaubare Navigationsaufgaben.

Man kann es sich wie ein Videospiel vorstellen, in dem der Roboter ständig seine mentale Karte aktualisiert, potenzielle Hindernisse vorhersieht und den reibungslosesten Weg nach vorn plant – und das alles, während er in Sekundenbruchteilen Entscheidungen trifft, die einen menschlichen Fahrer wie einen Amateur aussehen lassen würden.

Robotersensorik

Die sensorischen Superkräfte moderner Roboter lassen James Bonds Gadgets wie Kinderspiel aussehen.

Robotervisionssysteme haben die Art und Weise, wie Maschinen ihre Welt wahrnehmen, revolutioniert und die Objekterkennung zu einer Kunstform erhoben. Diese Hightech-Augen schauen nicht nur – sie verstehen.

- Kameras erfassen komplexe Umgebungsdetails mit Millisekundenpräzision.

- Maschinelle Lernalgorithmen verbessern kontinuierlich das räumliche Vorstellungsvermögen.

- Stereoskopische Systeme bieten eine Tiefenwahrnehmung, die mit dem menschlichen Sehvermögen vergleichbar ist.

Man stelle sich das vor: Roboter können sich heute in komplexen Umgebungen bewegen, Hindernissen ausweichen und mit ihrer Umgebung auf eine Weise interagieren, die wir einst für unmöglich hielten.

Ihre Sensorfähigkeiten sind nicht nur beeindruckend – sie verändern die Art und Weise, wie Maschinen die Welt um sich herum verstehen und mit ihr interagieren.

Von Industrierobotern bis hin zu autonomen Fahrzeugen – diese technologischen Wunderwerke schreiben die Regeln der Wahrnehmung neu, Pixel für Pixel.

Dynamische Weltraumnavigation

Stellen Sie sich einen Roboter vor, der durch ein überfülltes Lagerhaus tanzt, ohne gegen ein einziges Regal zu stoßen – das ist dynamische Raumnavigation in Aktion. Es ist, als ob man Robotern ein Gehirn gäbe, mit dem sie sich in chaotischen Umgebungen bewegen können, ohne Chaos anzurichten.

Mithilfe von Algorithmen des maschinellen Lernens werden diese mechanischen Transportsysteme immer intelligenter in der Objekterkennung, der Vorhersage von Hindernissen und der Planung optimaler Routen. Sie nutzen ausgefeilte Verfahren wie SLAM zur Erstellung von Echtzeitkarten und Tiefenwahrnehmungskameras, die ihnen helfen, räumliche Beziehungen zu verstehen.

Aber jetzt kommt der Clou: Roboter vermeiden nicht nur Kollisionen – sie lernen soziale Interaktionsmuster. Sie ahmen menschliches Verhalten nach und verstehen die ungeschriebenen Regeln gemeinsam genutzter Räume.

Man könnte sie als digitale Choreografen bezeichnen, die sich mit kalkulierter Eleganz und Präzision ständig an unvorhersehbare Umgebungen anpassen. Wer sagt denn, dass Roboter nicht wendig sein können?

Herausforderungen in der Roboterwahrnehmung

Wenn Roboter versuchen, sich in unserer unübersichtlichen, unvorhersehbaren Welt zurechtzufinden, stehen sie oft vor einem Wahrnehmungsproblem, das kniffliger ist als ein Jenga-Spiel mit verbundenen Augen.

Objekterkennung und Tiefenschätzung stellen für diese mechanischen Entdecker knifflige Rätsel dar. Sie haben Schwierigkeiten, sich in unstrukturierten Umgebungen zurechtzufinden, wo herkömmliche Bildverarbeitungssysteme versagen.

Roboter meistern komplexe Herausforderungen:

Visuelle Komplexität meistern: Roboter entschlüsseln räumliche Rätsel durch algorithmische Raffinesse und persistentes maschinelles Lernen.

- Interpretation räumlicher Beziehungen ohne präzise Messungen

- Lernen aus minimalen gelabelten Daten durch selbstüberwachte Techniken

- Behebung von Fehlern bei der Posenerkennung und den Begrenzungsboxen

Stellen Sie sich vor, Sie versuchen, mit Boxhandschuhen nach einer Kaffeetasse zu greifen – das ist im Grunde die Wahrnehmungserfahrung eines Roboters.

Ihre Bildverarbeitungssysteme arbeiten ständig daran, visuelle Informationen in Echtzeit zu entschlüsseln. Die Kluft zwischen robotergestützter Wahrnehmung und menschlicher Intuition ist nach wie vor groß, doch es werden Fortschritte erzielt – Algorithmus für Algorithmus.

Industrielle und kommerzielle Auswirkungen von Bildverarbeitungssystemen

Robotervisionssysteme sind nicht nur Science-Fiction-Schmankerl – sie verändern die Industrielandschaft schneller, als man „Automatisierungsrevolution“ sagen kann. Während Hersteller früher auf menschliche Augen für die Qualitätskontrolle angewiesen waren, ermöglichen modernste Bildverarbeitungstechnologien Robotersystemen heute, Produkte mit übermenschlicher Präzision zu prüfen, zu sortieren und zu validieren.

| Anwendung | Auswirkungen |

|---|---|

| Industrie | Reduziert Fehler um 80 % |

| Lagerung | Steigert die Effizienz um 60 % |

| Montage | Verbessert die Präzision erheblich |

| Inventar | Reduziert die Betriebskosten |

Kleine Unternehmen konkurrieren heute mit Großkonzernen, indem sie kostengünstige Roboter-Vision-Technologie nutzen. Von Inspektionen in Gefahrenbereichen bis hin zu komplexen Montageaufgaben – diese Systeme sind nicht nur Werkzeuge, sondern revolutionieren die Arbeitswelt. Sie erleben eine technologische Metamorphose, in der Roboter sehen, lernen und mit einer Präzision arbeiten, die menschliche Arbeitskräfte wie ungeschickte Amateure erscheinen lässt. Willkommen in der Zukunft, in der Maschinen nicht nur arbeiten – sie wahrnehmen.

Die Zukunft der robotischen Sensorik und Interpretation

Die mechanische Präzision von Industrierobotern steht kurz vor einem bedeutenden Intelligenz-Upgrade. Da die Herausforderungen der Robotik die Grenzen der Wahrnehmung immer weiter verschieben, entwickeln sich Maschinen von blinden Muskeln zu sehenden, denkenden Einheiten. Sie lernen, komplexe Umgebungen mit verblüffend hoher Genauigkeit zu interpretieren.

- Tiefenschätzungsverfahren ermöglichen es Robotern nun, dreidimensional zu „sehen“ und einzelne Bilder in ein räumliches Verständnis umzuwandeln.

- Maschinelle Lernalgorithmen ermöglichen kontinuierliche Verbesserungen der Objekterkennung und machen Roboter mit jeder Interaktion intelligenter.

- Moderne Computer Vision wandelt visuelle Rohdaten in aussagekräftige Erkenntnisse über die Umwelt um.

Stellen Sie sich einen Roboter vor, der Objekte nicht nur bewegt, sondern sie auch versteht. Er speichert Erfahrungen, passt sich blitzschnell an und trifft Entscheidungen in Windeseile.

Die Zukunft besteht nicht darin, den Menschen zu ersetzen, sondern darin, mechanische Partner zu erschaffen, die die Welt fast genauso umfassend wahrnehmen wie wir. Möchten Sie einen Blick in die Zukunft werfen? Diese Sensorsysteme sind Ihre Kristallkugel.

Die Leute fragen auch nach Robotern.

Wie nehmen Roboter die Welt wahr?

Sie werden die Welt durch ausgeklügelte Kamerasysteme und fortschrittliche Bildverarbeitungsalgorithmen wahrnehmen, die Objekte erkennen, die Tiefe analysieren und kontinuierlich aus Interaktionen mit der Umgebung lernen, was eine präzise Navigation und intelligente Entscheidungsfindung ermöglicht.

Wie fange ich als Anfänger an, Robotik zu lernen?

Am besten beginnst du mit dem Erlernen der Grundlagen der Programmierung, erkundest Robotik-Bausätze wie Arduino, belegst Online-Kurse in Python und C++, übst mit Sensoren und schließst dich Robotik-Communities an, um praktische Erfahrungen zu sammeln und grundlegende Fähigkeiten aufzubauen.

Was ist Roboterwahrnehmung?

Stellen Sie sich einen Roboterarm vor, der defekte Autoteile am Fließband aussortiert. Die sogenannte Roboterwahrnehmung beschreibt, wie Maschinen mithilfe von Sensoren und künstlicher Intelligenz ihre Umgebung interpretieren, Objekte erkennen und in Echtzeit intelligente Entscheidungen treffen.

Welche 6 Schritte umfasst der Roboter-Designprozess?

Sie durchlaufen den Roboter-Designprozess anhand von sechs Schlüsselschritten: Definition des Problems, Recherche von Technologien, Konzeption des Designs, Entwicklung detaillierter Pläne, Erstellung von Prototypen und rigoroses Testen der Leistung und Fähigkeiten Ihres Roboters.

Warum das in der Robotik wichtig ist

Roboter sind im Grunde die ultimativen Nachahmer der Natur. Sie lernen zu sehen und zu verstehen, genau wie wir – nur eben mit Silizium statt Neuronen. Sie wandeln sich von klobigen Maschinen zu hochentwickelten Wahrnehmungssystemen, die sich schon bald so selbstverständlich in unserer Welt bewegen werden wie wir atmen. Denken Sie weniger an dystopische Science-Fiction-Szenarien, sondern vielmehr an intelligente Begleiter, die still und leise unsere Interaktion mit Technologie revolutionieren. In der Zukunft geht es nicht darum, den Menschen zu ersetzen, sondern darum, unsere Fähigkeiten auf eine Weise zu erweitern, die wir uns gerade erst vorstellen können.

Erkunden Sie die Roboterfamilien, die für diesen Anwendungsfall geeignet sind.

Einheitsbaum Go2

Lernen Sie den Unitree Go2 kennen – einen Roboterhund, der geht, rennt, springt und tanzt. Er kartiert seine Umgebung…

Unitree G1

Ein hochwertiger humanoider Roboter für anspruchsvolle Demos, Events, Schulungen und fortgeschrittene Interaktion. Ideal, wenn Sie einen leistungsstärkeren Roboter benötigen…

Stöbern Sie durch die Roboter, vergleichen Sie die Modelle und reservieren Sie den passenden, ohne ihn kaufen zu müssen.

Mit Futurobots bewegen Sie sich schneller, bleiben flexibel und erhalten Zugang zu fortschrittlichen Robotern, ohne diese kaufen zu müssen.