Diepgaande versterkingslering transformeert robots van logge machines in adaptieve leerlingen. Je ziet hoe AI humanoïde robots leert bewegen als atleten, door miljoenen scenario's te verwerken in digitale speelvelden. Ze zullen struikelen, leren en sneller verbeteren dan je je kunt voorstellen – denk aan een peuter op digitale steroïden. Neurale netwerken helpen robots bewegingspatronen te decoderen, waardoor complexe omgevingen veranderen in speelvelduitdagingen. Benieuwd hoe machines menselijke beperkingen kunnen overstijgen? Blijf kijken.

De fundamenten van diepgaand versterkingsleren

De robotrevolutie begint met een brein, niet alleen met metaal en circuits. Deep Reinforcement Learning is geen sciencefictionfantasie, maar de manier waarop machines leren denken als flexibele probleemoplossers. Algoritmen voor het leren van machines Verbeter het vermogen van de robot om sensorische input te verwerken en zijn leerstrategieën dynamisch aan te passen.

Stel je een robot voor die leert van zijn fouten, net zoals jij dat zou doen. Door neurale netwerken te combineren met trial-and-error-strategieën kunnen deze systemen door complexe omgevingen navigeren en in een fractie van een seconde beslissingen nemen. Ze volgen geen vooraf ingestelde instructies; ze ontwikkelen zich door ervaring.

De magie gebeurt wanneer algoritmes ruwe data omzetten in intelligente actie, waardoor robots hoogdimensionale input kunnen interpreteren en met opmerkelijke precisie kunnen reageren. Zie het als een machine leren om buiten de gebaande paden te denken, om mogelijkheden te zien die verder reiken dan lineaire programmering.

Unitre Go2

Maak kennis met de Unitree Go2 — een robothond die loopt, rent, springt en danst. Hij brengt zijn omgeving in kaart…

Het is alsof je een robot intuïtie geeft: het vermogen om te improviseren, te leren en ruw potentieel om te zetten in intelligent gedrag.

Neurale netwerken en robotische besluitvorming

Wanneer neurale netwerken en robotische besluitvorming samenkomen, gebeuren er wonderen – en we hebben het hier niet over sciencefictionfantasieën uit Hollywood.

Deze intelligente algoritmes transformeren robots van logge machines in adaptieve leerlingen. Door complexe omgevingen te modelleren met behulp van meerlaagse perceptrons en convolutionele neurale netwerken, kunnen robots nu ingewikkelde bewegingspatronen ontcijferen als een digitale choreograaf.

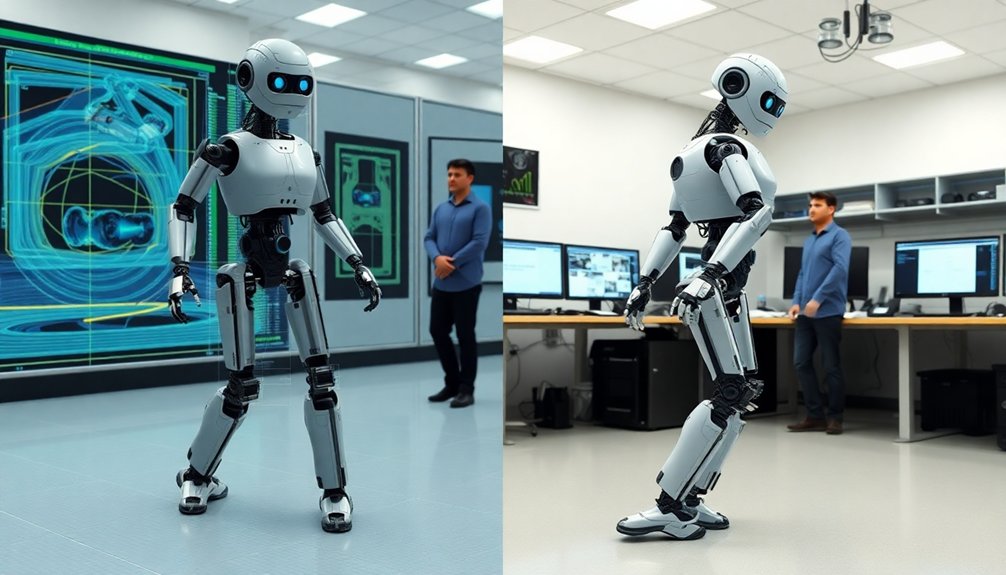

Stel je een humanoïde robot voor die leert lopen door te oefenen in zeer realistische simulaties, waarbij hij zijn aanpak bij elke onhandige stap aanpast. Mensachtige robotplatforms Ze integreren steeds vaker geavanceerde AI om met ongekende precisie door complexe omgevingen te navigeren.

Neurale netwerken helpen het niet alleen beweging te begrijpen, maar ook de context – het onderscheidt efficiënte voortbeweging van energieverspillende struikelpartijen. Het geheim? Beloningssignalen die het leerproces sturen en van vallen en opstaan precisie maken.

Unitree G1

Een hoogwaardige humanoïde robot voor serieuze demonstraties, evenementen, educatie en geavanceerde interactie. Ideaal wanneer u een krachtigere robot nodig heeft...

Het is alsof er een coach in het brein van de robot zit, die constant fluistert: "Je kunt dit!" en hem aanmoedigt om topprestaties te leveren.

Het simuleren van complexe omgevingen voor robottraining

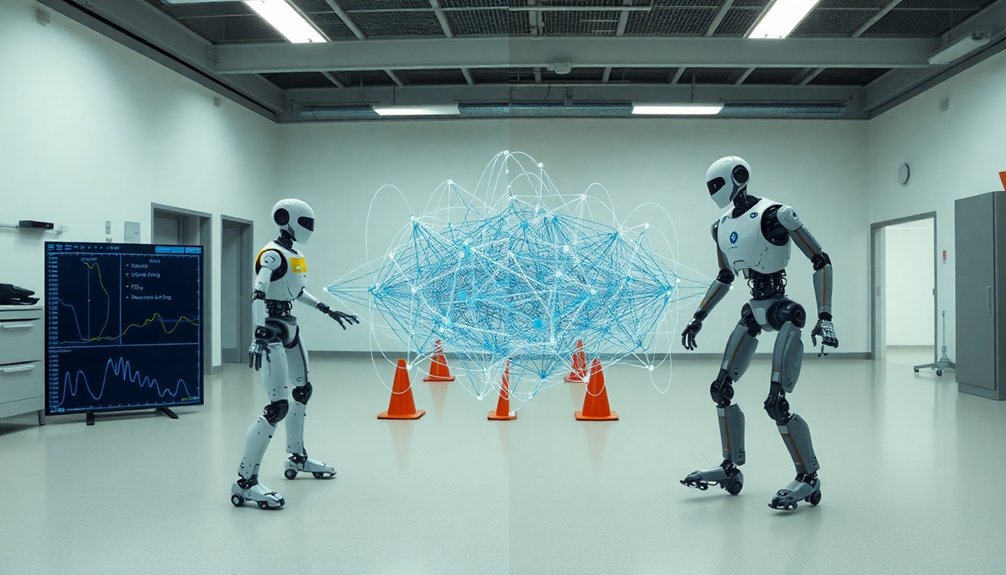

Omdat robottraining niet alleen draait om het programmeren van algoritmes, maar ook om het creëren van digitale universums waarin machines sneller leren dan mensen ooit zouden kunnen, zijn simulatieomgevingen het geheime laboratorium van de moderne robotica geworden.

Door duizenden virtuele scenario's te genereren, kunnen ingenieurs humanoïde robots trainen om complexe uitdagingen aan te gaan zonder dure hardware te riskeren. Stel je een digitale speeltuin voor waar robots door onmogelijk terrein navigeren, ingewikkelde bewegingen leren en zich aanpassen aan zeer uiteenlopende omstandigheden – allemaal voordat ze hun eerste stap in de echte wereld zetten.

Domeinrandomisatie transformeert deze simulaties in adaptieve leeromgevingen, waarbij fysieke eigenschappen en scenario's worden gevarieerd om werkelijk veerkrachtige robotintelligentie te creëren. Zie het als een videogame waarin elk level iets andere vaardigheden test, waardoor robots worden voorbereid op alles, van gladde trottoirs tot verraderlijke bergpaden.

Simulatie is niet zomaar training, het is robotevolutie in een stroomversnelling.

Beloningsstructuren: het sturen van robotgedrag

Als robots willen leren hoe ze zich als elegante, intelligente machines moeten bewegen, hebben ze meer nodig dan alleen regels code; ze hebben een motivatiesysteem nodig dat hen precies vertelt hoe goed gedrag eruitziet.

Beloningsstructuren fungeren als het interne kompas van de robot en sturen hem naar de gewenste acties, net als een digitale coach. Zie het als het trainen van een puppy, maar in plaats van snoepjes gebruik je wiskundige feedback die de bewegingen van de robot vormgeeft.

Door frequente beloningen leren robots sneller, omdat ze constant prestatiesignalen geven, terwijl schaarse beloningen ervoor kunnen zorgen dat de training aanvoelt als kijken naar drogende verf.

De kunst is om beloningen te ontwerpen die menselijk lopen stimuleren – een evenwicht vinden tussen snelheid, energie-efficiëntie en stabiliteit.

Als je dit verkeerd aanpakt, kan je robot wel eens heel vreemde bewegingsstrategieën ontwikkelen die meer lijken op die van een dronken zombie dan op die van een soepele, adaptieve machine.

Uitdagingen bij het vertalen van gesimuleerde vaardigheden naar fysieke robots

Ondanks geavanceerde algoritmes die robots er in simulaties briljant uit laten zien, is de echte wereld een wrede meesteres die software-ingenieurs graag ongelijk bewijst. Het vertalen van gesimuleerde vaardigheden naar fysieke robots is niet alleen een uitdaging, het is een riskante technische puzzel vol valkuilen.

- De natuurkunde werkt niet altijd even soepel: de dynamiek van simulaties komt zelden overeen met de chaos in de echte wereld.

- Robots hebben moeite om aangeleerd gedrag toe te passen in verschillende omgevingen.

- Beperkingen van de actuator zorgen voor onverwachte prestatieknelpunten.

- Uiterst nauwkeurige besturing vereist een bovenmenselijk aanpassingsvermogen van de computer.

Domeinrandomisatie helpt deze vertaaluitdagingen te overbruggen door robots in wezen te trainen om het onverwachte te verwachten. Door fysieke parameters tijdens de simulatie te variëren, creëren ingenieurs robuustere beleidsregels die de onvoorspelbaarheid van de echte wereld aankunnen.

Het is alsof je een robot leert dansen, niet alleen op een perfect podium, maar op een verschuivende, onzekere ondergrond – waar één verkeerde beweging een spectaculaire mechanische valpartij betekent.

Leren over voortbeweging: van simulatie naar beweging in de echte wereld

Wanneer robots leren lopen, zijn het in feite peuters met titanium benen: onhandig, vastberaden en vatbaar voor spectaculaire valpartijen. Proprioceptieve sensoren Helpt robots hun bewegingen te verfijnen, waardoor ze zich nauwkeurig kunnen aanpassen aan de omgeving en hun evenwicht tijdens de voortbeweging kunnen bewaren.

Diepgaande versterkingslering transformeert deze mechanische wezentjes van onhandige experimenten in sierlijke bewegers. Door duizenden gesimuleerde humanoïden parallel te laten draaien, comprimeren onderzoekers tientallen jaren aan loopoefeningen tot slechts enkele uren. Je zult robots complexe bewegingen zien leren door middel van eindeloze trial-and-error, waarbij ze menselijke bewegingspatronen met verbazingwekkende precisie nabootsen.

Domeinrandomisatie werkt als een soort trainingskamp voor robots, waarbij deze mechanische atleten worden getraind om zich aan te passen aan zeer uiteenlopende terreinen en fysieke omstandigheden. Hoogfrequente koppelfeedback wordt hun neurale spiergeheugen en overbrugt de kloof tussen simulatie en realiteit.

Het resultaat? Robots die niet alleen lopen, maar met een bijna menselijk zelfvertrouwen paraderen en onhandige algoritmes omzetten in vloeiende, intelligente bewegingen.

Adaptieve strategieën voor onvoorspelbare scenario's

Van vloeiende loopsimulaties tot het navigeren door de chaos van de echte wereld: humanoïde robots staan nu voor hun ultieme uitdaging: omgaan met het onverwachte.

Deze adaptieve strategieën transformeren robots van voorspelbare machines in dynamische probleemoplossers.

Van rigide algoritmes tot vloeiende intelligentie: robots overstijgen geprogrammeerde grenzen en omarmen een creatieve, dynamische aanpak voor probleemoplossing.

- Echte humanoïde robots leren net als peuters: door voortdurend te proberen en grote mislukkingen te beleven.

- Domeinrandomisatie creëert bovenmenselijke flexibiliteit in beweging.

- Diepgaande versterkingslering stelt robots in staat te improviseren zoals jazzmuzikanten.

- Onvoorspelbare scenario's worden speelterreinen voor robotintelligentie.

Baanbrekende technieken in de besturing van humanoïde robots

De allernieuwste ontwikkelingen in de besturing van humanoïde robots gaan niet alleen over het laten bewegen van machines, maar ook over het leren van improvisatievermogen. Deep Reinforcement Learning zorgt voor een revolutie in de manier waarop robots complexe bewegingen leren door middel van simulaties gebaseerd op vallen en opstaan. Je zult versteld staan hoe neurale netwerken robots helpen zich sneller aan te passen dan traditionele programmering ooit zou kunnen. De ontwikkeling van emotionele AI-frameworks Het verlegt de grenzen van hoe robots complexe menselijke interacties kunnen begrijpen en erop kunnen reageren.

| Techniek | Belangrijkste voordeel | Prestatie-impact |

|---|---|---|

| Domein Randomisatie | Aanpassing van het milieu | Hoge robuustheid |

| Natuurlijk acteur-criticus | Beleidsoptimalisatie | Efficiënt leren |

| Meerlaagse perceptrons | Complexe beslissingsmodellering | Nauwkeurige controle |

Stel je voor dat robots leren bewegen zoals peuters – alleen kunnen deze ‘kinderen’ miljoenen scenario’s in seconden verwerken. Door geavanceerde neurale architecturen te integreren met verklaarbare AI-technieken, creëren onderzoekers machines die niet alleen bewegen, maar ook begrijpen waarom ze bewegen. Het is geen sciencefiction meer; het gebeurt nu al.

Prestatie-indicatoren en succesbeoordeling

Omdat het meten van het succes van deep reinforcement learning in humanoïde robotica niet alleen draait om mooie grafieken en percentages, is het belangrijk te begrijpen hoe onderzoekers daadwerkelijk bepalen of het aangeleerde gedrag van een robot meer is dan alleen een leuk trucje.

Prestatiecijfers onthullen de werkelijke mogelijkheden van robotsystemen op verschillende complexiteitsniveaus.

Je zult snel merken dat het evalueren van DRL niet eenvoudig is:

- De succesniveaus variëren van eenvoudige simulatie (niveau 0) tot commerciële productimplementatie (niveau 5).

- Het aanpassingsvermogen aan de praktijk hangt af van de diversiteit van de opleidingen en de stabiliteit van het beleid.

- Bewegings- en navigatievaardigheden hebben een grote invloed op de prestatiebeoordeling.

- Subjectieve rapportage maakt gestandaardiseerde evaluatie lastig.

Onderzoekers gaan diepgaand te werk om te begrijpen of een robot daadwerkelijk problemen kan oplossen of alleen voorgeprogrammeerde reacties nabootst.

De uitdaging gaat verder dan algoritmes en code; het is de kunst om echt probleemoplossend vermogen te onderscheiden van louter robotachtige nabootsing.

Ze houden niet alleen cijfers bij; ze zijn op zoek naar echte intelligentie die zich met menselijke flexibiliteit en snel denkvermogen kan redden in onvoorspelbare omgevingen.

Toekomstperspectieven van intelligente robotsystemen

Je staat aan de vooravond van een robotrevolutie waarin AI niet alleen leert, maar ook de manier waarop machines denken en zich aanpassen aan de chaos in de echte wereld transformeert.

Stel je humanoïde robots voor die hun strategieën direct kunnen bijstellen, bijna zoals een slim kind dat ter plekke nieuwe spelregels ontdekt, aangedreven door steeds geavanceerdere deep reinforcement learning-technieken.

Deze intelligente systemen zullen niet zomaar rigide programmering volgen; ze zullen genuanceerde besluitvormingsvaardigheden ontwikkelen die de grens tussen geprogrammeerde reactie en echte adaptieve intelligentie doen vervagen.

AI-gestuurde robotische evolutie

Terwijl de wereld druk in debat is over de vraag of robots de wereld zullen overnemen, transformeert deep reinforcement learning in stilte humanoïde machines van lompe metalen beelden tot adaptieve, lerende wezens die zich als behendige atleten door complexe omgevingen kunnen bewegen.

Deze door AI aangedreven robots veranderen ons begrip van machine-intelligentie door:

- Bovennatuurlijke bewegingsvaardigheden die menselijke bewegingen nabootsen.

- Direct leren van duizenden virtuele simulaties

- Adaptief gedrag in onvoorspelbaar terrein

- Autonoom probleemoplossend vermogen zonder expliciete programmering

Stel je robots voor die leren zoals nieuwsgierige kinderen: ze ontdekken, vallen, staan weer op en worden beter bij elke interactie.

Diepgaand reinforcement learning leert machines niet alleen bewegen; het geeft ze ook het vermogen om hun omgeving te begrijpen en zich daaraan aan te passen.

Adaptieve machine-intelligentie

Wanneer kunstmatige intelligentie besluit te stoppen met schaken en zich in plaats daarvan te richten op het heruitvinden van voortbeweging, gebeurt er iets magisch: robots veranderen van geprogrammeerde machines in lerende organismen die letterlijk ter plekke kunnen denken.

Bij humanoïde robotica draait het niet langer alleen om het bouwen van coolere machines, maar om het creëren van adaptieve intelligentie die leert, zich aanpast en overleeft in onvoorspelbare omgevingen.

Stel je robots voor die niet alleen scripts volgen, maar uitdagingen ook daadwerkelijk begrijpen en er in realtime op reageren.

Diepgaand versterkingsleren is het geheime ingrediënt dat dit mogelijk maakt, waardoor machines kunnen experimenteren, falen en verbeteren door middel van continue interactie.

Door trainingsscenario's te randomiseren en de grenzen van de computertechnologie te verleggen, leren onderzoekers robots om door complex terrein te navigeren, onverwachte obstakels te overwinnen en iets te ontwikkelen dat griezelig veel op intuïtie lijkt.

De toekomst draait niet om perfecte programmering, maar om het creëren van robots die slim genoeg zijn om dingen zelf uit te zoeken.

Intelligent systeemontwerp

Omdat de toekomst van robotica niet draait om het creëren van perfecte machines, maar om adaptieve, intelligente systemen die kunnen denken en leren, vertegenwoordigt het ontwerpen van intelligente systemen de absolute voorhoede van de samenwerking tussen mens en machine.

Deep Reinforcement Learning (DRL) is niet zomaar code; het is de hersentrainingsruimte waar robots intelligentie ontwikkelen die relevant is voor de praktijk.

- Robots die sneller van hun fouten leren dan mensen.

- Adaptieve algoritmen die neurale plasticiteit nabootsen

- Complexe bewegingspatronen ontstaan door middel van vallen en opstaan.

- Autonome navigatie over onvoorspelbaar terrein

Je kijkt naar een technologische revolutie waarbij humanoïde robots niet alleen instructies zullen opvolgen, maar ook de context zullen begrijpen, zich dynamisch zullen aanpassen en in een fractie van een seconde beslissingen zullen nemen.

DRL transformeert robotsystemen van starre, programmeerbare instrumenten naar flexibele, lerende entiteiten.

Stel je voor dat machines slimmer worden bij elke interactie, waardoor de kloof tussen geprogrammeerd gedrag en echte intelligentie wordt overbrugd.

De toekomst draait niet om het vervangen van mensen, maar om het creëren van samenwerkingspartners die snel kunnen schakelen.

Mensen vragen ook naar robots.

Hoe wordt reinforcement learning toegepast in de robotica?

Je gebruikt reinforcement learning om robots te trainen door ze te laten leren via vallen en opstaan. Ze ontvangen beloningen voor succesvolle acties en optimaliseren geleidelijk hun gedrag om complexe taken autonoom uit te voeren.

Hoe leg je diepgaand reinforcement learning uit?

Heb je je ooit afgevraagd hoe machines leren om slimme beslissingen te nemen? Diepgaand versterkingsleren combineert neurale netwerken met op beloning gebaseerd leren, waardoor AI-agenten hun acties kunnen optimaliseren door middel van continue interactie met complexe omgevingen via vallen en opstaan.

Maakt Chatgpt gebruik van reinforcement learning?

Ja, ChatGPT maakt gebruik van Reinforcement Learning from Human Feedback (RLHF), een techniek die de reacties verfijnt door te leren van menselijke beoordelingen en voorkeuren, waardoor er natuurlijker en contextueel passendere dialogen gegenereerd kunnen worden.

Wat zijn de 4 componenten van reinforcement learning?

Net als een schaker die zijn zetten strategisch plant, navigeer je door reinforcement learning via vier belangrijke componenten: de agent (de lerende), de omgeving, de acties (keuzes) en de beloningen (feedback). Deze componenten helpen je samen om betere beslissingen te nemen en topprestaties te leveren.

Waarom dit belangrijk is in de robotica

Je hebt gezien hoe deep reinforcement learning robots transformeert van logge machines in adaptieve leerlingen. Zie deze systemen als nieuwsgierige kinderen die leren door vallen en opstaan, alleen worden ze aangedreven door neurale netwerken in plaats van pindakaas en experimenten op het schoolplein. De toekomst draait niet om perfecte robots, maar om slimme robots die kunnen improviseren, zich kunnen aanpassen en misschien – heel misschien – de rommelige complexiteit van onze wereld kunnen begrijpen. Houd je vast: de robotrevolutie is nog maar net begonnen.

Ontdek welke robotfamilies geschikt zijn voor dit gebruiksscenario.

Unitre Go2

Maak kennis met de Unitree Go2 — een robothond die loopt, rent, springt en danst. Hij brengt zijn omgeving in kaart…

Unitree G1

Een hoogwaardige humanoïde robot voor serieuze demonstraties, evenementen, educatie en geavanceerde interactie. Ideaal wanneer u een krachtigere robot nodig heeft...

Bekijk de robots, vergelijk de modellen en reserveer de juiste zonder te hoeven kopen.

Gebruik Futurobots om sneller te werken, flexibel te blijven en toegang te krijgen tot geavanceerde robots zonder ze te hoeven kopen.