Deep Reinforcement Learning verwandelt Roboter von schwerfälligen Maschinen in adaptive Lerner. Sie werden erleben, wie KI humanoiden Robotern beibringt, sich wie Athleten zu bewegen, indem sie Millionen von Szenarien in digitalen Spielumgebungen durchläuft. Sie werden Fehler machen, lernen und sich schneller verbessern, als Sie es sich vorstellen können – vergleichbar mit einem Kleinkind auf digitalen Steroiden. Neuronale Netze helfen Robotern, Bewegungsmuster zu entschlüsseln und komplexe Umgebungen in herausfordernde Spielumgebungen zu verwandeln. Neugierig, wie Maschinen menschliche Grenzen überwinden könnten? Bleiben Sie dran.

Die Grundlagen des Deep Reinforcement Learning

Die Roboterrevolution beginnt mit einem Gehirn, nicht nur mit Metall und Schaltkreisen. Deep Reinforcement Learning ist keine Science-Fiction-Fantasie – es ist die Art und Weise, wie Maschinen lernen, wie anpassungsfähige Problemlöser zu denken. Algorithmen für maschinelles Lernen die Fähigkeit des Roboters zur Verarbeitung sensorischer Eingaben und zur dynamischen Anpassung seiner Lernstrategien verbessern.

Stellen Sie sich einen Roboter vor, der aus seinen Fehlern lernt, genau wie Sie. Durch die Kombination neuronaler Netze mit Versuch-und-Irrtum-Strategien können diese Systeme komplexe Umgebungen navigieren und blitzschnell Entscheidungen treffen. Sie folgen keinen vordefinierten Anweisungen, sondern entwickeln sich durch Erfahrung weiter.

Die Magie entsteht, wenn Algorithmen Rohdaten in intelligente Aktionen umwandeln und Roboter so befähigen, hochdimensionale Eingaben zu interpretieren und mit bemerkenswerter Präzision zu reagieren. Man kann es sich so vorstellen, als würde man einer Maschine beibringen, querzudenken und Möglichkeiten jenseits linearer Programmierung zu erkennen.

Einheitsbaum Go2

Lernen Sie den Unitree Go2 kennen – einen Roboterhund, der geht, rennt, springt und tanzt. Er kartiert seine Umgebung…

Es ist, als würde man einem Roboter Intuition verleihen – die Fähigkeit zu improvisieren, zu lernen und rohes Potenzial in intelligentes Verhalten umzuwandeln.

Neuronale Netze und robotische Entscheidungsfindung

Wenn neuronale Netze auf robotische Entscheidungsfindung treffen, geschieht Magie – und wir sprechen hier nicht von Hollywood-Science-Fiction-Fantasien.

Diese intelligenten Algorithmen verwandeln Roboter von schwerfälligen Maschinen in lernfähige Systeme. Durch die Modellierung komplexer Umgebungen mithilfe von mehrschichtigen Perzeptronen und Convolutional Neural Networks können Roboter nun komplizierte Bewegungsmuster wie ein digitaler Choreograf entschlüsseln.

Stellen Sie sich einen humanoiden Roboter vor, der das Laufen lernt, indem er in hochpräzisen Simulationen übt und seine Vorgehensweise mit jedem noch so unbeholfenen Schritt anpasst. Humanoide Roboterplattformen Sie integrieren zunehmend fortschrittliche KI, um komplexe Umgebungen mit beispielloser Präzision zu navigieren.

Neuronale Netze helfen dabei, nicht nur Bewegungen, sondern auch den Kontext zu verstehen – sie unterscheiden zwischen effizienter Fortbewegung und energieverschwendenden Stolperfallen. Das Geheimnis? Belohnungssignale, die das Lernen steuern und Versuch und Irrtum in Präzision verwandeln.

Unitree G1

Ein hochwertiger humanoider Roboter für anspruchsvolle Demos, Events, Schulungen und fortgeschrittene Interaktion. Ideal, wenn Sie einen leistungsstärkeren Roboter benötigen…

Es ist, als hätte man einen Trainer im Gehirn des Roboters, der ihm ständig zuflüstert: „Du schaffst das“, und ihn dabei sanft zu Höchstleistungen anspornt.

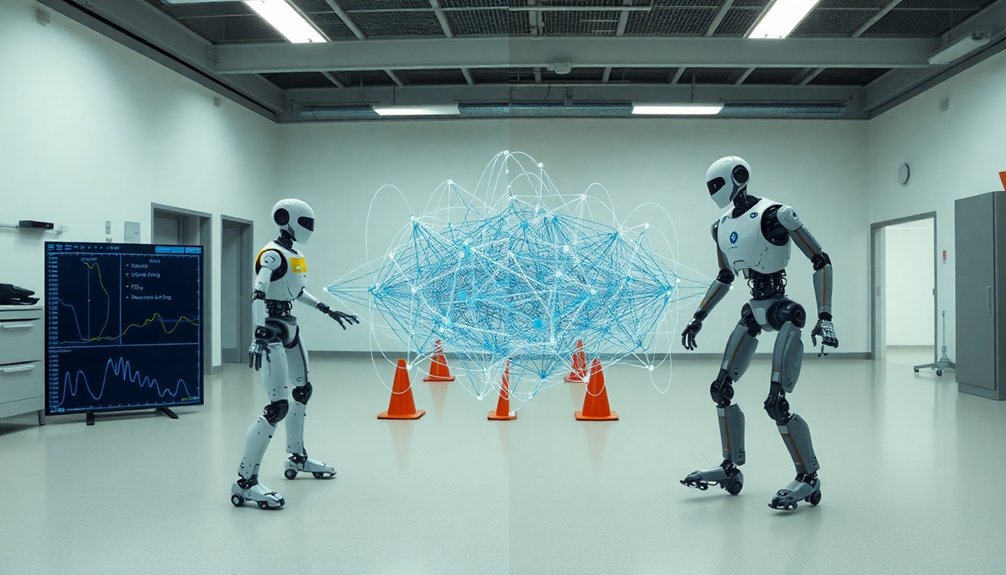

Simulation komplexer Umgebungen für das Robotertraining

Weil es beim Robotertraining nicht nur um das Codieren von Algorithmen geht, sondern um die Schaffung digitaler Universen, in denen Maschinen schneller lernen, als es Menschen je könnten, sind Simulationsumgebungen zum geheimen Labor der modernen Robotik geworden.

Durch die Generierung Tausender virtueller Szenarien können Ingenieure humanoide Roboter trainieren, komplexe Herausforderungen zu meistern, ohne teure Hardware riskieren zu müssen. Stellen Sie sich einen digitalen Spielplatz vor, auf dem Roboter unmögliches Terrain bewältigen, komplizierte Bewegungen erlernen und sich an völlig unterschiedliche Bedingungen anpassen – alles, bevor sie ihren ersten Schritt in die reale Welt wagen.

Die Domänenrandomisierung verwandelt diese Simulationen in adaptive Lernumgebungen, in denen physikalische Eigenschaften und Szenarien variiert werden, um eine wirklich robuste Roboterintelligenz aufzubauen. Man kann es sich wie ein Videospiel vorstellen, in dem jedes Level leicht unterschiedliche Fähigkeiten testet und Roboter so auf alles vorbereitet – von glatten Gehwegen bis hin zu tückischen Bergpfaden.

Simulation ist nicht nur Training – sie ist Roboterevolution im Hyperantrieb.

Belohnungsstrukturen: Steuerung des Roboterverhaltens

Wenn Roboter lernen sollen, sich wie anmutige, intelligente Maschinen zu bewegen, brauchen sie mehr als nur Codezeilen – sie brauchen ein Motivationssystem, das ihnen genau sagt, wie gutes Verhalten aussieht.

Belohnungssysteme sind der interne Kompass des Roboters und lenken ihn wie ein digitaler Trainer zu den gewünschten Aktionen. Man kann es sich wie das Training eines Welpen vorstellen, nur dass man statt Leckerlis mathematisches Feedback verwendet, um die Roboterbewegung zu formen.

Dichte Belohnungen helfen Robotern, schneller zu lernen, indem sie konstante Leistungssignale liefern, während spärliche Belohnungen das Training so langwierig erscheinen lassen, als würde man Farbe beim Trocknen zusehen.

Die Kunst besteht darin, Belohnungen zu entwickeln, die ein menschenähnliches Gehen fördern – ein Gleichgewicht zwischen Geschwindigkeit, Energieeffizienz und Stabilität.

Wenn Sie hier etwas falsch machen, könnte Ihr Roboter ernsthaft seltsame Bewegungsstrategien entwickeln, die eher an einen betrunkenen Zombie erinnern als an eine geschmeidige, anpassungsfähige Maschine.

Herausforderungen bei der Übertragung simulierter Fähigkeiten auf physische Roboter

Trotz modernster Algorithmen, die Roboter in Simulationen brillant erscheinen lassen, ist die Realität unerbittlich und beweist Softwareentwicklern immer wieder das Gegenteil. Die Übertragung simulierter Fähigkeiten auf reale Roboter ist nicht nur eine Herausforderung – sie ist ein riskantes Ingenieursrätsel mit vielen Fallstricken.

- Die Physik spielt nicht mit: Simulationsdynamiken stimmen selten mit dem Chaos der realen Welt überein.

- Roboter haben Schwierigkeiten, erlernte Verhaltensweisen auf verschiedene Umgebungen zu übertragen.

- Beschränkungen des Aktuators führen zu unerwarteten Leistungsengpässen.

- Hochpräzise Steuerung erfordert übermenschliche Rechenleistung.

Domänenrandomisierung hilft, diese Übersetzungsherausforderungen zu bewältigen, indem sie Roboter im Grunde darauf trainiert, mit dem Unerwarteten umzugehen. Durch die Variation physikalischer Parameter während der Simulation entwickeln Ingenieure robustere Strategien, die mit der Unvorhersehbarkeit der realen Welt umgehen können.

Es ist, als würde man einem Roboter beibringen, nicht nur auf einer perfekten Bühne zu tanzen, sondern auf unebenem, unsicherem Untergrund – wo eine falsche Bewegung einen spektakulären mechanischen Sturz bedeutet.

Fortbewegung lernen: Von der Simulation zur Bewegung in der realen Welt

Wenn Roboter laufen lernen, sind sie im Grunde Kleinkinder mit Beinen aus Titan – ungeschickt, entschlossen und anfällig für spektakuläre Stürze. Propriozeptive Sensoren helfen Robotern, ihre Bewegungen feinabzustimmen, was eine präzise Anpassung an die Umgebung und ein Gleichgewicht während der Fortbewegung ermöglicht.

Deep Reinforcement Learning verwandelt diese mechanischen Roboter von unbeholfenen Experimenten in elegante Fortbewegungsmaschinen. Indem sie Tausende simulierter Humanoide parallel laufen lassen, komprimieren Forscher jahrzehntelanges Lauftraining auf wenige Stunden. Sie werden Zeuge, wie Roboter durch unermüdliches Ausprobieren komplexe Bewegungsabläufe erlernen und menschliche Bewegungsmuster mit verblüffender Präzision nachahmen.

Die Domänenrandomisierung wirkt wie ein robotisches Bootcamp und trainiert diese mechanischen Athleten, sich an völlig unterschiedliche Terrains und physikalische Bedingungen anzupassen. Hochfrequentes Drehmoment-Feedback wird zu ihrem neuronalen Muskelgedächtnis und überbrückt die Kluft zwischen Simulation und Realität.

Das Ergebnis? Roboter, die nicht nur laufen – sie stolzieren mit einer fast menschenähnlichen Selbstsicherheit umher und verwandeln ungelenke Algorithmen in flüssige, intelligente Bewegungen.

Adaptive Strategien für unvorhersehbare Szenarien

Von flüssigen Gehsimulationen bis hin zum Manövrieren im Chaos der realen Welt stehen humanoide Roboter nun vor ihrer ultimativen Herausforderung: dem Umgang mit dem Unerwarteten.

Diese adaptiven Strategien verwandeln Roboter von vorhersehbaren Maschinen in dynamische Problemlöser.

Von starren Algorithmen bis hin zu fließender Intelligenz überwinden Roboter programmierte Grenzen und setzen auf kreative Problemlösungsdynamik.

- Echte humanoide Roboter lernen wie Kleinkinder: durch ständiges Ausprobieren und epische Fehlschläge.

- Domänenrandomisierung erzeugt übermenschliche Flexibilität in der Bewegung

- Deep Reinforcement Learning ermöglicht es Robotern, wie Jazzmusiker zu improvisieren.

- Unvorhersehbare Szenarien werden zu Spielwiesen für robotische Intelligenz.

Bahnbrechende Techniken in der Steuerung humanoider Roboter

Die Spitzentechnologie in der Steuerung humanoider Roboter beschränkt sich nicht nur auf die Bewegung von Maschinen, sondern umfasst auch deren Fähigkeit, buchstäblich blitzschnell zu reagieren. Deep Reinforcement Learning revolutioniert das Erlernen komplexer Bewegungen durch Simulationen, die auf Versuch und Irrtum basieren. Sie werden staunen, wie neuronale Netze Robotern helfen, sich schneller anzupassen als es traditionelle Programmierung je könnte. Die Entwicklung von emotionale KI-Frameworks verschiebt die Grenzen dessen, wie Roboter komplexe menschliche Interaktionen verstehen und darauf reagieren können.

| Technik | Entscheidender Vorteil | Auswirkungen auf die Leistung |

|---|---|---|

| Domänen-Randomisierung | Umgebungsanpassung | Hohe Robustheit |

| Natürlicher Schauspieler-Kritiker | Richtlinienoptimierung | Effizientes Lernen |

| Mehrschichtige Perzeptrone | Komplexe Entscheidungsmodellierung | Präzise Kontrolle |

Stellen Sie sich Roboter vor, die Fortbewegungsfähigkeiten wie Kleinkinder erlernen – nur dass diese „Kinder“ Millionen von Szenarien in Sekundenschnelle verarbeiten können. Durch die Integration fortschrittlicher neuronaler Architekturen mit erklärbaren KI-Techniken entwickeln Forscher Maschinen, die sich nicht nur bewegen, sondern auch verstehen, warum sie sich bewegen. Das ist keine Science-Fiction mehr; es ist Realität.

Leistungskennzahlen und Erfolgsbewertung

Da es bei der Messung des Erfolgs von Deep Reinforcement Learning in der humanoiden Robotik nicht nur um ausgefallene Grafiken und Prozentsätze geht, sollten Sie verstehen, wie Forscher tatsächlich feststellen, ob das erlernte Verhalten eines Roboters mehr ist als nur ein cooler Partytrick.

Leistungskennzahlen offenbaren die wahre Leistungsfähigkeit von Robotersystemen auf verschiedenen Komplexitätsstufen.

Sie werden schnell feststellen, dass die Bewertung von Tagfahrlicht nicht einfach ist:

- Die Erfolgsstufen reichen von der einfachen Simulation (Stufe 0) bis zur kommerziellen Produkteinführung (Stufe 5).

- Die Anpassungsfähigkeit in der Praxis hängt von der Vielfalt der Ausbildungsangebote und der Stabilität der Politik ab.

- Fortbewegungs- und Navigationsfähigkeiten haben einen dramatischen Einfluss auf die Leistungsbeurteilung.

- Subjektive Berichterstattung erschwert standardisierte Bewertungen

Forscher gehen der Sache auf den Grund, um zu verstehen, ob ein Roboter Probleme tatsächlich lösen kann oder nur vorprogrammierte Reaktionen nachahmt.

Jenseits von Algorithmen und Code besteht die Herausforderung darin, echte Problemlösung von bloßer roboterhafter Nachahmung zu unterscheiden.

Sie erfassen nicht nur Zahlen; sie suchen nach echter Intelligenz, die sich mit menschenähnlicher Flexibilität und schnellem Denken in unvorhersehbaren Umgebungen zurechtfinden kann.

Zukunftsperspektiven intelligenter Robotersysteme

Sie stehen am Rande einer Roboterrevolution, in der KI nicht nur lernt, sondern die Art und Weise verändert, wie Maschinen im Chaos der realen Welt denken und sich anpassen.

Stellen Sie sich humanoide Roboter vor, die ihre Strategien blitzschnell anpassen können, fast wie ein cleveres Kind, das im Handumdrehen neue Spielplatzregeln entdeckt, angetrieben von immer ausgefeilteren Deep-Reinforcement-Learning-Techniken.

Diese intelligenten Systeme werden nicht einfach nur starren Programmen folgen; sie werden differenzierte Entscheidungsfähigkeiten entwickeln, die die Grenze zwischen programmierter Reaktion und echter adaptiver Intelligenz verwischen.

KI-gesteuerte Roboterevolution

Während die Welt damit beschäftigt ist, darüber zu debattieren, ob Roboter die Herrschaft übernehmen werden, verwandelt Deep Reinforcement Learning im Stillen humanoide Maschinen von klobigen Metallstatuen in anpassungsfähige, lernende Wesen, die sich in komplexen Umgebungen wie flinke Athleten bewegen können.

Diese KI-gesteuerten Roboter verändern unser Verständnis von maschineller Intelligenz durch:

- Übermenschliche Fortbewegungsfähigkeiten, die menschliche Bewegung nachahmen

- Sofortiges Lernen aus Tausenden von virtuellen Simulationen

- Anpassungsverhalten in unvorhersehbarem Gelände

- Autonome Problemlösung ohne explizite Programmierung

Stellen Sie sich Roboter vor, die wie neugierige Kinder lernen – die erkunden, hinfallen, sich wieder erholen und sich mit jeder Interaktion verbessern.

Deep Reinforcement Learning bedeutet nicht nur, Maschinen das Bewegen beizubringen, sondern ihnen auch die Fähigkeit zu verleihen, ihre Umgebung zu verstehen und sich an sie anzupassen.

Adaptive maschinelle Intelligenz

Wenn künstliche Intelligenz beschließt, mit dem Schachspielen aufzuhören und stattdessen die Fortbewegung neu zu erfinden, geschieht etwas Magisches: Roboter verwandeln sich von programmierten Maschinen in lernende Organismen, die buchstäblich imstande sind, zu denken.

Bei humanoider Robotik geht es nicht mehr nur darum, coolere Maschinen zu bauen – es geht darum, adaptive Intelligenz zu schaffen, die lernt, sich anpasst und in unvorhersehbaren Umgebungen überlebt.

Stellen Sie sich Roboter vor, die nicht nur vorgegebene Abläufe befolgen, sondern Herausforderungen in Echtzeit verstehen und darauf reagieren.

Deep Reinforcement Learning ist die geheime Zutat, die dies ermöglicht und Maschinen durch kontinuierliche Interaktion zum Experimentieren, Scheitern und Verbessern befähigt.

Durch die Randomisierung von Trainingsszenarien und die Erweiterung der Grenzen der Rechenleistung bringen Forscher Robotern bei, sich in komplexem Gelände zurechtzufinden, unerwartete Hindernisse zu bewältigen und etwas zu entwickeln, das der Intuition unheimlich nahe kommt.

Die Zukunft liegt nicht in der perfekten Programmierung, sondern darin, Roboter zu entwickeln, die intelligent genug sind, um Dinge selbstständig herauszufinden.

Intelligentes Systemdesign

Weil es bei der Zukunft der Robotik nicht um die Entwicklung perfekter Maschinen geht, sondern um adaptive intelligente Systeme, die denken und lernen können, stellt das intelligente Systemdesign die Speerspitze der Mensch-Maschine-Kollaboration dar.

Deep Reinforcement Learning (DRL) ist nicht nur Code – es ist das Gehirntrainingszentrum, in dem Roboter Intelligenz für die reale Welt entwickeln.

- Roboter, die schneller aus Fehlern lernen als Menschen

- Adaptive Algorithmen, die neuronale Plastizität nachahmen

- Komplexe Bewegungsmuster entstehen durch Versuch und Irrtum

- Autonome Navigation in unvorhersehbarem Gelände

Sie erleben eine technologische Revolution, in der humanoide Roboter nicht nur Anweisungen befolgen, sondern den Kontext verstehen, sich dynamisch anpassen und in Sekundenbruchteilen Entscheidungen treffen werden.

DRL wandelt Robotersysteme von starren, programmierbaren Werkzeugen in flexible, lernende Einheiten um.

Stellen Sie sich Maschinen vor, die mit jeder Interaktion intelligenter werden und so die Kluft zwischen programmiertem Verhalten und echter Intelligenz überbrücken.

Die Zukunft besteht nicht darin, Menschen zu ersetzen, sondern darin, Partner für die Zusammenarbeit zu schaffen, die flexibel reagieren können.

Die Leute fragen auch nach Robotern.

Wie wird Reinforcement Learning in der Robotik eingesetzt?

Sie werden Reinforcement Learning einsetzen, um Roboter zu trainieren, indem Sie sie durch Versuch und Irrtum lernen lassen. Dabei erhalten sie Belohnungen für erfolgreiche Aktionen und optimieren schrittweise ihr Verhalten, um komplexe Aufgaben autonom zu bewältigen.

Wie erklärt man Deep Reinforcement Learning?

Haben Sie sich jemals gefragt, wie Maschinen lernen, intelligente Entscheidungen zu treffen? Deep Reinforcement Learning kombiniert neuronale Netze mit belohnungsbasiertem Lernen und ermöglicht es KI-Agenten so, ihre Aktionen durch kontinuierliches Ausprobieren und Lernen aus Fehlern in komplexen Umgebungen zu optimieren.

Nutzt Chatgpt Reinforcement Learning?

Ja, ChatGPT verwendet Reinforcement Learning from Human Feedback (RLHF), eine Technik, die die Antworten durch das Lernen aus menschlichen Bewertungen und Präferenzen verfeinert und so zu natürlicheren und kontextbezogeneren Dialogen beiträgt.

Was sind die 4 Komponenten des bestärkenden Lernens?

Wie ein Schachspieler, der seine Züge strategisch plant, navigieren Sie beim Reinforcement Learning durch vier Schlüsselkomponenten: den Agenten (Lernenden), die Umgebung, Aktionen (Entscheidungen) und Belohnungen (Feedback), die Ihnen gemeinsam helfen, Ihre Entscheidungsfindung zu verbessern und Höchstleistungen zu erzielen.

Warum das in der Robotik wichtig ist

Sie haben gesehen, wie Deep Reinforcement Learning Roboter von schwerfälligen Maschinen in adaptive Lerner verwandelt. Stellen Sie sich diese Systeme wie neugierige Kinder vor, die durch Ausprobieren lernen – nur dass sie statt mit Erdnussbutter und Spielplatzexperimenten von neuronalen Netzen angetrieben werden. Die Zukunft gehört nicht perfekten Robotern, sondern intelligenten Robotern, die improvisieren, sich anpassen und vielleicht – nur vielleicht – die komplexe Unordnung unserer Welt verstehen können. Machen Sie sich bereit: Die Roboterrevolution hat gerade erst begonnen.

Erkunden Sie die Roboterfamilien, die für diesen Anwendungsfall geeignet sind.

Einheitsbaum Go2

Lernen Sie den Unitree Go2 kennen – einen Roboterhund, der geht, rennt, springt und tanzt. Er kartiert seine Umgebung…

Unitree G1

Ein hochwertiger humanoider Roboter für anspruchsvolle Demos, Events, Schulungen und fortgeschrittene Interaktion. Ideal, wenn Sie einen leistungsstärkeren Roboter benötigen…

Stöbern Sie durch die Roboter, vergleichen Sie die Modelle und reservieren Sie den passenden, ohne ihn kaufen zu müssen.

Mit Futurobots bewegen Sie sich schneller, bleiben flexibel und erhalten Zugang zu fortschrittlichen Robotern, ohne diese kaufen zu müssen.